Universit´

e de Montr´

eal

D´

etection de mouvements dans des s´

equences

d’images bas´

ee sur la dynamique de

supraconductivit´

e

par

Magatte Diagne

D´epartement d’informatique et de recherche op´erationnelle Facult´e des arts et des sciences

M´emoire pr´esent´e `a la Facult´e des ´etudes sup´erieures en vue de l’obtention du grade de

Maˆıtre `es sciences (M.Sc.) en informatique

Aoˆut, 2016

c

R´

ESUM´

E

Le but de ce travail est d’´etudier la faisabilit´e de la d´etection de mouvements dans des s´equences d’images en utilisant l’´equation de continuit´e et la dynamique de supraconductivit´e. Notre approche peut ˆetre motiv´ee par le fait que l’´equation de continuit´e apparait dans plusieurs techniques qui estiment le flot optique. Un grand nombre de techniques qui utilisent les flots optiques utilisent une contrainte appel´ee contrainte de l’invariance lumineuse. La dynamique de supraconductivit´e nous per-met de nous affranchir de la contrainte de l’invariance lumineuse. Les exp´eriences se feront avec la base de donn´ees de s´equences d’images CDNET 2014. Pour obtenir les r´esultats num´eriques en terme de score F1, une combinaison sera faite par la suite entre la dynamique de supraconductivit´e et un m´ecanisme d’attention qui est un r´esum´e des v´erites de terrain.

Mots cl´es : d´etection de mouvements, ´equation de continuit´e, dynamique de supraconductivit´e

ABSTRACT

The goal of this work is to study the feasibility of motion detection in images sequences by using the continuity equation and superconductivity dynamics. Our approach can be motivated by the fact that many techniques that compute the optic flow use the continuity equation combined with a constraint that is called the bright-ness constancy constraint. The dynamics of superconductivity allows us to escape from the brightness consistency constraint. The experiments will be done with a database of images sequences named CDNET 2014. To obtain the numerical results in terms of F1 score a combination will be done between the dynamics of supercon-ductivity and a mechanism of attention which is a resume of the ground truth.

Keywords: motion detection, continuity equation, superconductivity dynamics

ii

The next great era of awakening of human intellect may well produce a method for understanding the qualitative content of equations. Today we cannot. Today we cannot see that the water flow equations contain such things as the barber pole structure of turbulence that one sees between rotating cylinders. Today we cannot see whether the Schr¨odinger’s equation contains frogs, musical composers, or morality – or whether it does not. We cannot say whether something beyond it like God is needed, or not. And so we can all hold strong opinions either way.

NOTATION

∇ op´erateur nabla ∇· op´erateur de divergence ∇2 op´erateur Laplacien H op´erateur Hamiltonien A vecteur potentiel ψ fonction d’onde φ potentiel ´electrostatique v vecteur vitesseρ puissance ou densit´e de charge

√ρ amplitude

θ phase

π pi

¯h constante de Planck r´eduite

m masse d’un ´electron

qe charge d’un ´electron

TABLE DES MATI`

ERES

R´esum´e

Abstract i

Notation iii

Chapitre 1: Introduction au sujet de recherche 3

Chapitre 2: Mod´elisation de l’avant-plan ou de l’arri`ere-plan 7

Chapitre 3: Equation de continuit´´ e et estimation du flot optique 9

Chapitre 4: Solution ´etudi´ee 13

4.1 M´ecanisme d’attention . . . 14 4.2 Dynamique de supraconductivit´e . . . 34 4.3 Combinaison entre le m´ecanisme d’attention et la dynamique de

supra-conductivit´e . . . 46

Chapitre 5: R´esultats et discussion 50

5.1 R´esultats . . . 50 5.2 Discussion . . . 80

Chapitre 6: Conclusion 82

R´ef´erences 84

Annexe B: 94

Chapitre 1

INTRODUCTION AU SUJET DE RECHERCHE

Le sujet de recherche concerne la d´etection de mouvements dans des s´equences d’images. La d´etection de mouvements est souvent utilis´ee comme pr´etraitement `a d’autres tˆaches. Cependant il est consid´er´e que c’est un probl`eme assez difficile en g´en´eral et une quantit´e impressionnante d’articles a ´et´e d´ej`a publi´ees `a son sujet [1]. Selon moi, une des difficult´es du probl`eme est li´ee au fait que lorsque les appareils photographiques ordinaires prennent une photo, l’information concernant l’amplitude des ondes est gard´ee, mais l’information concernant les phases relatives des ondes provenant des diff´erentes r´egions est perdue [7]. Donc retrouver la sc`ene en trois dimensions est compliqu´e et comme expliqu´e dans [16] il est important de raisonner au niveau de la sc`ene. Notons qu’il existe un proc´ed´e appel´e holographie permettant de conserver `a la fois les amplitudes et les phases des ondes. Il est consid´er´e que les principes de l’holographie furent ´etablis par Dennis Gabor en 1948.

Similairement `a la d´etection de mouvements, il existe la d´etection de changement qui est un probl`eme quelque peu diff´erent. Dans la d´etection de changement il y a certaines cat´egories de mouvements qui ne sont pas `a d´etecter. Mouvements qui peuvent par exemple comprendre : le mouvement de l’eau ou encore des feuilles des arbres. La d´etection de changement comprend aussi le cas o`u un objet ´etait en mou-vement puis s’arrˆete. Il arrive donc que des objets `a l’arrˆet doivent quand mˆeme ˆetre d´etect´es par le syst`eme. Ceci indique que la d´etection de changement n’est pas tout `a fait la d´etection de mouvement. Dans la d´etection de changement, il y a une volont´e de se concentrer uniquement sur certains types de situtations qui peuvent contenir ou non du mouvement.

2014 [20] destin´ee `a la d´etection de changement. CDNET 2014 contient en tout 53 s´equences et a ´et´e annot´e manuellement. On a comme entr´ee (input) une s´equence d’images en couleur I1, I2, ... ayant toutes la mˆeme dimension MxN. La sortie d´esir´ee (aussi appel´ee v´erit´e de terrain ou ground truth en anglais) est une image binaire o`u chaque pixel est soit noir, soit blanc. La couleur noire d´esigne l’absence de mouve-ment. La couleur blanche d´esigne le mouvemouve-ment. Voici un exemple o`u on a comme entr´ee une image en couleur et la sortie d´esir´ee.

(a) entr´ee (b) sortie d´esir´ee

Figure 1.1: Un exemple d’entr´ee et de sortie d´esir´ee

Dans cet exemple il n’y a que le mouvement des voitures qui nous int´eresse. On doit donc d´etecter le mouvement des voitures qui passent. Le mouvement des arbres `a gauche (ainsi que le mouvement de leurs ombres) ne doivent pas ˆetre detect´es. En effet dans la d´etection de changement, seules certaines categories de mouvement sont `a d´etecter.

La sortie d´esir´ee est la cible `a pr´edire par l’algorithme et il est possible de mesurer la performance d’un algorithme face `a la sortie desir´ee. La performance est mesur´ee en termes de F-measure ou score F1. En d´efinissant TP comme le vrai positif (true positif), FP comme le faux positif (false positif) et FN comme le faux n´egatif (false

negative), la F-measure a pour formule F 1 = 2 ∗ P r ∗ Re P r + Re (1.1) o`u Pr d´esigne la pr´ecision P r = T P T P + F P (1.2)

et Re d´esigne le rappel (recall)

Re = T P

T P + F N (1.3)

Ici le vrai positif d´esigne les pixels qui ont ´et´e correctement classifi´es comme ´etant en mouvement. Le faux positif d´esigne les pixels qui ont ´et´e incorrectement classifi´es comme ´etant en mouvement. Le faux n´egatif d´esigne les pixels qui sont en mouvement mais qui n’ont pas ´et´e d´etect´es comme tels. Pour chaque s´equence on additionne ces valeurs d’abord au sein d’une mˆeme image puis d’image en image pour pouvoir calculer par la suite le score F1.

CDnet 2014 rec`ele de nombreux d´efis car les s´equences d’images ont ´et´e cap-tur´ees sous diff´erentes conditions. Les images provenant de la mˆeme s´equence ont la mˆeme dimension. Les images provenant de s´equences diff´erentes n’ont pas forc´ement les mˆemes dimensions. Le nombre d’images varie selon les s´equences. Sur chaque s´equence il y a une zone d’interˆet. Les zones d’interˆet sont des images binaires (ayant la mˆeme dimension que l’entr´ee) qui d´esignent les endrois o`u l’algorithme sera ´evalu´e. Ceci peut ˆetre toute l’image ou une certaine partie de l’image. Les zones o`u l’algorithme sera evalu´e ont la valeur 255. Les zones o`u l’algorithme ne sera pas evalu´e ont la valeur 0. Voici des zones d’int´eret pour diff´erentes s´equences.

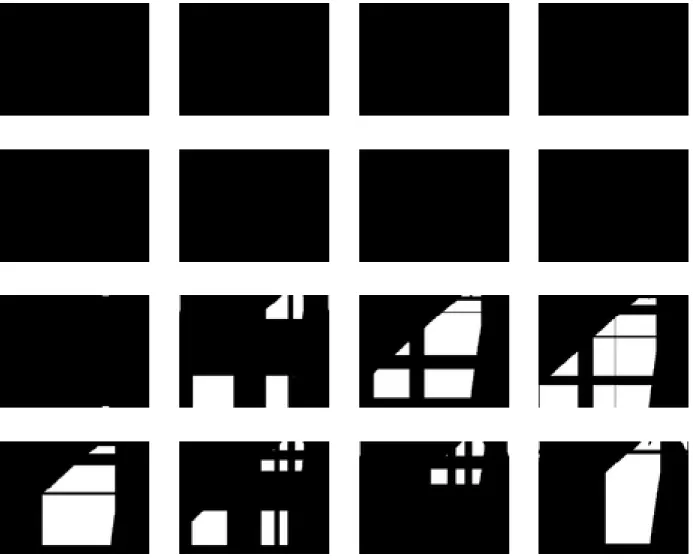

(a) streetlight (b) abandonedbox (c) highway (d) streetcorneratnight

Figure 1.2: Zones d’int´erˆet pour diff´erentes s´equences

Pour les s´equences streetlight et abandonedBox on remarque que ce n’est qu’une partie de l’image qui est concern´ee par la d´etection de changement. Pour la s´equence highway c’est toute l’image qui est concern´ee. Quand ´a la s´equence streetcornerat-night c’est presque toute l’image qui est concern´ee.

Le code pour r´ealiser les exp´eriences se fera avec C/C++. Mathematica sera utilis´e pour obtenir les images illustratives de certaines fonctions math´ematiques et certaines statistiques.

Chapitre 2

MOD´

ELISATION DE L’AVANT-PLAN OU DE

L’ARRI`

ERE-PLAN

Une mani`ere naturelle de consid´erer la d´etection de mouvement est de diviser chaque image en essentiellement deux zones : les zones qui comprennent le d´ecor (zones plus ou moins immobiles) et les zones qui contiennent des ´el´ements intrus au d´ecor (zones mobiles). Ces deux zones sont respectivement appel´ees arri`ere-plan et avant-plan (background et foreground en anglais). Ce principe est `a la base de plusieurs proc´ed´es dont certains s’appuient en plus sur la statistique. Dans ce cas-ci pour chaque pixel, diff´erentes valeurs, telles que la moyenne ou la variance, sont calcul´ees. La d´ecision finale se base sur un ensemble de crit`eres qui pren-nent g´en´eralement en compte la valeur courante du pixel ainsi que les diff´erentes valeurs statistiques calcul´ees. Certaines techniques se concentrent sur la mod´elisation de l’avant-plan alors que d’autres se concentrent sur la mod´elisation de l’arri`ere-plan. [11] d´ecompose la mod´elisation de l’arri`ere-plan en principalement 4 ´etapes : repr´esentation de l’image, manipulation statistique, s´election du seuillage ainsi que la mise `a jour du mod`ele de l’arri`ere-plan. La mixture de gaussiennes est une m´ethode statistique potentiellement peu on´ereuse en termes de temps en faisant cer-taine(s) simplification(s) telle qu’une matrice de covariance isotropique. Une prob-abilit´e d’appartenir soit `a l’avant-plan soit `a l’arri`ere-plan est assign´ee pour chaque pixel. La mixture de gaussiennes a ´et´e utilis´ee par exemple dans [21]. Notons aussi que la mixture de gaussiennes (sous certaines conditions) fait partie d’un ensem-ble plus large nomm´e dans [15]: mod`eles lin´eaires gaussiens. Dans cet article il est montr´e que diff´erents mod`eles math´ematiques sont des variations d’un mˆeme mod`ele plus g´en´eral. Dans [6] la d´etection de changement est faite grˆace `a des r´eseaux de

neurones de type sans poids (weighless neural network). Le mod`ele est bas´e sur un r´eseau de noeuds de type RAM (random access memory) et poss`ede un haut degr´e de parall´elisation. Dans [19] la mod´elisation de l’arri`ere-plan est faite grˆace `a des autoencoders. Il a ´et´e montr´e dans [8] que les mod`eles de type autoencoder et les machines de Boltzmann restreintes (rbm) sont similaires. Le mod´ele rbm a ´et´e utilis´e dans [13] mais dans le cas de cam´eras de type pan-tilt-zoom (Ptz). Dans [18], un mod`ele quelque peu diff´erent de la machine de Boltzmann a ´et´e utilis´e. Ce mod`ele inclut une notion temporelle adaptative. [11] utilise une approche physique bas´ee sur des mod`eles de formation de l’image.

Toutes ces techniques mentionn´ees peuvent ˆetre utilis´ee pour la d´etection de change-ment.

Chapitre 3

´

EQUATION DE CONTINUIT´

E ET ESTIMATION DU

FLOT OPTIQUE

Comme le montre la page web actuelle du site de Scholarpedia 1 sur l’estimation

du flot optique, la plupart des contraintes utilis´ees pour estimer le flot optique peu-vent ˆetre d´eriv´ees `a partir de l’´equation de continuit´e. La page web actuelle du site de Wikipedia 2 sur l’´equation de continuit´e montre que celle-ci apparait dans les cas

suivants : ´electromagn´etisme, dynamique des fluides, ´energie et chaleur, distribu-tions de probabilit´e et m´echanique quantique. Elle d´ecrit le transport d’une certaine quantit´e. L’´equation de continuit´e peut s’´ecrire sous la forme g´en´erale

∂ρ

∂t = −∇ · J (3.1)

Dans ce qui suit l’interˆet se porte sur le cas particulier o`u

J = ρv (3.2)

Alors l’´equation de continuit´e devient ∂ρ

∂t = −∇ · ρv (3.3)

Dans le cas de l’estimation du flot optique, ρ d´esigne l’intensit´e d’un pixel, g´en´eralement en niveaux de gris, et v = (vx, vy) d´esigne le flot optique. L’expression ρv est donc

en r´ealit´e un vecteur

1http://www.scholarpedia.org/article/Optic flow 2https://en.wikipedia.org/wiki/Continuity equation

ρv = (ρvx, ρvy) (3.4) En d´eveloppant ∇ · ρv on a ∇ · ρv = ∂x∂ (ρvx) + ∂ ∂y(ρvy) (3.5) Ce qui donne ∇ · ρv = ∂ρ ∂x.vx+ ∂vx ∂x.ρ + ∂ρ ∂y.vy + ∂vy ∂y .ρ (3.6)

En choisissant comme notation

∂ρ ∂t = ρt (3.7) ∂ρ ∂x = ρx (3.8) ∂ρ ∂y = ρy (3.9)

Alors l’´equation de continuit´e peut s’´ecrire sous la forme

−ρt = ρx.vx+ ρy.vy+ ρ.(

∂vx

∂x + ∂vy

∂y) (3.10)

Une hypoth`ese fr´equemment utilis´ee pour estimer le flot optique est l’hypoth`ese de l’invariance de l’intensit´e lumineuse. Cette hypoth`ese est la suivante : on suppose que l’intensit´e de chaque point reste constante le long de sa trajectoire temporelle. Dans ce cas ci on peut montrer que

∂vx

∂x + ∂vy

∂y = 0 (3.11)

C’est-`a-dire que la divergence du flot optique est nulle. Autrement dit

∇ · v = 0 (3.12)

Ce qui fait que

−ρt= ρx.vx+ ρy.vy (3.13)

Montrons que supposer que l’intensit´e de chaque pixel reste constante le long de sa trajectoire, revient `a supposer l’´egalit´e suivante : ∇ · v = 0. Notons ρ(x, y, t) comme ´etant ´egale `a la valeur de l’intensit´e d’un pixel de coordonn´ees (x, y) au temps t. En consid´erant que le pixel se d´eplace au fil du temps soit ρ(x + δx, y + δy, t + δt) comme

´etant ´egale `a la valeur de l’intensit´e du mˆeme pixel `a la position (x + δx, y + δy) au

temps t+δt. L’hypoth`ese de l’invariance lumineuse revient `a stipuler l’´egalit´e suivante

ρ(x, y, t) = ρ(x + δx, y + δy, t + δt) (3.14)

En utilisant le d´eveloppement en s´erie de Taylor du premier ordre de ρ(x + δx, y +

δy, t + δt) on a ρ(x, y, t) = ρ(x, y, t) + δx. ∂ρ ∂x + δy. ∂ρ ∂y + δt. ∂ρ ∂t (3.15) Ou plus simplement δx. ∂ρ ∂x + δy. ∂ρ ∂y + δt. ∂ρ ∂t = 0 (3.16)

En divisant par δt, dont la valeur est suppos´ee non nulle, on a

δx δt .∂ρ ∂x + δy δt .∂ρ ∂y + ∂ρ ∂t = 0 (3.17) En remarquant que δx δt = vx (3.18) δy δt = vy (3.19) 11

On a

ρx.vx+ ρy.vy + ρt = 0 (3.20)

Donc, en revenant `a l’´equation de continuit´e

∇ · v = 0 (3.21)

Et on retrouve la forme

−ρt= ρx.vx+ ρy.vy (3.22)

Supposer l’hypoth`ese de l’invariance lumineuse revient `a supposer que ∇ · v = 0.

Chapitre 4

SOLUTION ´

ETUDI´

EE

La solution ´etudi´ee peut se d´ecomposer en deux parties distinctes qui n’ont pas de lien direct.

Une premi`ere partie qui utilise un r´esum´e des v´erit´es de terrain comme m´ecanisme d’attention. Une deuxi`eme partie qui elle, utilise la dynamique de supraconductivit´e comme d´etecteur de mouvement g´en´eral. Ces deux approches seront combin´ees par la suite pour faire la d´etection de mouvements. Commen¸cons par ce qui a motiv´e le fait de r´esumer les v´erit´es de terrain. Comme CDNET 2014 contient des mouvements de nature diff´erentes (mouvements de v´ehicules, mouvements de personnes, etc), on aurait pu s’int´eresser `a une approche o`u on apprend `a d´etecter le mouvement. Dans ce cas-ci chaque s´equence aurait pu ˆetre divis´ees en trois ensembles : un ensemble d’apprentissage, un ensemble de validation et un ensemble de test. Cependant, offi-ciellement, cela n’a pas ´et´e fait pour CDNET 2014. Donc au lieu de diviser chaque s´equence en trois parties, on utilise un r´esum´e des v´erit´es de terrain. Ce resum´e permetrra de se concentrer que sur certaines parties de l’image. Sinon la derni`ere approche qui reste serait de d´etecter le mouvement de mani`ere totalement non super-vis´ee. Le r´esum´e des v´erites de terrain est donc un palliatif au d´ecoupage de chaque s´equence en trois parties.

Ce qui a motiv´e l’usage de la dynamique de supraconductivit´e est le fait que les flots optiques d´esignent une estimation du mouvement apparent des objets sur une sc`ene `a trois dimensions. Comme vu en haut, le calcul des flots optiques repose, pour un grand nombre de techniques, sur l’´equation de continuit´e. Cette ´equation apparait aussi dans le cadre de la dynamique de supraconductivit´e. Aussi il faut noter que la dynamique des fluides a ´et´e d´ej`a utilis´ee pour le probl`eme d’inpainting [2]. Dans ce

cas-ci on cherche `a restaurer une image qui a ´et´e d´egrad´ee. La dynamique des fluides a ´et´e utilis´ee aussi pour le calcul des flots optiques [9]. Notre approche a ´et´e guid´ee par une similarit´e entre les ´equations provenant de la dynamique des fluides, et celles provenant de la dynamique de supraconductivit´e.

4.1 M´ecanisme d’attention

Chaque solution de l’ensemble de donn´ees CDNET 2014 peut ˆetre r´esum´ee par une accumulation de deux images nomm´ees ici X et Y et par une troisi`eme image appel´ee Z. Le but de ce m´emoire n’est pas d’obtenir les meilleurs r´esultats possibles sur l’ensemble de donn´ees CDNET 2014 de mani`ere non supervis´ee. Par non supervis´ee je veux dire ne pas utiliser les v´erit´es de terrain dans la solution. Dans le livre [5] le chapitre trois se nomme Distributed Representations. Dans ce chapitre, il y a une section appel´ee Distributed Representations That Works Efficiently. Dans cette section diff´erentes repr´esentations distribu´ees telles que le coarse coding sont explor´ees. Ici comme m´ecanisme d’attention est utilis´e le produit ext´erieur de X et Y et combin´e `a une intersection avec Z. Les images X et Y peuvent ˆetre vues de la mani`ere suivante.

Soit une image I

0 255 0

0 0 0

255 255 0

0 255 255

alors X est ´egal `a

255 0 255 255 et YT est ´egal `a 255 255 255

L’encodage de X et de Y se comporte comme une fonction OU (sur la valeur 255) suivant les lignes ou suivant les colonnes, ce qui donne X et Y. Dans l’exemple la racine carr´ee du produit ext´erieur √XYT donne :

255 255 255

0 0 0

255 255 255 255 255 255

Le m´ecanisme d’attention consiste `a utiliser le produit ext´erieur √XYT combin´e

`a une intersection de l’image Z. L’op´eration en question peut s’´ecrire sous la forme

compacte : √XYT ∩ Z. L’image Z est obtenue de la mani`ere suivante : un point

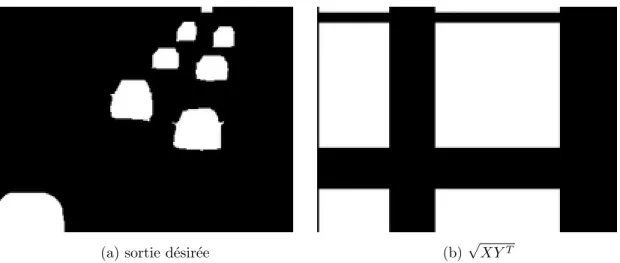

(pixel) est marqu´e comme blanc (valeur 255) si dans toute la s´equence vid´eo quelque chose en mouvement est d´eja pass´e par cette position. Un pixel est marqu´e comme noir (valeur 0) si pendant toute la s´equence aucun objet en mouvement n’est pass´e par ce pixel. Voil`a comment sont obtenues les trois images X, Y et Z. Dans [5] l’encodage en X et Y est utilis´e pour r´esoudre le probl`eme suivant : supposons que l’on veuille encoder la position d’un point dans un plan en achevant une grande pr´ecision sans utiliser un grand nombre d’unit´es. Dans ce cas un encodage possible est de diviser les unit´es en deux groupes : un groupe X et un groupe Y. Chaque unit´e va encoder un intervalle particulier pour X ou pour Y. Chaque point sera encod´e par l’activit´e de deux unit´es : une se trouvant dans la cat´egorie X et une autre se trouvant dans la cat´egorie Y. Un des probl`emes qui peut survenir `a cause de l’encodage utilis´e est le probl`eme nomm´e dans [5] ”the binding problem”. En effet en utilisant cet encodage certaines positions sont ambig¨ues. Voici un exemple qui montre l’ambigu¨ıt´e. La racine carr´ee du produit ext´erieur donne des rectangles qui d´esignent des positions en mouvement fictives.

(a) sortie d´esir´ee (b)√XYT

Figure 4.1: Un exemple montrant des rectangles fictifs dus `a l’encodage utilis´e

Il faut noter que parmi ces trois images seule l’image Z a une notion temporelle. Concernant X et Y il est possible de les accumuler au fil du temps. En accumulant les X on a une image dont le nombre de lignes est ´egal au nombre de lignes de X et le nombre de colonnes est ´egal au temps discretis´e. En accumulant les Y on a une image dont le nombre de colonnes est ´egal au nombre de colonnes de Y et le nombre de lignes est ´egal au temps discretis´e. Voici les pseudo-codes pour obtenir Z ainsi que les accumulations de X et de Y :

Algorithme 1 Accumulation temporelle des X Entr´ee: v´erit´es de terrain de dimensions: TxMxN Sortie: Acc X de dimensions: MxT

1: for t ∈ {0, ..., T − 1} do

2: for r ∈ {0, ..., M − 1} do

3: for c ∈ {0, ..., N − 1} do

4: if verites de terrain[t][r][c] == 255 then

5: Acc X[r][t] = 255 6: end if 7: end for 8: end for 9: end for 10: return Acc X 17

Algorithme 2 Accumulation temporelle des Y Entr´ee: v´erit´es de terrain de dimensions: TxMxN Sortie: Acc Y de dimensions: TxN

1: for t ∈ {0, ..., T − 1} do

2: for r ∈ {0, ..., M − 1} do

3: for c ∈ {0, ..., N − 1} do

4: if verites de terrain[t][r][c] == 255 then

5: Acc Y[t][c] = 255 6: end if 7: end for 8: end for 9: end for 10: return Acc Y Algorithme 3 Obtention de Z

Entr´ee: v´erit´es de terrain de dimensions: TxMxN Sortie: Z de dimensions: MxN

1: for t ∈ {0, ..., T − 1} do

2: for r ∈ {0, ..., M − 1} do

3: for c ∈ {0, ..., N − 1} do

4: if verites de terrain[t][r][c] == 255 then

5: Z[r][c] = 255 6: end if 7: end for 8: end for 9: end for 10: return Z 18

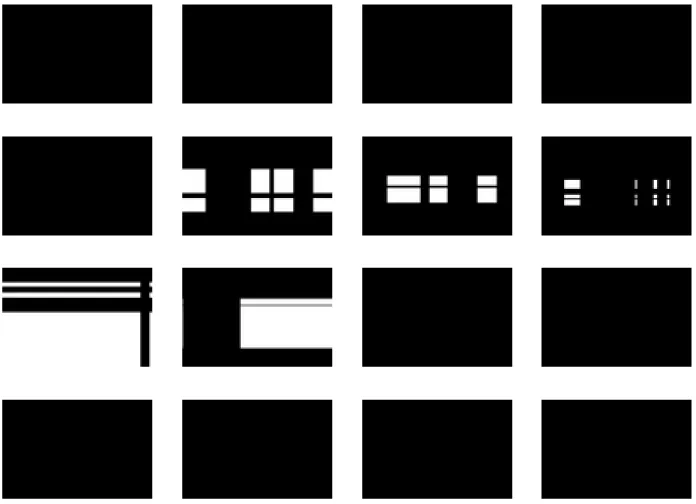

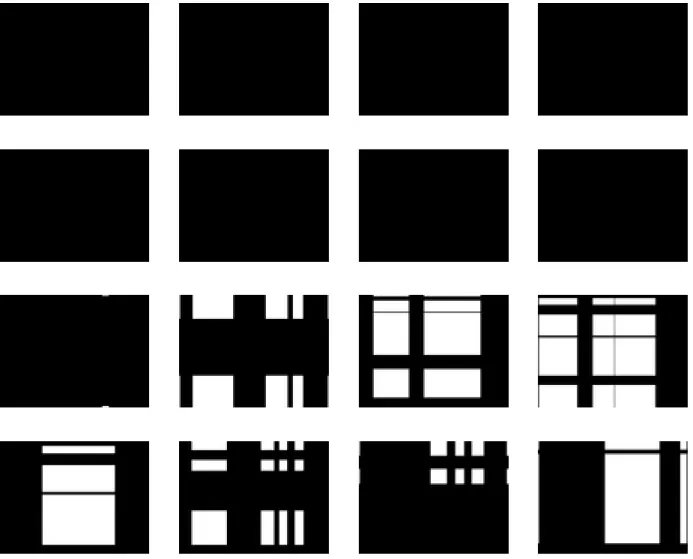

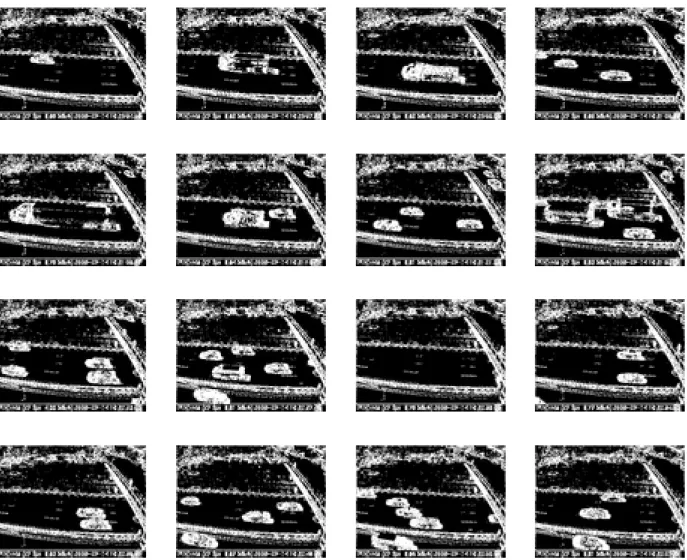

Dans ce qui suit sont montr´ees les accumulations temporelles de X et de Y, l’image Z ainsi que √XYT et√XYT ∩ Z pour cinq s´equences diff´erentes.

(a) Accumulation tem-porelle des X

(b) Accumulation temporelle des Y (c) Z

Figure 4.2: streetLight - Accumulation temporelle des X, Y; Z

Figure 4.3: streetLight - √XYT

Figure 4.4: streetLight - √XYT ∩ Z

(a) Accumulation tem-porelle des X

(b) Accumulation temporelle des Y (c) Z

Figure 4.5: abandonedBox - Accumulation temporelle des X, Y; Z

Figure 4.6: abandonedBox - √XYT

Figure 4.7: abandonedBox - √XYT ∩ Z

(a) Accumulation tem-porelle des X

(b) Accumulation temporelle des Y (c) Z

Figure 4.8: intermittentPan - Accumulation temporelle des X, Y; Z

Figure 4.9: intermittentPan -√XYT

Figure 4.10: intermittentPan -√XYT ∩ Z

(a) Accumulation tem-porelle des X

(b) Accumulation temporelle des Y (c) Z

Figure 4.11: highway - Accumulation temporelle des X, Y; Z

Figure 4.12: highway - √XYT

Figure 4.13: highway - √XYT ∩ Z

(a) Accumulation tem-porelle des X

(b) Accumulation temporelle des Y (c) Z

Figure 4.14: streetCornerAtNight - Accumulation temporelle des X, Y; Z

Figure 4.15: streetCornerAtNight - √XYT

Figure 4.16: streetCornerAtNight - √XYT ∩ Z

Les accumulations temporelles de X et Y nous renseignent sur la nature du mou-vement. Pour la s´equence highway par exemple les accumulations temporelles ressem-blent `a l’´ecoulement d’un fluide. Pour certaines s´equences (non montr´ees ici) il est mˆeme possible de connaitre le nombre d’objets en mouvement sur toute la s´equence juste en observant les accumulations temporelles. L’image Z permet de se rendre compte que pour chaque s´equence, juste une partie de l’image contient des objets qui seront `a un moment ou `a un autre en mouvement.

4.2 Dynamique de supraconductivit´e

La supraconductivit´e concerne des m´etaux dits supraconducteurs et est caracteris´ee par une absence de r´esistance ´electrique. Cela se passe `a des temp´eratures tr`es basses qui tendent vers le z´ero absolu. En effet en de¸ca d’une temperature critique, cer-tains m´etaux tel que le plomb ou l’aluminium conduisent le courant ´electrique sans r´esistance.

Dans ce qui suit, pour la plus grande partie, les notations de [14] ont ´et´e utilis´ees. Ce qui est propos´e ici se base sur ce qui a ´et´e fait dans le chapitre 21 du volume III de [14]. Le chapitre en question se nomme : The Schr¨odinger Equation in a Classi-cal Context: A Seminar on Superconductivity. Ce chapitre est consid´er´e comme un s´eminaire ou un rapport de recherche par l’auteur. Le sujet du chapitre est l’´equation de Schr¨odinger dans un contexte classique. Ce chapitre fait la description du com-portement d’une particule dans un champ magn´etique. Normalement, la fonction d’onde qui apparait dans l’equation de Schr¨odinger n’a pas un sens classique. Cepen-dant il existe certaines situations o`u une fonction d’onde de la m´ecanique quantique a un sens classique. Les id´ees d´ecrites dans ce chapitre conduisent `a une ´equation de continuit´e qui peut s’´ecrire sous la forme

∂P

∂t = −∇ · J (4.1)

ou bien

∂ρ

∂t = −∇ · ρv (4.2)

Ici P d´esigne la densit´e de probabilit´e de trouver une particule `a une position donn´ee. J d´esigne un courant de probabilit´e. Ce que cette ´equation signifie est le fait que lorsqu’une particule disparait d’une r´egion, elle ne peut pas apparaˆıtre dans une autre r´egion sans que quelque chose ne se passe entre les deux r´egions. Car une des charact´eristiques de la m´ecanique quantique est le fait que la probabilit´e se conserve localement. Appeler flot optique le vecteur vitesse obtenu en bout de compte peut ˆetre n´eanmoins sujet `a d´ebat car ρ ici ne d´esigne pas l’intensit´e d’un pixel. Ici la valeur de ρ est plutˆot proportionnelle ´a pα2 + β2 avec α comme ´etant la valeur

d’un pixel `a la position (x, y) au temps t et β comme ´etant la valeur d’un pixel `a la position (x, y) au temps t+1. Cela d´ecoule du fait que la fonction d’onde peut s’´ecrire sous la forme d’une fonction complexe. Le contexte consid´er´e permet de se passer de l’hypoth`ese de l’invariance lumineuse car la divergence du flot obtenu n’est pas nulle. Voir [14] pour des expliquations plus approfondies.

Il faut noter que le contexte de dynamique de supraconductivit´e permet de calculer plusieurs quantit´es, chacune ayant une signification particuli`ere. Dans ce m´emoire, pour la d´etection de mouvement, voici les termes que j’ai choisi de calculer : la fonction d’onde ψ, le vecteur potentiel A, le vecteur vitesse v, le rotationnel du vecteur vitesse ∇ × v et l’acc´eleration mat´erielle (comoving acceleration en anglais)

∂v ∂t+ vx

∂v ∂x+ vy

∂v

∂y. La fonction d’onde ψ et le vecteur potentiel A (qui repr´esentent ici

la mˆeme chose) sont calcul´es car on en a besoin pour le calcul du vecteur vitesse, du rotationnel du vecteur vitesse et pour l’acc´el´eration mat´erielle. Dans [14] la fonction d’onde utili´see est

ψ = ρ1/2eiθ (4.3)

Ici, la fonction d’onde suivante est prise

ψ = ρ1/2eiθ/2 (4.4)

La raison principale est que cela permet `a la fonction d’onde de s’´ecrire sous la forme ψ = F (ξ) = pξ (4.5) avec ξ = q ∗ (α + iβ) (4.6) et ρ = q ∗pα2+ β2 (4.7) et θ = arctan(β/α) (4.8)

o`u ξ est un nombre complexe (voir l’annexe B pour plus de d´etails sur ce choix). Venons en maintenant au vecteur potentiel. Ici (voir [14] pour plus de d´etails) le vecteur potentiel correspond `a la fonction d’onde. La fonction d’onde est une fonction complexe et peut s’´ecrire sous la forme suivante

ψ = ρ1/2cosθ/2 + iρ1/2sinθ/2 (4.9)

Soit Ax et Ay les deux composantes non nulles du vecteur potentiel. Alors

Ax= ρ1/2cosθ/2 (4.10)

Ay = ρ1/2sinθ/2 (4.11)

Les trois termes qui restent `a trouver sont le vecteur vitesse v, le rotationnel du vecteur vitesse ainsi que l’acc´el´eration mat´erielle. Ces trois termes contiennent tous v. Commen¸cons par v. En utilisant

J = ρv (4.12)

et (voir l’annexe pour la preuve)

J = ¯h m( 1 2∇θ − 1 ¯hqA)ρ (4.13)

il est facile de se rendre compte que

v = 1 m(

1

2¯h∇θ − qA) (4.14)

Comme v = (vx, vy) on peut aussi ´ecrire

vx = 1 m( 1 2¯h ∂θ ∂x − qAx) (4.15) vy = 1 m( 1 2¯h ∂θ ∂y − qAy) (4.16)

Notons que ¯h d´esigne la constante de Planck r´eduite et est ´egale `a 6.62606896∗1e−34

π .

qe = 1.60217662 ∗ 1e−19 d´esigne la charge d’un ´electron et q = 2 ∗ qe d´esigne la

charge d’une paire de Cooper d’´electrons. m d´esigne la masse d’un ´electron et vaut 9.10938356∗1e−31. ¯h, q et m pourraient ˆetre consider´ees comme ´etant des param`etres

`a choisir. L’effet de la variation de ces param`etres n’est pas explor´e ici.

Le rotationnel de v donne la tendance en un point `a ˆetre en rotation. Dans notre cas, c’est un vecteur qui est z´ero dans les coordonn´ees en x et en y. Donc lorsque la valeur du rotationnel est n´egative la rotation a tendance `a se faire vers le bas. Lorsque la valeur du rotationnel est positive la rotation a tendance `a se faire vers le haut. Lorsque le rotationnel est z´ero, cela indique une absence de rotation. Voir l’annexe pour la preuve de la formule suivante

∇ × v = (0, 0, −mq( 1 2√ρsin( θ 2) ∂ρ ∂x + 1 2 ∂θ ∂xAx− 1 2√ρcos( θ 2) ∂ρ ∂y + 1 2 ∂θ ∂yAy)) (4.17) L’acc´el´eration mat´erielle est l’acc´eleration d’une pi`ece particuli`ere d’un fluide. La d´erivee ∂v∂t donne le taux de changement pour un point fixe de l’espace. Ce qui nous int´eresse ici c’est comment la vitesse change pour une particule donn´ee que l’on suit. On peut consid´erer que dans un intervalle de temps ∆t la particule va se d´eplacer dans une autre location. Dans l’axe des x la particule va se d´eplacer de ∆x = vx∆t.

Dans l’axe des y la particule va se d´eplacer de ∆y = vy∆t. Si v(x, y, t) d´esigne

la vitesse d’une particule `a l’endroit (x, y) au temps t, alors la vitesse de la mˆeme particule au temps t + ∆t sera donn´ee par v(x + ∆x, y + ∆y, t + ∆t). Si ∆x, ∆y et ∆t tendent vers z´ero alors on a v(x+∆x, y +∆y, t+∆t) = v(x+vx∆t, y +vy∆t, t+∆t) =

v(x, y, t) +∂x∂vvx∆t +∂v∂yvy∆t + ∂v∂t∆t. L’acc´eleration ∆v∆t est le vecteur

∂v ∂t + vx ∂v ∂x + vy ∂v ∂y (4.18) ∂v

∂x est aussi un vecteur dont les composantes sont

∂vx ∂x = 1 m( 1 2¯h ∂2θ ∂x2 − q( 1 2√ρcos( θ 2) ∂ρ ∂x − 1 2Ay ∂θ ∂x)) (4.19) ∂vy ∂x = 1 m( 1 2¯h ∂2θ ∂x∂y − q( 1 2√ρsin( θ 2) ∂ρ ∂x + 1 2Ax ∂θ ∂x)) (4.20)

Similairement ∂v∂y est un vecteur et ses composantes sont

∂vx ∂y = 1 m( 1 2¯h ∂2θ ∂x∂y − q( 1 2√ρcos( θ 2) ∂ρ ∂y − 1 2Ay ∂θ ∂y)) (4.21) ∂vy ∂y = 1 m( 1 2¯h ∂2θ ∂y2 − q( 1 2√ρsin( θ 2) ∂ρ ∂y + 1 2Ax ∂θ ∂y)) (4.22) En se rappellant que 38

ρ = q ∗pα2+ β2 (4.23)

et que

θ = arctan(β/α) (4.24)

alors il reste `a trouver les expressions suivantes : ∂ρ∂x, ∂ρ∂y, ∂θ ∂x, ∂θ ∂y, ∂2 θ ∂x2, ∂ 2 θ ∂y2, ∂ 2 θ ∂x∂y.

Les expressions impliquant ρ sont faciles `a obtenir

∂ρ ∂x = q ∗ (2α ∂α ∂x + 2β ∂β ∂x) (4.25) ∂ρ ∂y = q ∗ (2α ∂α ∂y + 2β ∂β ∂y) (4.26)

Celles impliquant θ sont plus ardues et Mathematica a ´et´e utilis´e pour les obtenir. Les voici

Tout d’abord les d´eriv´ees de premier ordre

∂θ ∂x = α∂β∂x − ∂α ∂xβ α2+ β2 (4.27) ∂θ ∂y = α∂β∂y − ∂α ∂yβ α2+ β2 (4.28)

Ensuite les d´eriv´ees de second ordre

∂2θ ∂x2 = β(2α∂α∂x + 2β∂β∂x)∂α∂x − α(2α∂α∂x + 2β∂β∂x)∂β∂x (α2+ β2)2 + −β∂∂x2α2 + α ∂2 β ∂x2 α2+ β2 (4.29) ∂2θ ∂y2 =

β(2α∂α∂y + 2β∂β∂y)∂α∂y − α(2α∂α∂y + 2β∂β∂y)∂β∂y

(α2+ β2)2 + −β∂∂y2α2 + α ∂2 β ∂y2 α2+ β2 (4.30) ∂2 θ ∂x∂y =

β(2α∂α∂y+2β∂β∂y)∂α∂x−α(2α∂α∂y+2β ∂β ∂y) ∂β ∂x (α2 +β2 )2 + −β∂ 2 α ∂x∂y+α ∂2β ∂x∂y+ ∂α ∂y ∂β ∂x− ∂α ∂x ∂β ∂y α2 +β2 (4.31) 39

Les d´eriv´ees de premier ordre et de second ordre de α et de β par rapport `a x et `a y sont estim´ees en utilisant la m´ethode des diff´erences finies. En consid´erant I comme ´etant un tableau `a trois dimensions contenant les s´equences d’images alors au point de coordonn´ees (x, y) les d´eriv´ees de premier ordre sont ´egales `a

∂α ∂x =

I[t][x + 1][y] − I[t][x − 1][y]

2 (4.32) et ∂α ∂y = I[t][x][y + 1] − I[t][x][y − 1] 2 (4.33) Similairement ∂β ∂x =

I[t + 1][x + 1][y] − I[t + 1][x − 1][y]

2 (4.34)

et

∂β ∂y =

I[t + 1][x][y + 1] − I[t + 1][x][y − 1]

2 (4.35)

Les d´eriv´ees de second ordre sont ´egales `a ∂2α

∂x2 =

I[t][x + 1][y] − 2I[t][x][y] + I[t][x − 1][y]

4 (4.36)

et

∂2α

∂y2 =

I[t][x][y + 1] − 2I[t][x][y] + I[t][x][y − 1]

4 (4.37)

et ∂2α

∂x∂y =

I[t][x + 1][y + 1] − I[t][x + 1][y − 1] − I[t][x − 1][y + 1] + I[t][x − 1][y − 1] 4

(4.38) Similairement

∂2β

∂x2 =

I[t + 1][x + 1][y] − 2I[t + 1][x][y] + I[t + 1][x − 1][y]

4 (4.39)

et

∂2β

∂y2 =

I[t + 1][x][y + 1] − 2I[t + 1][x][y] + I[t + 1][x][y − 1]

4 (4.40)

et ∂2β

∂x∂y =

I[t + 1][x + 1][y + 1] − I[t + 1][x + 1][y − 1] − I[t + 1][x − 1][y + 1] + I[t + 1][x − 1][y − 1] 4

(4.41) Maintenant que nous avons toutes les ´equations dont nous avons besoin pour faire les calculs, il faut choisir un seuillage pour d´etecter quels pixels sont en mouvements. Pour d´etecter le mouvement je consid`ere ces trois ´el´ements de mani`ere s´epar´ee : le vecteur vitesse v, le rotationnel de v ainsi que l’acc´el´eration mat´erielle. Pour les r´esultats num´eriques je vais me limiter `a ne consid´erer que v.

Maintenant il faut choisir un seuillage. Il devrait certainement y avoir plusieurs moyens de s’y prendre. Une mani`ere de s’y prendre est de faire des graphiques statis-tiques concernant les valeurs d’interˆets et de choisir un seuillage fixe qui ´eliminera la plupart des pixels (la supposition faite ici est que le mouvement est un ´ev`enement rare). Dans le cas de CDnet 2014, il est raisonnable d’assumer que la plupart des ´el´ements `a d´etecter peuvent ˆetre r´eduits `a des courbes simples et ferm´ees. Ici une courbe simple signifie une courbe qui ne s’intersecte pas avec elle mˆeme. Si on con-sid`ere que chaque image est dans un champ vectoriel (vx, vy) alors le long de chaque

courbe, le champ vectoriel fait un angle bien d´efini. L’angle peut ˆetre obtenu en utilisant la formule suivante:

arctan(vy/vx) (4.42)

Voir [17] pour plus d’informations. Visualisons un graphique de 10.000 valeurs de arctan(vy/vx) calcul´ees pour une s´equence de deux images qui se suivent (les deux

images appartiennent `a une sequence d’images quelconque).

Figure 4.17: 10.000 valeurs de arctan(vy/vx)

Cela ressemble `a une distribution gaussienne. Comme seuillage un pixel est d´etect´e comme ´etant en mouvement si arctan(vy/vx) < −2.85 ou arctan(vy/vx) > −2.65. En

ne se basant que sur v, voil`a comment le mouvement est d´etect´e.

Consid´erons maintenant le rotationnel de v. Comme montr´e plus en haut, le rotation-nel de v est nul dans les coordonn´ees en x et en y. Le rotationrotation-nel donne la tendance d’un pixel `a ˆetre en rotation vers le haut ou vers le bas. Donc pour le seuillage on va ´eliminer les pixels qui n’ont pas une tr`es grande rotation vers le bas (rotationnel negatif) ou vers le haut (rotationnel positif). Empiriquement on fixe le seuillage `a 5.5 * 1e-9 pour un rotationnel positif et `a -5.5 * 1e-9 pour un rotationnel n´egatif. En ne se basant que sur ∇ × v un pixel est design´e comme ´etant en mouvement si ∇ × v < −5.5 ∗ 1e − 9 ou si ∇ × v > 5.5 ∗ 1e − 9.

Venons en maintenant `a l’acc´el´eration mat´erielle. Ici il suffit de remarquer que grˆace `a la loi de Newton (F = ma), l’acc´el´eration est proportionnelle `a la force qui s’applique

sur le point. Comme c’est une force, on peut consid´erer la norme de celle ci. Le seuillage consistera donc `a ´eliminer les pixels qui n’ont pas une tr`es grande force. De mani`ere empirique on fixe le seuil `a 1e16. C’est-`a-dire qu’un pixel est d´esign´e comme etant en mouvement si la norme de l’acc´el´eration d´epasse 1e16.

Dans ce qui suit se trouvent les pseudo-codes pour faire la d´etection de mouvement en utilisant s´epar´ement le vecteur vitesse v, le rotationnel de v ainsi que l’acc´el´eration mat´erielle.

Algorithme 4 D´etection en utilisant vx et vy

Entr´ee: Images I de dimensions: TxMxN

Sortie: Images binaires S de dimensions: TxMxN

1: vx ← tableau vide de dimensions TxMxN

2: vy ← tableau vide de dimensions TxMxN

3: for t ∈ {0, ..., T − 2} do 4: for r ∈ {0, ..., M − 1} do 5: for c ∈ {0, ..., N − 1} do 6: α ← I[t][r][c] 7: β ← I[t + 1][r][c] 8: ρ ← q ∗pα2+ β2 9: θ ← atan2(β, α) 10: Ax ←√ρcos(θ2) 11: Ay ←√ρsin(θ2) 12: vx[t][r][c] ← ´equations 4.15 et 4.27 13: vy[t][r][c] ← ´equations 4.16 et 4.28 14: arctan ← atan2(vy[t][r][c], vx[t][r][c])

15: if arctan > −2.65 k arctan < −2.85 then

16: S[t][r][c] ← 255 17: else 18: S[t][r][c] ← 0 19: end if 20: end for 21: end for 22: end for 23: return S 44

Algorithme 5 D´etection en utilisant la composante z de ∇ × v Entr´ee: Images I de dimensions: TxMxN

Sortie: Images binaires S de dimensions: TxMxN

1: for t ∈ {0, ..., T − 2} do 2: for r ∈ {0, ..., M − 1} do 3: for c ∈ {0, ..., N − 1} do 4: α ← I[t][r][c] 5: β ← I[t + 1][r][c] 6: ρ ← q ∗pα2+ β2 7: θ ← atan2(β, α) 8: Ax ←√ρcos(θ2) 9: Ay ←√ρsin(θ2) 10: rot v ← ´equation 4.17

11: if rot v <−5.5 ∗ 1e − 9 k rot v > 5.5 ∗ 1e − 9 then

12: S[t][r][c] ← 255 13: else 14: S[t][r][c] ← 0 15: end if 16: end for 17: end for 18: end for 45

Algorithme 6 D´etection en utilisant l’acc´el´eration mat´erielle Entr´ee: Images I de dimensions: TxMxN

Sortie: Images binaires S de dimensions: TxMxN

1: (vx, vy) ← Calculez avec l’algorithme 4

2: for t ∈ {0, ..., T − 2} do 3: for r ∈ {0, ..., M − 1} do 4: for c ∈ {0, ..., N − 1} do 5: (∂vx ∂x, ∂vy ∂x) ← ´equations 4.19 et 4.20 6: (∂vx ∂y, ∂vy ∂y) ← ´equations 4.21 et 4.22 7: (∂vx ∂t , ∂vy

∂t ) ← estimez par diff´erences finies

8: accx ← ∂v∂tx + vx[t][r][c]∂v∂xx + vy[t][r][c]∂v∂yx

9: accy ← ∂v∂ty + vx[t][r][c]∂v∂xy + vy[t][r][c]∂v∂yy

10: norme ← acc2x+ acc2y 11: if norme > 1e16 then

12: S[t][r][c] ← 255 13: else 14: S[t][r][c] ← 0 15: end if 16: end for 17: end for 18: end for

4.3 Combinaison entre le m´ecanisme d’attention et la dynamique de supraconductivit´e

Pour le moment le m´ecanisme d’attention et la dynamique de supraconductivit´e sont deux mani`eres s´epar´ees de d´etecter le mouvement. Le m´ecanisme d’attention utilise un resum´e des v´erit´es de terrain. La dynamique de supraconductivit´e utilise

ment les pixels de l’image. On va maintenant combiner ces deux techniques pour faire la d´etection de mouvement et aussi pour obtenir les r´esultats num´eriques en termes de score F1. La combinaison se fait de la mani`ere suivante. Le m´ecanisme d’attention nous donne des rectangles qui d´esignent des positions en mouvement (mais pas tou-jours). La dynamique de supraconductivit´e nous donne les contours des objets en mouvement. On va dessiner les contours des objets dans les rectangles donn´es par √

XYT. On parcourt l’image√XYT en mettant les pixels `a z´ero. Le parcours se fait

de gauche `a droite puis de droite `a gauche, de haut en bas puis de bas en haut. On arrˆete de mettre les pixels `a z´ero d`es que l’on rencontre un pixel en mouvement d´etect´e par la dynamique de supraconductivit´e. Dans ce qui suit se trouve l’algorithme de combinaison appell´e ici super.

Algorithme 7 Super

Entr´ees: Images binaires IS et IProdExt de dimensions TxMxN obtenues respec-tivement avec l’algo 4 et le m´ecanisme d’attention

Sortie: IS: TxMxN

1: for t ∈ {0, ..., T − 1} do

2: for r ∈ {0, ..., M − 1} do

3: for c ∈ {0, ..., N − 1} do

4: if IS[t][r][c] == 255 and IProdExt[t][r][c] == 0 then

5: IS[t][r][c] ← 0

6: else

7: if IS[t][r][c] == 255 and IProdExt[t][r][c] == 255 then

8: c ← N 9: end if 10: end if 11: end for 12: end for 13: end for 14: for t ∈ {0, ..., T − 1} do 15: for r ∈ {0, ..., M − 1} do 16: for c ∈ {N − 1, ..., 0} do

17: if IS[t][r][c] == 255 and IProdExt[t][r][c] == 0 then

18: IS[t][r][c] ← 0

19: else

20: if IS[t][r][c] == 255 and IProdExt[t][r][c] == 255 then

21: c ← −1 22: end if 23: end if 24: end for 25: end for 26: end for 48

1: for t ∈ {0, ..., T − 1} do

2: for c ∈ {0, ..., N − 1} do

3: for r ∈ {0, ..., M − 1} do

4: if IS[t][r][c] == 255 and IProdExt[t][r][c] == 0 then

5: IS[t][r][c] ← 0

6: else

7: if IS[t][r][c] == 255 and IProdExt[t][r][c] == 255 then

8: r ← M 9: end if 10: end if 11: end for 12: end for 13: end for 14: for t ∈ {0, ..., T − 1} do 15: for c ∈ {0, ..., N − 1} do 16: for r ∈ {M − 1, ..., 0} do

17: if IS[t][r][c] == 255 and IProdExt[t][r][c] == 0 then

18: IS[t][r][c] ← 0

19: else

20: if IS[t][r][c] == 255 and IProdExt[t][r][c] == 255 then

21: r ← −1 22: end if 23: end if 24: end for 25: end for 26: end for 27: return IS 49

Chapitre 5

R´

ESULTATS ET DISCUSSION

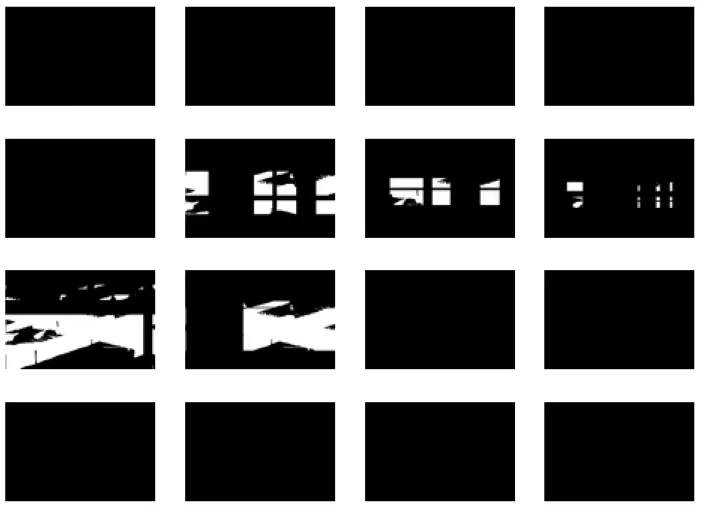

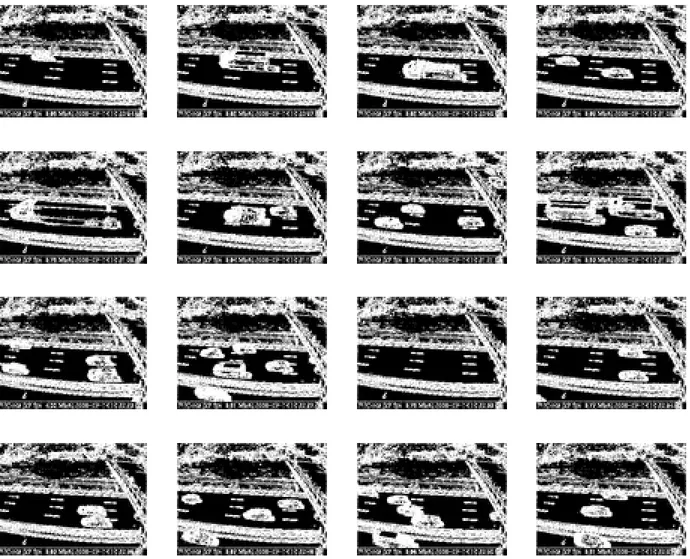

Dans ce qui suit les r´esultats obtenus sont montr´es pour cinq s´equences. Les images ont ´et´e redimensionn´ees pour l’affichage. Dans le r´esultat des images non redimensionn´ees, chaque pixel est soit noir, soit blanc. Une discussion des r´esultats est faite par la suite.

5.1 R´esultats

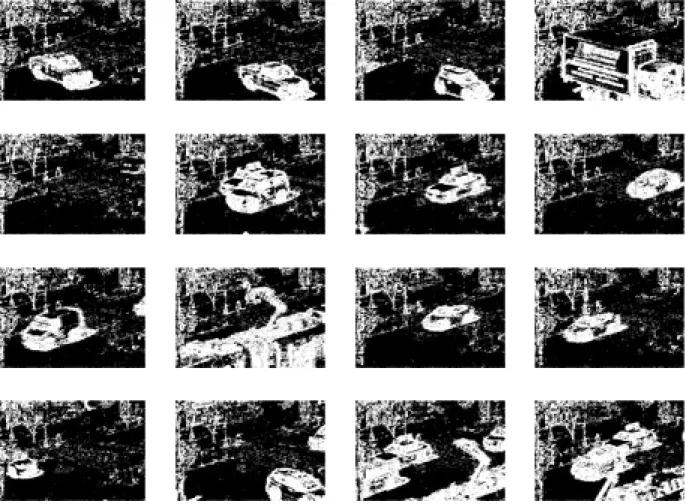

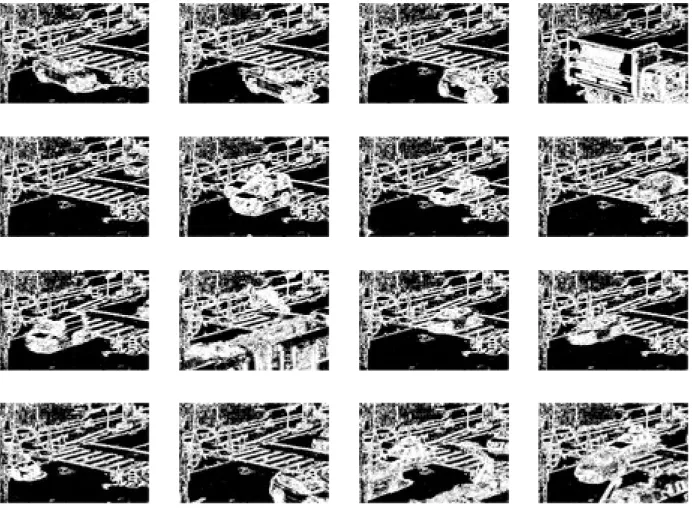

Ici sont montr´es les r´esultats des diff´erents algorithmes (4, 5, 6, et 7). L’algorithme 4 fait la d´etection en utilisant v. L’algorithme 5 fait la d´etection en utilisant le rotationnel de v. L’algorithme 6 fait la d´etection en utilisant l’acc´el´eration mat´erielle. Et enfin l’algorithme 7 (appell´e ici super) fait la d´etection en combinant le r´esultat de l’algorithme 4 et le m´ecanisme d’attention.

Figure 5.1: streetLight - v

Figure 5.2: streetLight - rotationnel de v

Figure 5.3: streetLight - norme de l’acc´el´eration mat´erielle

Figure 5.4: streetLight - super

Figure 5.5: streetLight - v´erit´es de terrain

Figure 5.6: abandonedBox - v

Figure 5.7: abandonedBox - rotationnel de v

Figure 5.8: abandonedBox - norme de l’acc´el´eration mat´erielle

Figure 5.9: abandonedBox - super

Figure 5.10: abandonedBox - v´erit´es de terrain

Figure 5.11: intermittentPan - v

Figure 5.12: intermittentPan - rotationnel de v

Figure 5.13: intermittentPan - norme de l’acc´el´eration mat´erielle

Figure 5.14: intermittentPan - super

Figure 5.15: intermittentPan - v´erit´es de terrain

Figure 5.16: highway - v

Figure 5.17: highway - rotationnel de v

Figure 5.18: highway - norme de l’acc´el´eration mat´erielle

Figure 5.19: highway - super

Figure 5.20: highway - v´erit´es de terrain

Figure 5.21: streetCornerAtNight - v

Figure 5.22: streetCornerAtNight - rotationnel de v

Figure 5.23: streetCornerAtNight - norme de l’acc´el´eration mat´erielle

Figure 5.24: streetCornerAtNight - super

Figure 5.25: streetCornerAtNight - v´erit´es de terrain

Voici les r´esultats num´eriques en termes de score F1. Ils ont ´et´e arrondis au centi`eme pr`es. Plus le score F1 est ´elev´e, mieux c’est. Les s´equences de la base de donn´ees sont divis´ees en plusieurs cat´egories selon le type de mouvement qu’elles contiennent. Quelques abr´eviations ont ´et´e utilis´ees pour tenir dans la page. Voici `a quoi elles r´ef`erent : dynBack r´ef`ere `a la cat´egorie dynamic background et intobjctMot r´ef`ere `a la cat´egorie intermittent object motion. La d´etection est faite en consid´erant les couleurs rouge, verte et bleu s´epar´ement. Un pixel est d´esign´e comme ´etant en mouvement si une des trois couleurs est en mouvement. Le premier tableau compare les r´esultats, pour toutes les s´equences, obtenus en utilisant le m´ecanisme d’attention et la combinaison entre le m´ecanisme d’attention et la dynamique de supraconduc-tivit´e (l’algorithme super). Le deuxi`eme tableau fait une comparaison par cat´egorie par rapport `a la meilleure technique publique 1 `a ce jour qui est obtenu en

combi-nant plusieurs algorithmes de d´etection de changement [3]. L’algorithme se nomme IUTIS-5 (In Unity There Is Strength).

S´EQUENCE # IMG DIM F1 √XYT ∩ Z F1 SUPER

highway 1700 320x240 0.63 0.91 baseline office 2050 360x240 0.73 0.85 pedestrians 1099 360x240 0.61 0.88 pets2006 1200 720x576 0.51 0.64 boats 7999 320x240 0.74 0.69 dynBack canoe 1189 320x240 0.63 0.66 fountain01 1184 432x288 0.92 0.92 fountain02 1499 432x288 0.87 0.90 overpass 3000 320x240 0.79 0.84 fall 4000 720x480 0.86 0.86 1http://changedetection.net/ 76

badminton 1150 720x480 0.38 0.51 cameraJitter boulevard 2500 352x240 0.84 0.85 sidewalk 1200 352x240 0.88 0.90 traffic 1570 320x240 0.81 0.84 abandonedBox 4500 432x288 0.85 0.62 intobjctMot parking 2500 320x240 0.95 0.42 streetLight 3200 320x240 0.96 0.69 sofa 2750 320x240 0.52 0.61 tramstop 3200 432x288 0.90 0.49 winterDriveway 2500 320x240 0.93 0.88 backdoor 2000 320x240 0.72 0.86 shadow bungalows 1700 360x240 0.89 0.90 busStation 1250 360x240 0.74 0.83 cubicle 7400 352x240 0.75 0.87 peopleInShade 1199 380x244 0.77 0.77 copyMachine 3400 720x480 0.61 0.75 corridor 5400 320x240 0.75 0.65 thermal library 4900 320x240 0.74 0.24 park 600 352x288 0.71 0.78 diningRoom 3700 320x240 0.72 0.69 lakeSide 6500 320x240 0.54 0.11 77

blizzard 7000 720x480 0.77 0.76 badWeather skating 3900 540x360 0.70 0.82 snowFall 6500 720x480 0.90 0.88 wetSnow 3500 720x540 0.71 0.85 port 0 17fps 3000 640x480 0.78 0.79 lowFramerate tramCrossroad 1fps 900 640x350 0.40 0.56 tunnelExit 0 35fps 4000 700x440 0.60 0.62 turnpike 0 5fps 1500 320x240 0.25 0.34 bridgeEntry 2500 630x430 0.86 0.65 nightVideos busyBoulvard 2760 640x364 0.71 0.75 fluidHighway 1364 700x450 0.50 0.48 streetCornerAtNight 5200 595x245 0.80 0.87 tramStation 3000 480x295 0.63 0.78 winterStreet 1785 624x420 0.66 0.62 continuousPan 1700 704x480 0.75 0.76 ptz intermittentPan 3500 560x368 0.60 0.66 twoPositionPtzCam 2300 570x340 0.63 0.81 zoomInZoomOut 1130 320x240 0.84 0.93 turbulence0 5000 720x480 0.94 0.96 turbulence turbulence1 4000 720x480 0.74 0.79 turbulence2 4500 645x315 0.98 0.98 turbulence3 2200 720x486 0.84 0.87 78

Cat´egorie F1 √XYT ∩ Z F1 SUPER F1 IUTIS-5 baseline 0.62 0.82 0.9567 dynamicBackground 0.80 0.81 0.8902 cameraJitter 0.73 0.78 0.8332 intermittentObjectMotion 0.85 0.62 0.7296 shadow 0.75 0.83 0.9084 thermal 0.70 0.49 0.8303 badWeather 0.77 0.83 0.8289 lowFramerate 0.51 0.58 0.7911 nightVideos 0.69 0.69 0.5132 ptz 0.71 0.79 0.4703 turbulence 0.88 0.9 0.8507 79

5.2 Discussion

Tout d’abord on remarque que dans la plupart des cas les r´esultats de l’algorithme super sont meilleurs que ceux de √XYT ∩ Z. Cependant cela est moins vrai pour

la cat´egorie intermittent object motion o`u on a des objets en mouvement par inter-mittence. Cela peut se comprendre car mˆeme si l’objet en mouvement est `a l’arrˆet √

XYT ∩ Z donne toujours des rectangles pourvu qu’il y ait dans l’image quelque

chose en mouvement. Concernant la dynamique de supraconductivit´e, d’un point de vue qualitatif, il est ´evident que tout ce qui est d´etect´e comme ´etant en mouvement n’est pas forc´ement en mouvement. Aussi tout ce qui est d´etect´e comme ´etant im-mobile n’est pas forc´ement imim-mobile. Les objets qui ´etaient en mouvement puis qui s’arrˆetent ne sont pas aussi bien d´etect´es. Le seuillage choisi y est certainement pour quelque chose, mais tout ne doit pas se r´esumer au seuillage. Les conditions (notam-ment en terme d’images par seconde) sous lesquelles les s´equences ont ´et´e enregistr´ees doivent ˆetre analys´ees plus en profondeur. Il y a aussi le fait que α et β partagent la mˆeme position spatiale en des temps differents. Malgr´es tout, differents types de mouvement sont quand mˆeme d´etect´es. Cela peut s’appr´ecier notamment dans les s´equences qui contiennent un feu de signalisation du type rouge, jaune et vert. Au feu rouge, les objets sont `a l’arrˆets et sont moins bien d´etect´es. Au feu vert les objets prennent de la vitesse et sont nettement mieux d´etect´es par le syst`eme. Visuellement, si d´etect´es, la forme globale des objets est tr`es bien conserv´ee. Les distorsions d’objets (si elles existent) sont vraiment mineures. Ceci est plus difficile `a r´ealiser avec les m´ethodes de type corr´elation de fenˆetres car cela devrait probablement impliquer un matching de fenˆetres `a multi ´echelles.

Cependant face `a l’algorithme IUTIS-5 des progr`es restent `a faire. Cela peut se comprendre car l’algorithme IUTIS-5 est le r´esultat de la combinaison de plusieurs algorithmes de d´etection de changement. Combinaison faite avec l’aide de la program-mation g´en´etique. Une mani`ere potentielle d’am´eliorer les r´esultats num´eriques serait

de voir s’il est possible de combiner les algorithmes 4, 5, et 6 pour faire la d´etection de mouvement. Car apr`es tout, le vecteur vitesse donne la vitesse en un pixel, le rotationnel du vecteur vitesse donne la tendance en un point `a ˆetre en rotation et la norme de l’acc´el´eration mat´erielle donne une force qui s’applique en un point. Donc pour chaque pixel nous disposons de trois informations relatives au mouvement. Notons aussi que par l’utilisation des trois images provenant des v´erit´es de terrain, l’algorithme super est avantag´e par rapport `a l’algorithme IUTIS-5 qui n’utilise pas les v´erit´es de terrain dans sa solution.

Chapitre 6

CONCLUSION

Dans ce m´emoire nous nous sommes int´eress´es au probl`eme de d´etection de mou-vement dans des s´equences d’images. La solution ´etudi´ee pour r´esoudre ce probl`eme peut ˆetre d´ecompos´ee en deux parties. Une premi`ere partie qui utilise un r´esum´e des v´erit´es de terrain comme m´ecanisme d’attention et une deuxi`eme partie qui utilise la dynamique de supraconductivit´e comme d´etecteur de mouvement g´en´eral. La combi-naison de ces deux techniques (l’algorithme super) donne des r´esultats parfois assez proches ou mˆeme meilleurs que ceux de la meilleure m´ethode `a ce jour. Cependant face `a l’algorithme IUTIS-5, l’algorithme super est avantag´e `a cause du m´echanisme d’attention. Concernant la dynamique de supraconductivit´e, le cadre consid´er´e nous permet d’obtenir entre autres pour chaque pixel : un vecteur vitesse, un vecteur acc´el´eration ainsi que le rotationnel du vecteur vitesse. Des ´el´ements qui peuvent sans doute aider `a la compr´ehension de ce ph´enom`ene d´eroutant qu’est la perception visuelle du mouvement.

Comme mentionn´e dans le chapitre sur les flots optiques, l’´equation de continuit´e est `a la base de plusieurs m´ethodes qui calculent le flot optique. L’exploration des ´equations de supraconductivit´e pour la mod´elisation du flot optique tient en deux raisons prin-cipales. La premiere raison tient au fait que l’´equation de continuit´e apparait dans la dynamique de supraconductivit´e et je n’ai pas trouv´e dans la litt´erature une m´ethode utilisant la dynamique de supraconductivit´e pour le calcul des flots optiques. La deuxi`eme raison tient au fait que la divergence du flot optique r´esultant de la dy-namique de supraconductivit´e n’est pas nulle. On s’affranchit donc de l’hypoth`ese de l’invariance lumineuse. Voil`a ce qui a motiv´e notre approche.

vecteur vitesse se font assez rapidement, de l’ordre de quelques secondes pour la plu-part des s´equences. Le calcul de l’acc´el´eration mat´erielle prend un peu plus de temps car pour l’obtenir il faut aussi calculer le vecteur vitesse. Remarquons aussi que du fait de leurs structures, les algorithmes 4, 5 et 6 sont parall´elisables. Cela veux dire qu’une impl´ementation parall`ele de ces algorithmes devrait r´eduire encore un peu plus le temps d’ex´ecution.

Pour la suite, il faudrait faire une ´etude statistique plus d´etaill´ee des angles du vecteur vitesse afin de pouvoir mieux classifier les zones mobiles et immobiles.

R´

EF´

ERENCES

[1] Yilmaz Alper, Javed Omar, and Mubarak Shah. Object tracking: A survey.

ACM Computing Surveys, 38(4), 2006.

[2] M. Bertalmio, A. L. Bertozzi, and G. Sapiro. Navier-stokes, fluid dynamics, and image and video inpainting. In Proc. IEEE Computer Vision and Pattern

Recognition (CVPR, pages 355–362, 2001.

[3] Simone Bianco, Gianluigi Ciocca, and Raimondo Schettini. How far can you get by combining change detection algorithms? CoRR, abs/1505.02921, 2015. [4] G. Carcassi. Derivation of Hamiltonian mechanics from determinism and

re-versibility. ArXiv e-prints, April 2013.

[5] Rumelhart David E., McClelland James L., and the PDP Research Group.

Par-allel Distributed Processing: Explorations in the microstructure of cognition,

vol-ume I: Foundations. The MIT Press, 1986.

[6] Massimo De Gregorio and Maurizio Giordano. Change detection with weight-less neural networks. In Proceedings of the 2014 IEEE Conference on Computer

Vision and Pattern Recognition Workshops, CVPRW ’14, pages 409–413,

Wash-ington, DC, USA, 2014. IEEE Computer Society.

[7] Benson Harris. University Physics. Wiley, 1996. 3 volumes.

[8] Hanna Kamyshanska and Roland Memisevic. The potential energy of an autoen-coder. IEEE Trans. Pattern Anal. Mach. Intell., 37(6):1261–1273, 2015.

[9] Cejnog Luciano Walenty Xavier. Implementation and evaluation of differential optical flow methods. 2013.

[10] Yingjie Miao and Jason J. Corso. Hamiltonian streamline guided feature extrac-tion with applicaextrac-tions to face detecextrac-tion. CoRR, abs/1108.3525, 2011.

[11] Sedky Mohamed, Moniri Mansour, and Chibelushi Claude C. Spectral 360: A physics-based technique for change detection. CVPR2014 workshop, 2014. [12] Neal Radford M. Handbook of Markov Chain Monte Carlo, chapter MCMC using

Hamiltonian dynamics. Chapman & Hall, 2011.

[13] Aasim Rafique, Ahmad Muqeem Sheri, and Moongu Jeon. Background scene modeling for PTZ cameras using RBM. In The International Conference on

Control, Automation and Information Sciences, ICCAIS 2014, Gwangju, South Korea, December 2-5, 2014, pages 165–169, 2014.

[14] Feynman Richard, Leighton Robert B., and Matthew L. Sands. The Feynman

Lectures on Physics. Addison-Wesley, 1963. 3 volumes.

[15] Sam Roweis and Zoubin Ghahramani. A unifying review of linear gaussian mod-els. Neural Comput., 11(2):305–345, February 1999.

[16] Stuart Russell and Norvig Peter. Artificial Intelligence: A modern Approah. Prentice Hall, 2003.

[17] Steven H. Strogatz. Nonlinear dynamics and chaos. Perseus Books Publishing, LLC, 2000.

[18] Linli Xu, Yitan Li, Yubo Wang, and Enhong Chen. Temporally adaptive re-stricted boltzmann machine for background modeling. In Proceedings of the

Twenty-Ninth AAAI Conference on Artificial Intelligence, AAAI’15, pages 1938–

1944. AAAI Press, 2015.

[19] Pei Xu, Mao Ye, Xue Li, Qihe Liu, Yi Yang, and Jian Ding. Dynamic background learning through deep auto-encoder networks. In Proceedings of the 22Nd ACM

International Conference on Multimedia, MM ’14, pages 107–116, New York,

NY, USA, 2014. ACM.

[20] Wang Yi, Jodoin Pierre-Marc, Porikli Fatih, Konrad Janusz, Benezeth Yannick, and Ishwar Prakash. Cdnet 2014: An expanded change detection benchmark dataset. CVPR2014 workshop, 2014.

[21] Zoran Zivkovic. Improved adaptive gaussian mixture model for background sub-traction. In Proceedings of the Pattern Recognition, 17th International

Confer-ence on (ICPR’04) Volume 2 - Volume 02, ICPR ’04, pages 28–31, Washington,

DC, USA, 2004. IEEE Computer Society.

Annexe A

Cette annexe contient les d´emonstrations math´ematiques de certaines formules utilis´ees. Voici les relations `a d´emontrer :

∂P ∂t = −∇ · ( 1 2mψ ∗(¯h i∇ − qA)ψ + 1 2mψ( ¯h i∇ − qA)ψ ∗) (A.1) J = ¯h m( 1 2∇θ − 1 ¯hqA)ρ (A.2) ∇ × v = (0, 0, −mq ( 1 2√ρsin( θ 2) ∂ρ ∂x + 1 2 ∂θ ∂xAx− 1 2√ρcos( θ 2) ∂ρ ∂y + 1 2 ∂θ ∂yAy)) (A.3)

Montrez que ∂P ∂t = −∇ · ( 1 2mψ ∗(¯h i∇ − qA)ψ + 1 2mψ( ¯h i∇ − qA)ψ ∗) (A.4) On a P = ψ∗ψ (A.5) Donc ∂P ∂t = ψ ∗∂ψ ∂t + ψ ∂ψ∗ ∂t (A.6)

L’´equation de Schr¨odinger donne

−¯hi∂ψ∂t = Hψ (A.7) H a pour formule H = 2m1 (¯h i∇ − qA) · ( ¯h i∇ − qA) + qφ (A.8) Alors ∂ψ ∂t = − i ¯h( 1 2m( ¯h i∇ − qA) · ( ¯h i∇ − qA)ψ + qφψ) (A.9) On en d´eduit que ∂ψ∗ ∂t = i ¯h( 1 2m( ¯h −i∇ − qA) · ( ¯h −i∇ − qA)ψ ∗+ qφψ∗) (A.10)

Tout ceci nous conduit `a l’expression suivante

∂P ∂t = − i ¯h( 1 2mψ ∗(¯h i∇−qA)·( ¯h i∇−qA)ψ+qφψ ∗ψ− 1 2mψ(− ¯h i∇−qA)·(− ¯h i∇−qA)ψ ∗−qφψψ∗) (A.11) 88

En d´eveloppant et en simplifiant l’expression pr´ec´edente on a ∂P ∂t = −1 2m( ¯h iψ ∗∇2ψ−qAψ∗∇ψ−ψ∗∇·qAψ+i ¯hψ ∗(qA)2ψ−¯h iψ∇ 2ψ∗−ψqA∇ψ∗−ψ∇·qAψ∗−i ¯h(qA) 2ψ∗ (A.12) Ce qui donne ∂P ∂t = − 1 2m( ¯h iψ ∗∇2ψ − qAψ∗∇ψ − ψ∗∇ · qAψ − ¯h iψ∇ 2ψ∗− qAψ∇ψ∗− ψ∇ · qAψ∗) (A.13) On constate les relations suivantes

ψ∗∇2ψ = ∇ · ψ∗∇ψ − ∇ · ψ∗.∇ψ (A.14)

ψ∇2ψ∗ = ∇ · ψ∇ψ∗− ∇ · ψ.∇ψ∗ (A.15)

qAψ∗∇ψ + ψ∇ · qAψ∗ = ∇ · ψqAψ∗ (A.16)

qAψ∇ψ∗+ ψ∗∇ · qAψ = ∇ · ψ∗qAψ (A.17)

Ce qui fait que

∂P ∂t = − 1 2m( ¯h i∇ · ψ ∗∇ψ −¯h i∇ · ψ∇ψ

∗− ∇ · ψqAψ∗− ∇ · ψ∗qAψ) (A.18)

Il fallait montrer que ∂P ∂t = −∇ · ( 1 2mψ ∗(¯h i∇ − qA)ψ + 1 2mψ( ¯h i∇ − qA)ψ ∗) (A.19)

En d´eveloppant cette expression on a

∂P ∂t = − 1 2m(∇ · ψ ∗¯h i∇ψ − ∇ · ψ ∗qAψ − ∇ · ψ¯h i∇ψ ∗− ∇ · ψqAψ∗) (A.20)

ce qui est identique `a l’´equation A.18

Montrez que J = ¯h m( 1 2∇θ − 1 ¯hqA)ρ (A.21)

On a les relations suivantes d´ej`a ´etablies

∂P ∂t = −∇.J (A.22) ψ = ρ1/2eiθ/2 (A.23) ψ∗ = ρ1/2e−iθ/2 (A.24) Ce qui donne J = 1 2mρ 1/2e−iθ/2(¯h i∇ − qA)ρ 1/2eiθ/2+ 1 2mρ 1/2eiθ/2

(−¯hi∇ − qA)ρ1/2e−iθ/2 (A.25)

Donc J = 1 2mρ 1/2e−iθ/2¯h i∇ρ 1/2eiθ/2

−2m1 ρqA−2m1 ¯hiρ1/2eiθ/2∇ρ1/2e−iθ/2− 1

2mρqA (A.26) On a ∇ρ1/2eiθ/2 = (∂ρ 1/2eiθ/2 ∂x , ∂ρ1/2eiθ/2 ∂y ) (A.27) ∇ρ1/2e−iθ/2 = (∂ρ 1/2e−iθ/2 ∂x , ∂ρ1/2e−iθ/2 ∂y ) (A.28)

La r`egle du produit des d´eriv´ees donne

∂ρ1/2eiθ/2 ∂x = 1 2 1 √ρeiθ/2∂ρ ∂x + i 2 √ρeiθ/2∂θ ∂x (A.29) ∂ρ1/2e−iθ/2 ∂x = 1 2 1 √ρe−iθ/2∂ρ ∂x − i 2 √ ρe−iθ/2∂θ ∂x (A.30) 90

Similairement ∂ρ1/2eiθ/2 ∂y = 1 2 1 √ρeiθ/2∂ρ ∂y + i 2 √ρeiθ/2∂θ ∂y (A.31) ∂ρ1/2e−iθ/2 ∂y = 1 2 1 √ρe−iθ/2∂ρ ∂y − i 2 √ρe−iθ/2∂θ ∂y (A.32)

En rempla¸cant les d´eriv´ees par leurs expressions et en simplifiant on arrive `a la relation suivante 1 2mρ 1/2e−iθ/2¯h i∇ρ 1/2eiθ/2 −2m1 ¯hiρ1/2eiθ/2∇ρ1/2e−iθ/2 = ¯h 1 2mρ∇θ (A.33) Donc J = −1 mρqA + ¯h 1 2mρ∇θ (A.34)

En factorisant cette expression on obtient la relation `a d´emontrer

J = ¯h m( 1 2∇θ − 1 ¯hqA)ρ (A.35) 91

Montrez que ∇ × v = (0, 0, −mq( 1 2√ρsin( θ 2) ∂ρ ∂x + 1 2 ∂θ ∂xAx− 1 2√ρcos( θ 2) ∂ρ ∂y + 1 2 ∂θ ∂yAy)) (A.36) On a d´ej`a la relation suivante

v = 1 m(

1

2¯h∇θ − qA) (A.37)

Comme le rotationnel d’un gradient est toujours nul, on a

∇ × v = −mq ∇ × A (A.38)

Si on consid`ere que A = (Ax, Ay, Az) avec Az = 0 alors

∇ × A = (∂A∂yz − ∂A∂zy,∂Ax ∂z − ∂Az ∂x , ∂Ay ∂x − ∂Ax ∂y ) (A.39) Comme Az = 0 alors

∇ × A = (0, 0,∂A∂xy −∂A∂yx) (A.40)

On a Ax = √ρcos(θ2) et Ay = √ρsin(θ2)

Ce qui fait que

∂Ay ∂x = 1 2√ρsin( θ 2) ∂ρ ∂x + 1 2 ∂θ ∂xAx (A.41) Et ∂Ax ∂y = 1 2√ρcos( θ 2) ∂ρ ∂y + 1 2 ∂θ ∂yAy (A.42) D’o`u ∇ × A = (0, 0,2√ρ1 sin(θ 2) ∂ρ ∂x + 1 2 ∂θ ∂xAx− 1 2√ρcos( θ 2) ∂ρ ∂y + 1 2 ∂θ ∂yAy) (A.43) 92

En se rappelant l’´equation A.38, on a bien que ∇ × v = (0, 0, −mq( 1 2√ρsin( θ 2) ∂ρ ∂x + 1 2 ∂θ ∂xAx− 1 2√ρcos( θ 2) ∂ρ ∂y + 1 2 ∂θ ∂yAy)) (A.44) 93