ةيبعشلا ةيطارقميدلا ةيرئازجلا ةيروهمجلا و ةراز يلاعلا ميلعتلا ثحبلاو يملعلا

République Algérienne Démocratique et Populaire

Ministère de l’enseignement Supérieur et de La Recherche Scientifique

Projet De Fin D’études Pour L’obtention Du Diplôme

De Master

Option : Automatique et Informatique Industrielle

Thème :

Présenté par : Membres de jury:

Chettibi Ismahane Président :H. Boubertakh

Zenifeche Bilal Examinateur: Benslimane Encadreur :

M

me H. BoudjedirAnnée Universitaire : 2017- 2018

ماج

جيج ةع

ل

مولعلا ةيلك

ايجولونكتلاو

مسق

تايللاا

ةيولخلاو ةيئيزجلا ايجولويبلا مسق

Université de JijelFaculté des Sciences et Technique

Département d’Automatique

Commande adaptative par Réseaux

de Neurones Artificiels d’un

Système non Linéaire incertain

Résumé :

Les méthodes de commande non linéaire se basent sur l'existence d'un modèle analytique du système. Cependant, pour des systèmes non linéaires complexes, le modèle peut être inexploitable, imprécis ou tout simplement inexistant. Les réseaux de neurones sont récemment apparus comme des approches capables de reproduire le comportement complexe des systèmes non linéaires. Dans cette étude, nous allons combiner la commande adaptative et les réseaux neuronaux pour profiter de leurs caractéristiques dans la résolution de problèmes de commande des systèmes non linéaires. La première étape consiste à éclaircir les notions de base sur des commandes stabilisantes les systèmes non linéaires. Ensuite, nous présentons un aperçu de l'approximateur universel choisie dans ce travail, les réseaux de neurones artificiels. Le deuxième axe de travail est le développement détaillé de deux commandes adaptatives neuronales directes pour des systèmes non linéaires de type SISO et MIMO respectivement pour estimer les fonctions non linéaires inconnues. De plus, une analyse de la stabilité des structures de commande implémentées est réalisée par l'approche de Lyapunov. Pour chaque approche de commande développée, des résultats de simulation sont présentés pour montrer ses performances.

Mots clés :

systèmes non linéaires, surface de glissement, commande adaptative, réseaux de neurones artificiel, stabilité de Lyapunov.Abstract:

Nonlinear control methods are based on the existence of an analytical model of the system. However, for complex non-linear systems, the model may be impractical, inaccurate or simply non-existent. Neural networks have recently emerged as approaches capable of reproducing the complex behavior of nonlinear systems. In this study, we will combine adaptive control and neural networks to take advantage of their characteristics in solving control problems in non-linear systems. The first step is to clarify the basic notions of controls stabilizing nonlinear systems. Next, we present an overview of the universal approximator chosen in this work, Artificial Neural Networks. The second line of work is the detailed development of two direct neural adaptive commands for nonlinear systems of the SISO and MIMO type, respectively, to estimate unknown nonlinear functions. In addition, an analysis of the stability of the implemented control structures is performed by the Lyapunov approach. For each control approach developed, simulation results are presented to show its performance.

:صخلم دمتعت قرط مكحتلا ريغ ةيطخلا ىلع دوجو جذومن يليلحت ماظنلل . عمو ،كلذ ةبسنلاب مظنلل ريغ ةيطخلا ،ةدقعملا دق نوكي جذومنلا ريغ يلمع وأ ريغ قيقد وأ ريغ دوجوم ةطاسبب . ترهظ تاكبشلا ةيبصعلا ارخؤم جهنك ةرداق ىلع ةداعإ جاتنإ كولسلا دقعملا مظنلل ةيطخلالا . يف هذه ،ةساردلا اننإف فوس عمجت نيب ةرطيسلا ىلع فيكتلا تاكبشلاو ةيبصعلا ةدافتسلال نم اهصئاصخ يف لح لكاشم ةرطيسلا ىلع ةمظنأ ريغ ةيطخلا . ةوطخلا ىلولأا يه حيضوت ميهافملا ةيساسلأا طباوضلل يتلا تبثت ةمظنلأا ريغ ةيطخلا . دعب ،كلذ مدقن ةرظن ةماع ىلع سايقم بيرقتلا لماشلا راتخملا يف اذه ،لمعلا تاكبشلا ةيبصعلا ةيعانطصلاا . رطسلا يناثلا نم لمعلا وه ريوطت ةلصفم لكل نم طباوضلا ىلع فيكتلا ةيبصعلا ةرشابملا عونل SISO مظن MIMO ليلحتءارجإمتي،كلذىلإةفاضلإاب .ةلوهجمةيطخلاريغفئاظولاريدقتليلاوتلاىلعةيطخلاريغ رارقتسلا لكايه مكحتلا ةذفنملا نم للاخ جهن Lyapunov. ةاكاحملاجئاتنضرعمتي،هريوطتمتمكحتجهنلكلةبسنلاب راهظلإ اهئادأ . :ةيحاتفملا تاملكلا ريغ ةمظنأ ،ةيطخ حطس ،قلزنم مكحت ،يفيكت ةيبصع تاكبش ،ةيعانطصا رارقتسا فونوبايل .

Remerciements

On remercie tout d’abord Allah, le tout puissant, qui nous a donné le courage,

La force et la patience pour accomplir ce modeste travail.

Nous exprimons nos profonds remerciements à notre encadreur

Mme. Boudjedir Hana pour sa disponibilité et son aide précieuse.

Nous remerciements aux membres de jury qui ont accepté De jurer notre travail.

Enfin nous exprimons notre profonde reconnaissance à tous les enseignants

Qui ont contribué par leur compétence à notre formation. Merci…

Dédicace

A mon père et ma mère: Aucune dédicace ne saurait exprimer ma profonde gratitude et ma vive reconnaissance, et aucune dédicace ne pourra compenser les sacrifices qui ont consentis pour

mon bien être et mon bonheur

A tous mes sœurs et mes frères A toute ma famille Zenifeche

A tous mes amies de la promotion 2018

Tous ceux que j’aime et ceux qui m’aiment

Dédicace

A mon père et ma mère: Aucune dédicace ne saurait exprimer ma profonde gratitude et ma vive reconnaissance, et aucune dédicace ne pourra compenser les sacrifices qui ont consentis pour

mon bien être et mon bonheur

A tous mes sœurs et mes frères A toute ma famille Chettibi

A tous mes amies de la promotion 2018

Tous ceux que j’aime et ceux qui m’aiment

Liste des figures Liste des tableaux

Introduction générale ... 1

Chapitre 1 : Notions sur des commandes stabilisant 1. Introduction ... 4

2. Commande par mode glissant ... 4

2.1. Problèmes de la commande par mode glissant ... 5

3. Commande par backstepping ... 5

3.1. Algorithme backstepping ... 6

4. Commande adaptative ... 8

4.1. Définition de la Commande adaptative ... 8

4.2. Principe de la commande adaptative ... 8

4.3. Commande adaptative indirecte ... 9

4.4. Commande adaptative direct ... 9

4.5. Concept de la commande adaptative ... 10

5. Méthode de Lyapunov ... 10

5.1. Première méthode de Lyapunov (indirecte) ... 11

5.2. Deuxième méthode de Lyaponov (méthode direct) : ... 11

6. Exemple d’application ... 12

7. Conclusion ... 15

Chapitre 2 : Réseaux de Neurones Artificiels <<RNA>> 1. Introduction ... 16 2. Réseaux de neurones ... 16 2.1. Neurone biologique ... 17 2.1.1 Structure de neurone ... 17 2.2. Neurone formel ... 18 2.2.1 Poids ... 18

2.2.2. Seuil ... 18

2.2.3. Fonction d’activation ... 18

3. Réseau de neurones artificiels ... 20

3.1. Définition ... 20 3.2. Fonctionnement de RNAs ... 20 3.3. Historique de RNAs ... 20 3.4. Perceptron multicouche ... 21 3.4.1. Algorithme de rétro-propagation ... 22 3.4.1. a. Algorithme de gradient ... 23 3.4.1.b. Étapes de rétro-propagation ... 23

3.5. Réseaux de neurones à fonction de base radiale (RBF) ... 25

4. Théorème d’approximation universelle ... 26

5. Avantages et inconvénients des réseaux ... 26

5.1. Avantage ... 26

5.2. Inconvénients ... 26

6. Conclusion ... 27

Chapitre 3 : Commande adaptative Neuronale d’un système non linéaire Mono variable 1. Introduction ... 28

2. Position de problème ... 28

3. Synthèse de la loi de commande adaptative par RNA ... 30

3.1Commande adaptative par Réseau de Neurone Artificiel ... 31

3.2 Analyse de la stabilité ... 33

4. Résultat de simulation ... 34

5. Conclusion ... 36

Chapitre 4 : Commande mode glissent intégral adaptative par RNA D’un système multi variable 1. Introduction ... 37

4. Analyse de stabilité ... 41 5. Résultat de simulation ... 42 6. Conclusion ... 47

Liste des figures

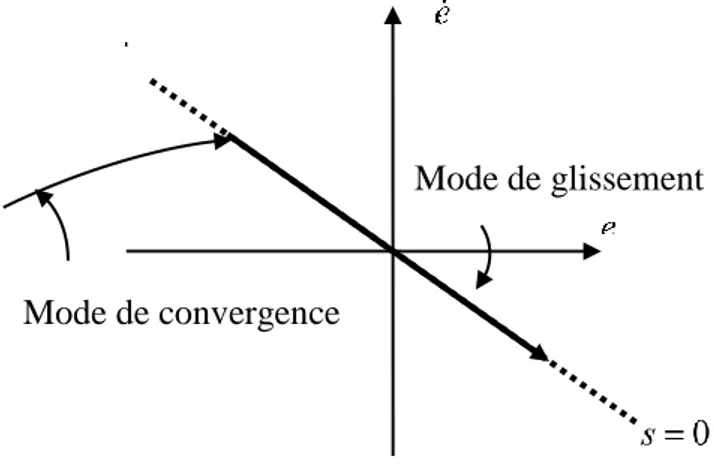

Figure 1.1 : Phenomene de réticence ... 5

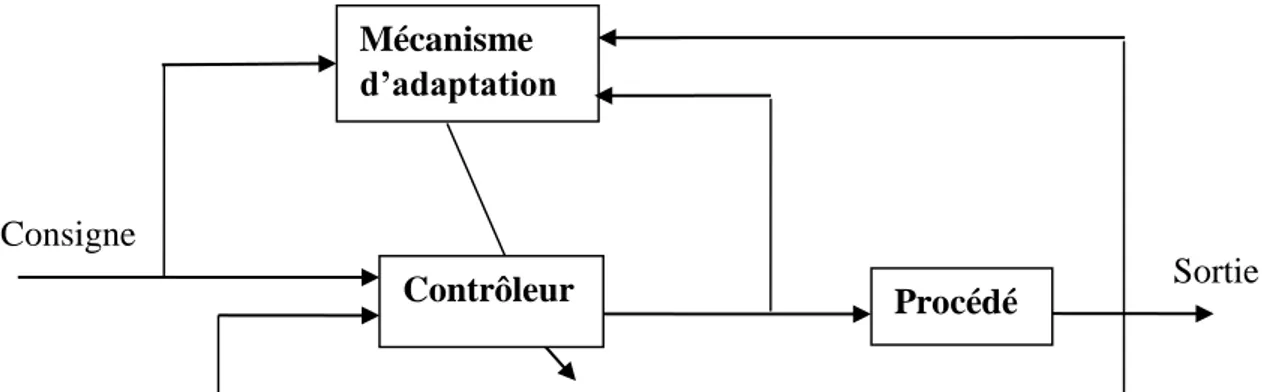

Figure 1.2 : Principe de la commande adaptative ... 8

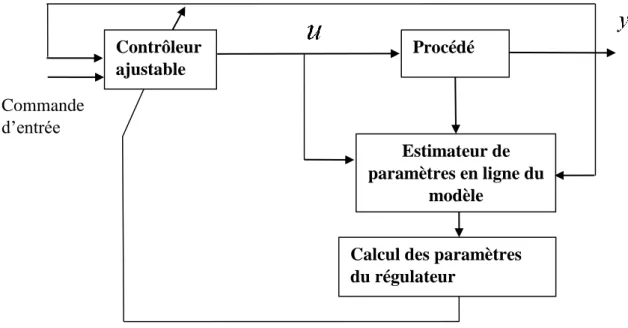

Figure 1.3 : Commande adaptative indirecte ... 9

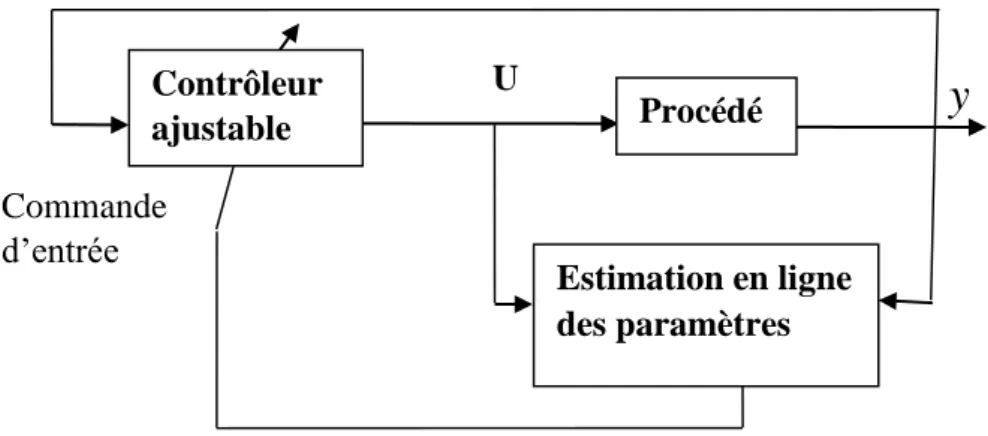

Figure 1.4 : Commade adaptative directe ... 10

Figure 1.5 : Pendule inversé ... 12

Figure 1.6 : Les sortie de systeme ... 13

Figure 1.7 : Les erreurs de poursuite ... 13

Figure 1.8 : Signale de commande ... 13

Figure1.9 : Les sorties de systeme ... 14

Figure 1.10 : Les erreurs de poursuite ... 14

Figure 1.11 : Signal de commande ... 14

Figure 2.1 : Schéma d’un neurone biologique ... 17

Figure 2.2 : Neurone formel ... 18

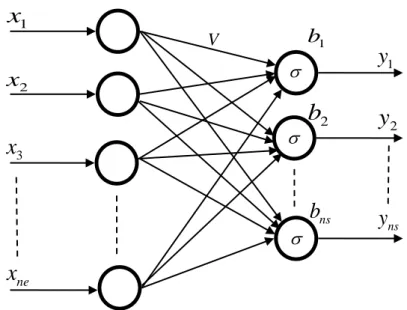

Figure 2.3 : Perceptron à deux couches ... 21

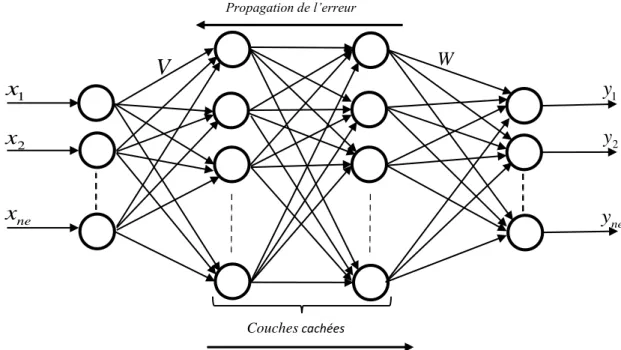

Figure 2.4 : Perceptron multicouche ... 22

Figure 2.5 : Mécanisme d’apprentissage ... 23

Fig 2.6 : Réseaux à fonction de base radiale... 25

Figure 3.1 : RNA à une seule couche cachée ... 31

Figure 3.2 : Schéma bloc de la commande adaptative par RNA d’un système SISO... 33

Figure 3.5 : Les signaux de commande sans perturnation ... 35

Figure 3.6 :Sortie de système avec perturbation ... 35

Figure 3.7 : Les errures de systmème avec perturbation ... 36

Figure 3.8 : Les signaux de la commande avec perturbation ... 36

Figure 4.1 : RNA à trois couches cachées... 40

Figure 4.2 : Schéma bloc de commande adaptative neuronale d’un système MIMO ... 42

Figure 4.3 : Robot Puma ... 42

Figure 4.4 : Les sortie de système ... 44

Figure 4.5 : Les errures de poursuite ... 45

Figure 4.6 : Les signaux de commande ... 46

Figure 4.7 : Les gains de commande ... 46

Liste des Tableaux

Tableau 2.1 Fonctions d’activation ... 19 Tableau 4.1 Parametres de simulations ... 44

1

Introduction générale

Récemment, les recherches sur la commande des systèmes non linéaires a connu des grand développements, puisque la majorité des systèmes en réalité sont non linéaires, nous pouvons alors citer comme exemples les systèmes mécaniques, électromécaniques et chimiques (avions, véhicules, régulateurs thermiques, réacteurs chimiques, … etc.). Contrairement à commande linéaire, la commande non linéaire ne dispose pas des solutions universelles pour l'analyse des systèmes ou la conception de leurs contrôleurs. La plupart des approches de contrôle non-linéaires nécessitent la connaissance du modèle mathématique du système.

Dans les systèmes non linéaires les techniques de commande sont satisfaisantes mais pour des plages de fonctionnement restreint et ont des plusieurs problèmes, par exemple : le PID [Bou04], l'approche backstepping [Ban10, Yim01], son problème principal est « l'explosion de complexité » causée par la dérivation des commandes virtuelles. Une autre commande Connu par sa robustesse et sa simplicité dans la mise en œuvre, la commande par mode glissant [Utk77], [Slo84], [Per02], cette technique a été largement utilisée pour commander une large classe de systèmes non linéaires, Cependant, cette loi de commande représente quelques inconvénients tel que le problème de broutement. En général, les lois de commande conventionnelles peuvent être insuffisantes parce qu'elles ne sont pas particulièrement robustes lorsque les exigences de précision et les autres caractéristiques dynamiques des systèmes sont strictes.

La commande adaptative a donné une solution aux problèmes de commande des systèmes non linéaire. Les chercheurs ont montrés qu’un contrôleur avec des paramètres fixes n’était pas toujours capable d’assurer les performances désirées, surtout quand les paramètres du système varient avec le temps. La commande adaptative est donc différente de la commande normale dans la mesure où ses paramètres sont variables et modifiées par un mécanisme en temps réel basé sur l'état du système contrôlé. Cependant, les méthodes de conception de la commande adaptative standard [Slo91], [Han, 04], [Cha00] sont limitées aux systèmes non linéaires qui peuvent être linéairement paramétrisés. Malheureusement, il est souvent difficile, voire impossible, d'obtenir cette forme de paramètrisation linéaires, en particulier pour le système physique complexe et incertain. Ce fait a été le facteur de motivation derrière l’utilisation d’approximateurs non linéaires afin de pallier à ces problèmes décrits précédemment. Dans ce contexte, dans la littérature plusieurs commandes adaptatives pour des systèmes non linéaires

Introduction générale

2

affines dans la commande ont été présentées, où l’approximation est assurée soit par un réseau de neurones soit par un système flou ou un réseau d’ondelettes [Lab05], [Bou08], [Nor98], [Hus07], [Fer05], [Xu, 07], [Bas, 08],

L'un des défis de l'homme consiste à reproduire son propre mode de raisonnement et de comportement. De ce désir a généré des réseaux de neurones, ils constituent une famille de fonctions non linéaires paramétrées, Les réseaux de neurones sont définis comme des approximateurs adaptables capables de reproduire le comportement complexe des systèmes non linéaires. Les premières applications des réseaux de neurones ne sont pas contrôlées par des analyses de stabilité strictes. Plus tard, la théorie de Lyapunov a été introduite pour calculer les lois adaptatives afin d'assurer la stabilité du système en boucle fermée.

En résumé, le travail présenté dans ce mémoire se concentre sur la combinaison de la commande adaptative et de l'intelligence artificielle pour résoudre quelques problèmes des systèmes non linéaires incertains. Plus précisément, on s'intéressera à la commande adaptative associée aux critères d'approximation des fonctions non linéaires par des réseaux neuronaux appliquée à une classe de systèmes non linéaires incertains.

L’ensemble du travail est regroupé en quatre chapitres comme suit :

Le premier chapitre est consacré à la présentation de quelques de techniques de commande non linéaire classiques et la commande adaptative. L’approche de Lyapunov pour étudier la stabilité des systèmes non linéaires est donnée. Des simulations ont été effectuées pour montrer les limitations de la commande backstepping.

Dans le deuxième chapitre, une description générale de l’approximateur universel Réseaux de Neurones Artificiel (RNA) est présentée. Les étapes remarquables dans son développement depuis les neurones formels jusqu’à le réseau multicouche avec un règle d’apprentissage ont été mentionnée. L’algorithme de rétro propagation pour l’apprentissage des poids du RNA a été présenté.

Le troisième chapitre a comme objectif la synthèse d’une loi de commande adaptative par RNA d'un système non linéaire SISO. Cette méthode, permettant de combiner la théorie de la commande adaptative avec l'intelligence artificielle (réseaux de neurone) pour estimer la

3

commande équivalente inconnue. Le schéma de commande dans ce chapitre est examiné par simulation sur le modèle dynamique d’un pendule inversé en présence de perturbations externe. Le quatrième chapitre présente le développement de la commande par mode glissent intégral adaptative par RNA d’une classe de système multi-variable. Une surface de glissement avec action intégrale est choisie pour éliminer les erreurs de poursuite. Un RNA multicouche est utilisé pour approximer le modèle dynamique inconnu. Une loi d’adaptation est implémentée pour estimer le gain de la commande stabilisante. La méthode de Lyapunov est utilisée pour prouver la stabilité du système global. Des simulations ont été effectuées pour montrer l’efficacité de la technique utilisée.

Les techniques de commande représenter assurent la stabilité les boucles de commande, la robustesse vis-à-vis des incertitudes et/ou de perturbations.

4

Notions sur des commandes stabilisantes

1. Introduction

À travers ce chapitre, on va donner quelques notions sur la stabilité des systèmes non linéaires et les techniques de commande utilisées pour atteindre cette performance. Parmi ces techniques on trouve la commande adaptative. Cette dernière est utilisée pour estimer en ligne les paramètres inconnus du contrôleur (commande adaptative directe) ou du modèle dynamique du système à contrôler (commande adaptative indirecte).

Les schémas de commande adaptative donnent de nombreuses solutions aux problèmes rencontrés par l’utilisation des techniques classiques tels que l'incertitude des paramètres du modèle dynamique et la présence des perturbations.

Dans ce chapitre, un bref rappel sur deux techniques de commande est exposé. La premier est la commande par backstepping et la deuxième est la commande par mode glissant. Ensuite, deux schémas de la commande adaptative avec leurs concepts de base ont été présentés. L’approche directe de Lyapunov pour étudier la stabilité des systèmes non linéaires est montrée afin de la pouvoir utilisée par la suite. Des simulations ont été effectuées à la fin de ce chapitre sur le modèle dynamique d’un pendule inversé afin de montrer les avantages et les inconvénients des commandes classiques.

2. Commande par mode glissant

La commande par mode glissant a connu un essor considérable durant les dernières décennies [Utk07], [Fri08], [Bio07]. Ceci est dû principalement à la propriété de convergence rapide et en temps fini des erreurs, ainsi, que la grande robustesse par rapport aux erreurs de modélisation et certains types de perturbations extérieures [Ham03].

Une commande par mode glissant typique est composée d’une partie équivalente et un autre terme de robustesse utilisée pour compenser les incertitudes de modèle dynamique [Bou15]. La conception de la loi de commande par mode glissant est résumée en deux points :

La définition d'un surface de glissement, de sorte que tous les trajectoires du système correspondent au comportement requis pour la poursuite, la régulation et la stabilité.

Chapitre 1 : Notions sur des commandes stabilisantes

5

La détermination d’une loi de commande qui est capable de garantit la convergence de toutes les trajectoires d’état vers la surface de glissement et de le garder sur cette surface.

( )

eq

U U k sign s (1.1) Ueq est la commande équivalente, S : surface de glissement et k : gain du terme discontinu.

2.1. Problèmes de la commande par mode glissant

Malgré les avantages de la commande par mode glissant, sa performance est obtenue au détriment de certains inconvénients majeurs :

le Phénomène de réticence (Chattering) provoqué par la partie discontinue de cette commande. Celui-ci se caractérise par de fortes oscillations des trajectoires du système autour de la surface de glissement. Les principales raisons à l’origine de ce phénomène sont les limitations des actionneurs ou les retards de commutation au niveau de la commande [Deg13].

Le système est constamment soumis à une commande élevée pour assurer son rapprochement avec la condition désirée et ceci n'est pas souhaitable.

3. Commande par backstepping

Le développement de la technique du backstepping au début des années 90 a donné un nouveau souffle à la commande des systèmes non linéaires, qui malgré les grands progrès réalisés, il manquait des approches générales. Cette technique est une méthode de détermination

Mode de glissement

Mode de convergence

Figure 1.1 : phénomène de réticence.

6

de la loi de commande, il permet aussi la reconstruction systématique et récursive de la fonction de Lyapunov et en conséquence la conception itérative de la loi de commande stabilisante [Bou15]. Cette technique est destinée pour une classe bien spécifique des systèmes non linéaires dites triangulaire inferieures [Cha96, kha96], son modèle d’état est donné par les équations suivantes : 1 1 1 1 1 2 2 2 1 2 2 1 2 3 1 2 1 2 1 1 2 1 2 ( ) ( ) ( , ) ( , ) ( , , , ) ( , , , ) ( , , , ) ( , , , ) i i i i i i n n n n n x f x g x x x f x x g x x x x f x x x g x x x x x f x x x g x x x u (1.2)

Avec : f sont des fonctions non linéaires, i g :sont des gains de commande non nuls,i x : sont i les variables d’états ,u : est l’entrée de système ,n :est l’ordre de système.

3.1. Algorithme backstepping

L’algorithme backstepping et les étapes qu’on doit effectuer pour construire la loi de commande stabilisante sont présentées dans cette section.

La variable à contrôler yest défini comme suit : 1

yx (1.3)

Et l’erreur de poursuite e1 par:

1 d

e y y (1.4)

Avec ydest la sortie désirée du système. Le choix de la sortie implique que le système à un degré relatif régale à son ordren , alors la conception de la loi de commande u nécessite n itérations, le détail de la iième itération est comme suit :

- Itération i. avec i1: ,n l’objectif de cette itération est de stabiliser le sous-système i

donné par l’équation suivant :

1 1 1

( , , ) ( , , ) ,

i i i i i i

Chapitre 1 : Notions sur des commandes stabilisantes

7

Selon la technique backstepping, le sous-système i est stabilisé par une commande virtuelle notéei. Son expression est choisie comme suit :

1 1 1

1 , 0, i i i i i i i i f g e k e k g (1.6)La fonction de Lyapunov candidate donnée par (1.7) est utilisée pour étudier la stabilité, donc :

2 2 1 1 1 1 1 1 1 ( , , ) ( , , ) , 2 2 i i i i i i j j L e e L e e e e

(1.7)Dans ce cas, la première dérivée temporelle de L est calculée : i 1 2 1 1 1 1 1 1 1 1 1 ( , , ) ( , , ) ( ) i i i i i i i j j i i i i i i i j L e e L e e e e k e e f g x g e

(1.8)Remplacent l’expression de la commande virtuelle i dans l’équation (1.8) on obtient :

2 1 1 1 ( , , ) ( ), i i i j j i i i i j L e e k e g e x

(1.9)Il est à noter que xn1u, 0 x1d, g0 0, e0 0 et L0 0 ;la

ième

n itération donne l’expression de la loi de commande stabilisante de système complet u , dont :

1 1 1

1 , 0 n n n n n n n n u f g e k e k g (1.10)Cette commande assure que :

2 1 1 ( , , ) 0 n n n i i i L e e k e

(1.11)Selon la méthode directe de Lyapunov, le système (1.2) est globalement asymptotiquement stable par l’application de la loi de commande (1.10) [Slo91].

Remarque 1 : il est à noter, que le choix de la sortie, implique le degré relatif du système et par conséquent le nombre des itérations effectuées. Dans le cas où la sortie yest une variable d'état :

, 1: i

8

Le degré relatif de système r est égale à :

, 1:

r n i i n (1.13)

Ce qui implique le passage par n i itération.

Remarque : l’approche de Lyapunov est présentée à la cinquième section.

4. Commande adaptative

4.1. Définition de la Commande adaptative

La commande adaptative est un ensemble de techniques utilisées pour ajuster en ligne et en temps réel des régulateur afin de réaliser ou maintenir un certain niveau de performance quand les paramètres du procédé à commander sont inconnus et/ou varient dans le temps.

Il existe deux approches principales pour la construction d’un contrôleur adaptatif [Slo91]. :

Contrôleur adaptatif à modèle de référence. Contrôleur adaptatif auto –ajustable.

4.2. Principe de la commande adaptative

La commande adaptative est une technique utilisée pour ajuster automatiquement les régulateurs afin d’assurer les performances voulues quand les paramètres du système à contrôler sont inconnus et/ou variables avec le temps [Ben10]. L’utilisation des schémas adaptatifs est la mesure d’un certain indice de performance qui est comparé à l’indice désire. Selon l’écart obtenu, le mécanisme d’adaptation ajuste les paramètres afin de maintenir l’indice de performance à la valeur désirée.

Contrôleur Procédé

Mécanisme d’adaptation

Sortie Consigne

Chapitre 1 : Notions sur des commandes stabilisantes

9

4.3. Commande adaptative indirecte

Encore appelée commande adaptative auto ajustable avec indentification du modèle, cette stratégie a été proposée par Kalman en 1958 [Slo91].

Le principe de la commande adaptative indirecte repose sur l’identification en ligne du modèle dynamique du système à commander et .puis, avec le modèle estimé, le régulateur permettant de satisfaire les spécifications nominales est calculé.

Un schéma de commande adaptative indirecte passe par deux étapes sont : Estimer les paramètres du modèle du procédé.

Calcul des paramètres du régulateur à partir des paramètres estimés.

4.4. Commande adaptative directe

La commande adaptative directe a été proposée pour la première fois en 1961 se basant sur la minimisation d’un indice performances, approche connue généralement sous la règle de conception du MIT (Massachusetts Institute of Technology) [Afr15]. La structure d’un schéma de commande adaptative directe est représentée par la figure (1.4).

Procédé

Calcul des paramètres du régulateur Estimateur de paramètres en ligne du modèle Contrôleur ajustable Commande d’entrée

10

4.5. Concept de la commande adaptative

Dans la conception de commande classique (non adaptatif), une structure de régulation (par exemple, placement des pôles) est choisie en premier, et les paramètres du régulateur sont alors calculés sur la base des paramètres connus de l'installation. Dans une commande adaptative, la principale différence est que les paramètres de l'installation sont inconnus, de sorte que les paramètres du régulateur sont à fournir par une loi d'adaptation. En conséquence, la conception de la commande adaptative est plus complexe, tenu compte des besoins supplémentaires de choisir une loi d'adaptation et de prouver la stabilité du système avec adaptation [Slo91].

La conception d'un contrôleur adaptatif implique généralement les étapes suivantes : Choisir une loi de commande contenant des paramètres variables.

Choisir une loi d’adaptation pour ajuster les paramètres.

Analyser les propriétés de convergence du système de contrôle résultant.

5. Méthode de Lyapunov

La méthode de Lyapunov [Ioa96] permet d'étudier la stabilité des systèmes complexes qui sont décrits par d’équations différentiels. La stabilité d'un système est la capacité de ce dernier à revenir à sa position d'équilibre lorsqu’il en est ponctuellement écarté. Il existe deux méthodes pour démontrer la stabilité du système, directe et indirecte.

Le concept de la commande adaptative est basé sur la théorie de Lyapunov. Le but est de construire une loi de commande ramenant le système vers des états désirés. En d’autres termes, on souhaite faire de l’état désirée un état d’équilibre stable en boucle fermée.

Commande d’entrée

Figure 1.4 : commande adaptative directe.

y

Contrôleur ajustable Procédé Estimation en ligne des paramètres UChapitre 1 : Notions sur des commandes stabilisantes

11

La théorie de la stabilité de Lyapunov se concentre principalement au moins sur les manuels d’analyse de stabilité importants pour étudier un certain nombre d’attributs des équilibres tel que : la stabilité, stabilité asymptotique stable, instabilité. La théorie de Lyapunov propose un ensemble de théorèmes pour étudier ces attributs de l’équilibre.

5.1. Première méthode de Lyapunov (indirecte) Théorème 1

Si le système linéaire est asymptotiquement stable (ou instable), alors le système est asymptotiquement stable (ou instable).

Si le système linéaire est simplement stable, on ne peut rien quant à la stabilité du système.

5.2. Deuxième méthode de Lyaponov (méthode directe) :

La stabilité au sens de Lyapunov est une traduction mathématique d’une constation élémentaire : si l’énergie totale d’un système (linéaire ou non) tend à se ramener à un état d’équilibre (il est stable). La méthode directe de Lyapunov cherche donc à générer une fonction scalaire de type énergétique qui admet une dérivée temporelle négative.

Théorème 2

Le point d’équilibrexe 0du système autonome x f(x) est stable s’il existe une

fonction V(x) Définie positive et : (0) 0 et (x) 0, x xe V V Si la dérivée temporelle deV(x).

Est définie négative ( (x) 0)V , donc l’équilibre est asymptotiquement stable. Est semi-définie négativeV(x) 0, x xe, donc l’équilibre est simplement stable. Est définie positive ( (x) 0) ,V le système est instable.

12

6. Exemple d’application

Dans cette partie, des simulations numériques sur le modèle dynamique d’un pendule inversé seront effectuées.

L’objectif de cette simulation est de montrer les avantages et les inconvénients des commandes classiques (à paramètres fixes).

Le modèle dynamique d’un pendule inversé est donnée par :

1 2 2 1 ( ) ( ) ( ) ( ) ( ) ( ) ( ) x t x t x t f X g X u y t x t (1.14) Avec :

2 1 2 1 1 2 1sin( ) cos( ) sin( ) / ( )

( ) 4 / 3 cos ( ) / ( ) p p c p p c g x m lx x x m m f X l m x m m (1.15)

1 2

1 cos( ) / ( ) g( ) 4 / 3 cos ( ) / ( ) p c p p c x m m X l m x m m (1.16)Avec les valeurs numériques suivantes : 2 9.80 / g m s La gravité universelle. 1 c m kg La masse du chariote. La masse du pendule. 0.5 l m La largeur du pendule.

Les variables d’état sont l’orientation

x

1

et la vitesse angulairex

2

. La loi de commande utilisée est le Backstepping et l’application est dans deux cas : absence de perturbations et présence de perturbation (d 0.1sin( )t ) à partir de t=5 sec0.1 p m kg c m p m

l

Chapitre 1 : Notions sur des commandes stabilisantes

13

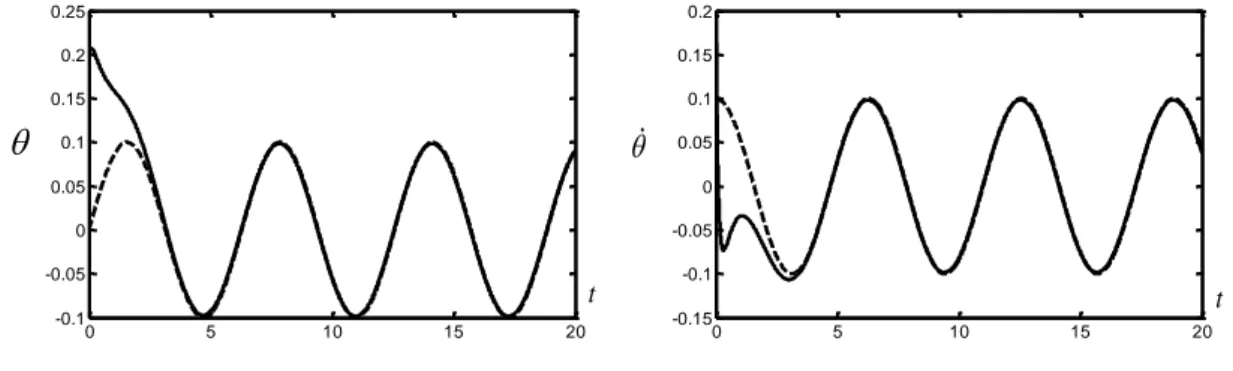

Les résultats de simulation sans perturbation sont présentés par les figures (1.6) (1.7) et (1.8).

Figure 1.6 : Les sorties de systèmes ( Trajectoire désirée, trajectoire réelle).

Figure 1.7 : Les erreurs de poursuite.

Figure 1.8 : signal de commande.

0 5 10 15 20 -0.1 -0.05 0 0.05 0.1 0.15 0.2 0.25 0 5 10 15 20 -0.15 -0.1 -0.05 0 0.05 0.1 0.15 0.2 0 5 10 15 20 -0.3 -0.2 -0.1 0 0.1 0 5 10 15 20 -0.1 0 0.1 0.2 0.3 0 5 10 15 20 -5 0 5 10 t t t t t e e u

14

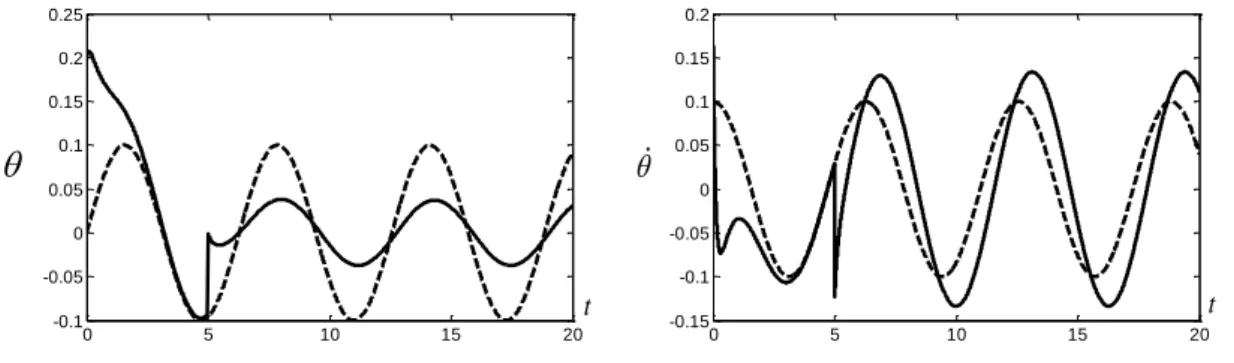

Les résultats de simulation avec perturbation sont présentés par les Figure (1.9) (1.10) et (1.11).

Figure 1.9 : Les sorties de systèmes ( Trajectoire désirée, trajectoire réelle).

Figure 1.10 : Les erreurs de poursuite.

Figure 1.11 : signal de commande.

Selon les résultats de simulation, la commande par backstepping est efficace dans le cas où le modèle est supposé connu avec précision. Cependant les figures (1.10) (1.11) (1.12) présente les limitations de cette technique à la présence des perturbations où il y a une dégradation de poursuite à partir de t=5 sec.

0 5 10 15 20 -0.1 -0.05 0 0.05 0.1 0.15 0.2 0.25 0 5 10 15 20 -0.15 -0.1 -0.05 0 0.05 0.1 0.15 0.2 0 5 10 15 20 -0.25 -0.2 -0.15 -0.1 -0.05 0 0.05 0.1 0 5 10 15 20 -100 -80 -60 -40 -20 0 20 0 5 10 15 20 -100 -80 -60 -40 -20 0 20 t t t t t e e u 4.96 4.98 5 5.02 5.04 -80 -70 -60 -50 -40 -30 -20 -10 0

Chapitre 1 : Notions sur des commandes stabilisantes

15

7. Conclusion

Dans ce chapitre, nous avons attaché une importance à la commande stabilisante les systèmes non linéaire, Dans un premier temps, un rappel sur deux technique de commande classique, l’approche backstepping et la commande par mode glissent, Ensuite, nous nous sommes tournés vers la commande adaptative avec ses schémas direct et indirect. La méthode de Lyapunov pour étudier la stabilité des systèmes non linéaires a été mentionnée. À la fin des simulations ont été effectuées sur un pendule inversé avec un schéma de commande de type backstepping pour voir les limitations de cette commande à la présence des perturbations et/ou l’incertitude du modèle dynamique.

Chapitre 2 : Réseaux de Neurones Artificiels RNA

16

Réseaux de Neurones Artificiels RNA

1. Introduction

Partant d’un souhait initial de mieux comprendre la performance du cerveau humain, les réseaux de neurones artificiels sont une classe de modèles qui ont eu un impact significatif dans le domaine de l'analyse et du traitement des données. Cependant, l'inspiration pour les réseaux neuronaux vient de la volonté de créer des systèmes artificiels sophistiqués, une vision intelligente, capables d'effectuer des opérations similaires à celles effectuées régulièrement par le cerveau humain.

Les réseaux de neurones comprennent actuellement différents domaines tels que la médecine, l'électronique, l'informatique, l'automatisation, la robotique, la classification, le contrôle, le traitement du signal, le traitement d'image, etc.

Dans ce chapitre, nous faisons une présentation générale sur l'approximateur universel choisi dans ce travail, le réseau de neurone artificiel, nous présentons leur origine biologique et comment les chercheures ont inspiré le modèle du neurone formel à partir de celui du neurone biologique. ensuite, le développement des réseaux de neurones à partir de le premier neurone formel jusqu'à le perceptron multicouche et les réseaux de neurones à fonction de base radiale qui sont les plus utilisée et l'algorithme d'apprentissage (rétro-propagation), enfin, le théorème d'approximation universel.

2. Réseaux de neurones

Au fil des années et à l'ère de la robotique, les chercheurs ont toujours cherché à inverser certains aspects de l'intelligence humaine sur les machines. Pour cela, un modèle mathématique du cerveau humain a été conçu ce qui a donné la naissance de réseaux neuronal artificiel originellement dérivé du modèle biologique. De leurs caractéristiques :

La capacité d'apprendre.

La possibilité de sauvegarder des informations. La capacité à traiter des informations incomplètes.

17

2.1. Neurone biologique

Le cerveau humain est composé d’un réseau de neurones très compliqué, dont, il contient plus que 10

10 [zil01] cellules nerveuse connectées entre eux. Le neurone est une cellule composée d’un corps cellulaire et d’un noyau (Figure 2.1). Le corps cellulaire se ramifie pour former ce que l’on nomme les dendrites. Celles-ci sont parfois si nombreuses que l’on parle alors de chevelure dendritique ou d’arborisation dendritique [Zam03].

Figure.2.1 : Schéma d’un neurone biologique.

2.1.1 Structure de neurone

La structure d’un neurone peut être décomposée en quatre parties distinctes [Gos96] :

Les dendrites : forment un maillage de récepteurs nerveux qui permettent d’acheminer vers le corps du neurone des signaux électriques en provenance d’autres neurones. Le corps cellulaire : c’est le noyau du neurone, il fait la sommation des signaux qu’il

reçoit puis faire passer la somme a un seuillage.

L’axone : c’est le moyen de transport des signaux émis par le corps cellulaire vers un autre neurone.

Synapse : La transmission entre deux neurones n’est pas directe. En fait, il existe un espace intercellulaire de quelques dizaines d’Angströms (10-9 m) entre l’axone du neurone afférent et les dendrites (on dit une dendrite) du neurone efférent. La jonction entre deux neurones est appelée la synapse [cla92].

Basé sur les concepts : dendrites, corps cellulaire, axone, synapse, et le principe de transmission des signaux, les chercheurs ont imaginé un modèle similaire de neurones qui sont des neurones formels

Chapitre 2 : Réseaux de Neurones Artificiels RNA

18

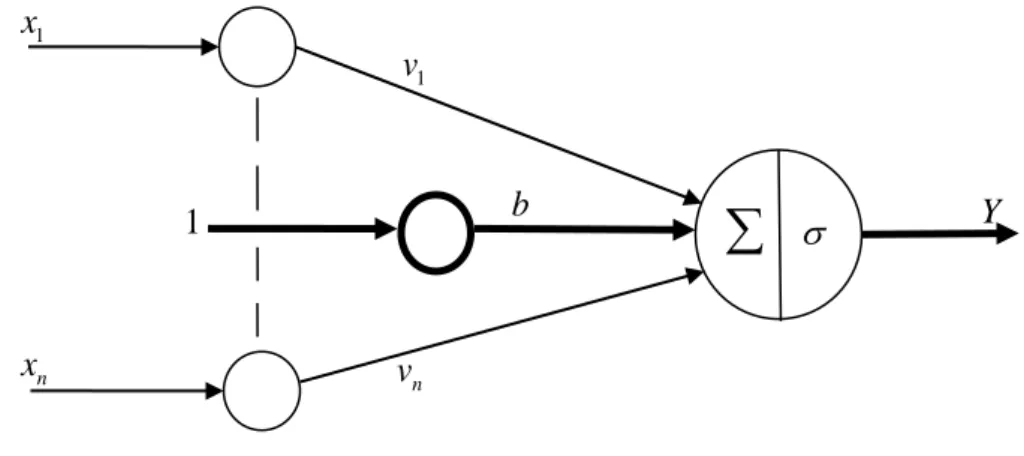

2.2. Neurone formel

C’est un processeur très simple imitant grossièrement la structure et le fonctionnement d’un neurone biologique, la première version du neural formel est celle de Mc.culloche et Pitts qui est largement utilisée [Gér98]. Ce dernier, est un processus élémentaire (automate) àn entrées et une seule sortie. Chaque entrée est associée à un poids synaptiques V qui représente la force de la connexion, Voir figure (4.1).

Le neurone formel est composé de trois parties comme suit : 2.2.1 Poids

Les coefficients v sont les poids associés à chaque entréei x . Dont, chaque entrée est i multiplié par le poids qui lui correspond est le résultat sera (VT X avec : ) V

v1 vn

T et

1

T n

X x x . 2.2.2 Seuil

Le biais b présente le seuil de neurone formel, ce paramètre additionnel est considéré comme le poids de l’entrée unité.

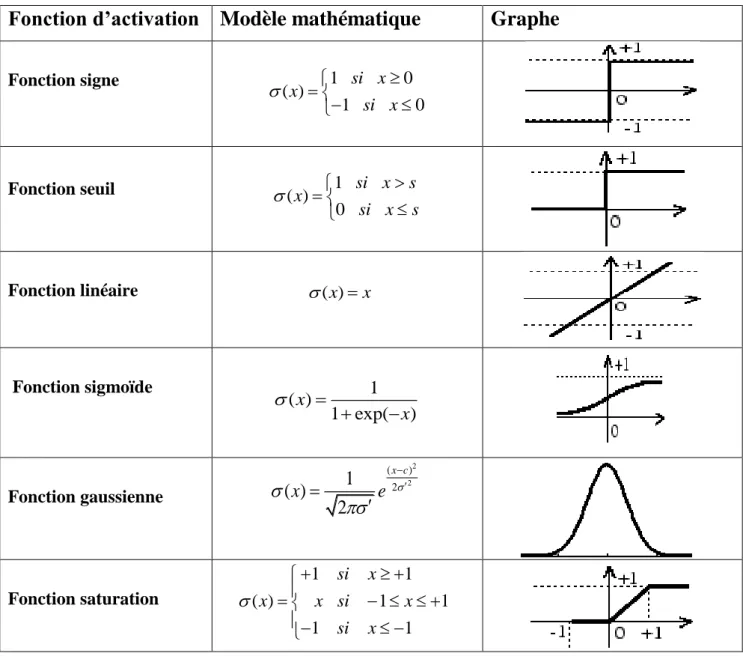

2.2.3 Fonction d’activation

La fonction d’activation calcul l’état du neurone, cette valeur sera transmise aux neurones avals. Il existe de nombreuses formes possible de la fonction d’activation, les plus courantes sont présentées dans le tableau (2.1) [Zil01, Spo02, Sar06].

1 v n v 1 x n x

b 1 Y19

Comme conclusion, le résultat de cet automate s’exprime par un simple produit scalaire entre le vecteur d’entrées (X) et le vecteur des poids (V), ensuit le seuillage par un biais b et la fonction d’activation sont appliqués au résultat obtenu et la sortie finale du neurone sera :

Y (V XT b) (2.1)

Tableau 2.1. Fonctions d’activation.

Fonction d’activation Modèle mathématique

Graphe

Fonction signe 1 0 ( ) 1 0 si x x si x Fonction seuil ( ) 1 0 si x s x si x s Fonction linéaire ( )x x Fonction sigmoïde 1 ( ) 1 exp( ) x x Fonction gaussienne 2 2 ( ) 2 1 ( ) 2 x c x e

Fonction saturation 1 1 ( ) 1 1 1 1 si x x x si x si x On remarquera que le neurone biologique a une sortie de nature binaire, donc le neurone peut prendre seulement deux état (active ou désactive).

La plupart des fonctions d'activation continues, offrant une infinité de valeurs possibles comprissent dans l'intervalle [0, +1] (ou [-1, +1]).

Chapitre 2 : Réseaux de Neurones Artificiels RNA

20

Enfin, nous pouvons dire qu'un ensemble de neurones formels liés les uns aux autres est un réseau de neurones artificiels.

3. Réseau de neurones artificiels

3.1. Définition

Les réseaux de neurones artificiels sont des réseaux fortement connectés de processeurs élémentaires fonctionnant en parallèle. Chaque processeur élémentaire calcule une sortie unique sur la base des informations qu'il reçoit. Toute structure hiérarchique de réseaux est évidemment un réseau [Tou92]. Beaucoup de topologie sont été développées, parmi eux : multicouche, à connexion locale, à connexion récurrentes, connexion complète..., etc.

3.2. Fonctionnement de RNAs

Le fonctionnement d’un RNA est défini par la forme de connexion entre ses éléments. Par l'ajustement des pondérations, le réseau neuronal artificiel peut effectuer plusieurs tâches, de la même manière que le cerveau humain tel que : la reconnaissance de forme, la modélisation et la commande des processus,…etc. Autrement dit, la reconnaissance des tâches est enregistré par le changement dans les pondérations, cette phase est appelée apprentissage [bou15]. 3.3. Historique de RNAs

Le développement des RNAs se résume comme suit :

- En 1949 décrits dans son ouvrage "The Organization of Behaviour". Hebb a proposé une règle simple qui permet de modifier la valeur des coefficients synaptiques en fonction de règle de Hebb» est presque partout présent dans les modèles actuels, même les plus sophistiqués [Idi09]. -En 1958, F. Rosenblatt propose le premier réseau de neurone artificiel pratique pour la reconnaissance des formes, c’est le Perceptron. Ce modèle est composé de deux couches, la couche d’entrée et la couche de sortie [Bou15] comme il est présenté par la figure (2.3). Avec : est la fonction seuil (modèle de F. Rosenblatt), X

x1 xne

T neest le vecteur d’entrée,

1 y2

T ns

Y y est la matrice des poids et ne etn sont le nombre des s neurones dans la couche d’entrée et de sortie respectivement.

21

La loi d’apprentissage de perceptron est inspirée de la règle de D. O. Hebb :’ En cas d’erreur en sortie le vecteur d’entrée correspondant est ajouté ou retranché au vecteur des poids synaptiques’.

- De leur côté, en 1960 Widrow est proposé l'Adaline (Adaptative LinearElement) : le premier réseau de neurones destiné à résoudre un problème du monde réel, la suppression d'échos sur une ligne téléphonique [Voy11].

- 1969 : Après des débuts prometteurs, les réseaux de neurones subissent la concurrence des techniques de calculs plus classiques et tombent en désuétude suite notamment aux critiques de Minsky et Paper. Ceux-ci mettent en évidence l'incapacité des réseaux à une couche à calculer l’opérateur logique ‘XOR’ et les difficultés théoriques posées par l'apprentissage dans les réseaux multicouches [Voy11].

3.4. Perceptron multicouche

En 1986 grâce au travail de D. Rumelhart, Une révolution survient dans le domaine des réseaux de neurones artificiels: une nouvelle génération de réseaux de neurones, le perceptron multicouche. Ce dernier est composé d’une couche d’entrée, une couche de sortie et une/où plusieurs couches cachées, comme il est illustré sur la figure (2.4). Ce réseaux est capable de traite tous les problèmes linéairement séparable ou non. Et il est considéré comme le réseau de contrôle le plus applicable.

V 1

x

3x

2x

nex

1y

2y

nsy

1 b 2b

nsb

Chapitre 2 : Réseaux de Neurones Artificiels RNA

22

Le perceptron multicouche est un réseau orienté de neurones artificiels organisé en couches et ou l’information voyage dans un seul sens, de la couche d’entrée vers la couche de sortie. [Par04].Son apprentissage est de type supervisé, par correction des erreurs. Dans ce cas uniquement, le signale d’erreur est « rétro propagé » [Rum86].La fonction d’activation est située dans les couches cachées.

3.4.1. Algorithme de rétro-propagation

L’algorithme de rétro-propagation est basé sur la méthode de gradient descendant [Rum86, zil01], dont, l’apprentissage est supervisé. L’ajustement des poids se fait dans le sens inverse de la couche de sortie vers la couche d’entrée d’où l’appellation rétro-propagation (back propagation). Au début, la sortie du réseau est calculée et comparée avec la sortie désirée, ensuite l’erreur résultante est utilisée pour l’apprentissage des poids du la couche de sortie et du la dernière couche cachée. De la même manière, l’erreur du réseau se propage pour l’ajustement des poids des autres couches cachées jusqu’à la couche d’entrée.

L’opération d’apprentissage supervisé d’un réseau de neurones artificiels est résumée par la figure (2.5). W

V

1x

2x

nex

1y

2 y ne y Couches cachées Propagation de la sortieFigure 2.4 : perceptron multicouche.

23

3.4.1. a. Algorithme de gradient

L'algorithme de gradient est basé sur la minimisation de la fonction de coût, pour l'apprentissage sous la supervision de réseaux neuronaux artificiels Cette fonction est donnée par: 2 2 1 1 ( ) 2 2 i i di i j E y y (2.1)

Avec :E : est l’erreur du neurone de sortiei i, y : est la sortie désirée de neurone de sortie di i

et y : est la sortie réelle de neurone de sortiei i.

L’algorithme du gradient pour l’ajustement des poids et de biais est donnée par :

( ) ( ) ( ) ( 1) ( ) ( ) i ij ij ij i i i i J w t w t w t J b t b t b t (2.2)

La constante 0 1représente le gain d’apprentissage.

3.4.1.b. Étapes de rétro-propagation

La sortie d’un neurone artificiel multicouche se calcul de la couche d’entrée vers la couche de sortie. Par contre, la minimisation de l’erreur entre la sortie réelle et la sortie désirée du RNA par la méthode de gradient est obtenue par la propagation du signale d’erreur dans le sens inverse c’est-à-dire de la couche de sortie vers la couche d’entrée. Alors, l’ajustement des poids se fait dans le même sens qui le signale d’erreur et l’algorithme de gradient qui réalise cette tâche est appelé la rétro-propagation [Bou15].

1 x 1 n x i b inW

i Y Ydi 1 i W Règle d’apprentissageFigure 2.5 : Mécanisme d’apprentissage. supervisé

Chapitre 2 : Réseaux de Neurones Artificiels RNA

24

Les différentes étapes à suivre lors de l’apprentissage d’un réseau de neurones à propagation avant avec cet algorithme sont comme suit :

Étape 1 : Initialiser les poids Wi111j et les seuils internes des neurones à des petites valeurs aléatoires.

Étape 2 : Présenter le vecteur d'entrée et de sortie désirée pour l’apprentissage. Étape 3 : calculer le signale de sortie du RNA comme suit :

- La sortie de chaque neurone j de la couche cachée k est donnée par :

1 1 1 1 1: , , 1: k nc k k k j ij i i k k p o w o j nc

(2.3)Avec :est la fonction d’activation,

w

ijk1sont les poids liant la couche k1et la couchek , 1k

nc est le nombre de neurones dans la couche cachéek1, pest le nombre de couches cachées, pour la première couche cachée

k 1

, on note nc par ne c’est-à-dire le nombre de 0 neurones dans la couche d’entrée et 0i i

o x désigne l’entrée du RNA. - La sortie de chaque neurone de sortiel , est donnée par :

1 1: , 1: p nc p p l ij i i l ns y w o j l

(2.4)Avec ns est le nombre de neurones dans la couche de sortie. Étape 4 : Calculer :

- les erreurs de chaque neurone de la couche de sortie l par l’expression suivant : k

1 1: o , 1: p nc p p l dl ij i i l ns e y w j l

(2.5)Avec y est la sortie désirée de neurone de sortie l . dl

- les erreurs de chaque neurone caché j dans la couche caché k par l’expression suivant :

1 1 1 1 :1, , 1: k nc k k k j ij i i k k p e w e j nc

(2.6)25

Avec p 1

i

e est l’erreur e définie dans (2.6). i

Étape 5 : En utilisant l'algorithme de gradient, les poids est ajusté de la couche de sortie à la couche d'entrée comme suit:

1

1 1 1 1 1 1 1 1:1, 1 , 1: 1: k nc k k k k k k ij ij j ij i i k i k k p w t w t e w t o o i nc j nc

(2.7) Avec : ( )x d

x dx Étape 6 : refaire les étapes de 2 à 5 jusqu’à l’obtention d’une fonction cout proche de zéro (inférieur à la valeur désirée).

3.5. Réseaux de neurones à fonction de base radiale (RBF)

L’idée générale des réseaux RBF dérive de la théorie d’approximation des fonctions, ces réseaux sont une architecture Feedforward puissante. La raison de son application vient du fait que le réseau utilise des fonctions gaussiennes standard qui sont à symétrie radiale. Son apprentissage est basé sur l’algorithme K-means et l’algorithme des moindres carrées [Par04].

Les réseaux de neurones RBFs, sont principalement utilisés pour résoudre des problèmes d’approximation de fonctions dans des espaces de grandes dimensions. Ils sont lus adaptés, en raison d’apprentissage local. Ce type d’apprentissage peut rendre le processus d’entrainement bien plus rapide que dans le cas d’un perceptron multi-couche, qui apprend de façon globale. En effet, ces réseaux avec une seule couche cachée peuvent approximer n'importe quelle fonction continue ayant un nombre fini de discontinuités sur tout compact [Sti89], [Par91].

Figure 2.6 : réseaux à fonction de base radiale.

Sortie

Chapitre 2 : Réseaux de Neurones Artificiels RNA

26

4. Théorème d’approximation universelle

Parmi les caractéristiques des réseaux de neurones, l'approximation universelle est la plus importante du point de vue de l'identification et la commande. L’approximation universelle a fait le sujet de beaucoup de travaux de recherche et plusieurs démonstrations pour des réseaux de neurones avec différentes fonction d’activation [Deb11]. On dispose d’un nombre important de publications montrant que les réseaux de neurones (RA) sont bien des approximateurs universels, c’est-à-dire, pour toute fonction continue f x( )défini sur un ensemble compact , et pour toute constante positive , il existe un RN d’ordre supérieur, avec k neurones dans la couche cachée, telle que :

ˆ

( ) ( )

x

sup f x f x (2.8)

Avec f xˆ( )est l’approximation neuronale de f x( )et est une constante positive définie l’erreur d’approximation neuronale [Deb11].

5. Avantages et inconvénients des réseaux de neurones

5.1. Avantages

Les principales qualités des réseaux de neurones sont leur capacité d'adaptabilité et d'auto-organisation et la possibilité de résoudre des problèmes non-linéaires avec une bonne approximation [Wat87],[Meh92]. Ils ont une bonne immunité aux bruits et se prêtent bien à une implantation parallèle. La rapidité d'exécution est une qualité importante et elle justifie souvent à elle seule le choix d'implanter un réseau de neurones. Ces qualités ont permis de réaliser avec succès, plusieurs applications : classification, filtrage, compression de données, contrôleur, etc.…

5.2. Inconvénients

La difficulté d'interpréter le comportement d'un réseau de neurones est un inconvénient pour la mise au point d'une application. Il est souvent impossible d'utiliser les résultats obtenus pour améliorer ce comportement. Il est également hasardeux de généraliser à partir d'expériences antérieures et de conclure ou de créer des règles sur le fonctionnement et le comportement des réseaux de neurones.

Plusieurs paramètres doivent être ajustés et aucune méthode ne permet de choisir des valeurs optimales. Beaucoup d’heuristiques sont utilisées, mais elles se contredisent parfois et elles ne permettent pas toujours de trouver des valeurs optimales.

27

6. Conclusion

Danse ce chapitre, les principaux concepts de réseau de neurone inspiré par l'étude du cerveau humain ont été présentés, Où des modèles plus complexes ont été développés à travers le développement de la neurobiologie et l'utilisation d'outils théoriques plus puissants. Tels que l'algorithme de rétro-propagation. De plus, le modèle multicouche est le modèle de réseaux de neurones le plus utilisé. Dans le prochain chapitre on va voir (L’implémentation des RNAs dans les schémas de commandes adaptatives.

28

Commande adaptative Neuronale d’un système non linéaire mono

variable

1. Introduction

Les techniques de commande traditionnelles ont souvent montrées leurs faiblesse et leurs inefficacité dans la théorie du contrôle des systèmes dynamiques non linéaires, en particulier lorsque les systèmes à étudier sont fortement non linéarités et avec des incertitudes. La recherche avancée a conduit au développement de nouvelles techniques de commande non-linéaires telles que la commande adaptative. Cette dernière est basée sur le principe d’estimer les paramètres et/ou fonctions inconnus dans le modèle dynamique du système à commander par un mécanisme d’adaptation approprié.

Les Réseaux de Neurones Artificiels (RNA) sont des approximateurs universels non linéaires généralement utilisés dans les schémas de commande adaptative pour estimer les incertitudes qui existent.

Dans ce chapitre, on s’intéresse à la commande adaptative directe d’une classe des systèmes mono-variables, non linéaires et incertains. Dans la première section, le problème de la commande est posé. La procédure de synthèse d’une commande adaptative neuronale est présentée dans la deuxième section, dont, un RNA multicouche est implémenté pour approximer la commande équivalente. L’étude de stabilité du système global a été vérifiée par l’approche de Lyapunov dans la troisième section. Des simulations avec un test de robustesse ont été effectuées à la fin de ce chapitre sur le modèle dynamique d’un pendule inversé pour montrer l’efficacité du schéma de commande adaptative en la présence des perturbations.

2. Position de problème

Le système étudié est non-linéaire de type SISO (Single Input Single Output), affine à la commande, d’ordre n décrit par l’équation différentielle suivante :

( )

( )

( )

n

y

f X

g X u

(3.1) La représentation d’état est donnée par :Chapitre 3 : Commande adaptative Neuronale d’un système non linéaire mono variable 29 1 1 , 1: 1 ( ) ( ) , . i i n x x i n x f X g X u y x (3.2)

Avec : uest l’entrée du système, yest la sortie du son système,

( 1)1 2

T

T n n

n

X x x x y y y est le vecteur d’état, f X( ), ( )g X sont des fonctions non linéaires, lisses et inconnues.

Le développement de notre loi de commande exige la prise en considération des hypothèses suivantes :

Hypothèses 3.1 : le vecteur d’état X est mesurable.

Hypothèses 3.2 : la trajectoire désirée

y

d et ses dérivées sont connues, bornées etcontinues.

Hypothèses 3.3 : le gain de la commande g(X) est positif( ( )g x 0, x n).

L’objectif principal est de générer une loi de commande u forçant la sortie du système

y à suivre la trajectoire désiréey tout en assurant la bornitude de tous les signaux du système d en BF.

L’erreur de poursuite est définie par :

e yd y (3.3)

Et l’erreur filtrée s est définie comme suit :

( 1) , >0 n d s e dt (3.4)

À partir de (3.4), on déduit la convergence de l’erreur de poursuite e et ses dérivées e(i) vers zéro si l’erreur filtrée converge vers zéro [Slo91].

Alors, notre objectif est de synthétiser d’une loi de commande qui force l’erreur filtrée à converger vers zéro.

La dynamique de l’erreur filtrée est donnée par :

s v f(x) g(x) u (3.5) Avec : 1 ( ) ( ) 1 ( 1)! ( )!( 1)! n n j d j j n j j v y e n n j j

(3.6)30

La loi de commande qui garantit la convergence de l’erreur filtrée vers zéros est formulée comme suit :

u* u*equpd , (3.7) Avec : *

u est la loi de commande idéale, elle est composé de deux terme, le premier termeu*eq

présente la commande équivalente idéale utilisée pour compenser les non linéarités, elle est définie comme suit :

* 1

( )( ( ))

eq

u g X vf X (3.8)

Et le deuxième terme est la commande PD idéale utilisée pour la stabilisation du système, son expression est donnée par :

u

pd

k s

,

k

0

(3.9) Si on remplace (3.7) dans (3.5), on obtient :s = -g(X)k s (3.10) De (3.10), on peut conclure que s0lorsque t , et donc la convergence de l’erreur de poursuite e et ses dérivée vers zéro.

Selon l’analyse ci-dessus, l’implémentation de la loi de commande idéale (3.7) est possible si les fonctions f X( )et g(X) est connues avec exactitude et le gain de commande g(X) doit être inversible. Cependant, cette condition est généralement non vérifiée en pratique. Pour pallier à ce problème, une loi de commande adaptative basé sur l’utilisation du l’approximateur universel RNA est synthétiser pour estimer les termes inconnus.

3. Synthèse de la loi de commande adaptative par RNA

Tant que l'application de la loi de commande (3.7) est impossible, elle est remplacée par une loi approximative donnée par :

eq pd r

u u

u

u

(3.11)Contrairement à loi de commande précédente (3.7), la loi (3.11) est composée de trois termes suivants :

-

u

eq : est la commande équivalente estimée par un réseau de neurone artificiel multicouche (les détails seront présentés plus tard).Chapitre 3 : Commande adaptative Neuronale d’un système non linéaire mono variable

31

pd

u ks (3.12)

Elle est utilisée pour garantir la stabilité du système bouclé.

-

u

r : un terme robuste de type mode glissent [Khe96, Slo91], sont expression est donnée par :ˆ ( ) r

u sign s (3.13)

Avec : ˆ est un paramètre variable dans le temps et sa loi d’adaptation est donnée par : ˆ s, > 0

(3.14)

Le terme robuste est implémenté pour compenser les erreurs d’approximation. 3.1. Commande adaptative par Réseau de Neurone Artificiel

Selon le théorème d’approximation universel par RNA, la commande équivalente idéale (3.8) peut être approximé par un RNA à une seule couche cachée (Figure (3.1)).

L’approximation idéale de la commande équivalente par le RNA présenté dans la figure (3.1) est reformulée de la manière suivante :

*

( )

T T

eq

u W

V

(3.15)Avec : neest le vecteur d’entrée de RNA, et : est la fonction d’activation. nc ns

W : Sont les poids idéaux des couche cachée /sortie et ne nc

V : sont les poids idéaux des couches entrée/cachée,

: est l’erreur d’approximation idéal,n

e : est le nombre des neuronesd’entrée,

n

c : Le nombre des neurones dans la couche cachée,n

s : Le nombre des neurones de sortie.0 1 2 n