Cours de Statistiques niveau L1-L2

Texte intégral

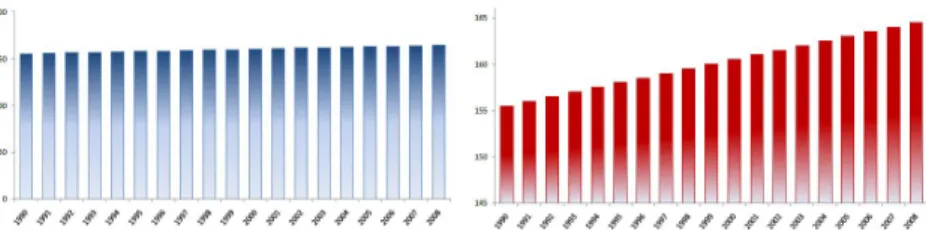

Figure

Documents relatifs

Pour créer une topologie cartésienne contenant un ensemble de processus qui appartienne à un communicateur donné (comm_ancien), on utilise la fonction :

Savoir calculer la probabilité d'une variable aléatoire qui suit la loi normale de paramètre 3 et réduite d'être dans un intervalle donné.. C16.c 2 Savoir calculer

Savoir calculer la probabilité d'une variable aléatoire qui suit la loi normale de paramètre 4 et réduite d'être dans un intervalle donné.. C16.c 2 Savoir calculer

C16.b 1 Savoir calculer la probabilité d'une variable aléatoire qui suit la loi normale de paramètre µ et réduite d'être dans un intervalle donné..

On obtient ainsi un intervalle de conance pour m avec une marge d'erreur de α qui correspond à la probabilité que la vraie valeur du paramètre ne soit pas dans l'intervalle3.

- Une variable discrète ne peut prendre qu’un nombre fini de valeurs dans un intervalle donné. Exemple: le nombre de personnes composant un ménage. - Une variable continue

Un intervalle statistique de dispersion est un intervalle, calculé à par- tir d’un échantillon d’effectif n, tel qu’on puisse affirmer, avec un niveau.. de

On appelle médiane d’une série statistique ordonnée une valeur du caractère qui partage la série en deux groupes de même effectif tels que :.. • un groupe contient les