© François-Olivier Salvaille-Millette, 2019

L'utilisation d'outils de composition assistée par

ordinateur dans cinq de mes oeuvres

Mémoire

François-Olivier Salvaille-Millette

Maîtrise en musique - composition - avec mémoire

Maître en musique (M. Mus.)

iii

Résumé

Mon mémoire traite de l’utilisation des outils de composition assistée par ordinateur (CAO) dans cinq de mes œuvres : (1) De deux choses Lune, pour flûte, clarinette, violon, violoncelle et électronique; (2) L’ombre véritable, pour harpe, voix, voix enregistrée et électronique; (3) Par ailleurs, musique acousmatique; (4) Musique du rocher, musique acousmatique; (5) Or Chess, orchestre symphonique.

Après avoir présenté mes préoccupations artistiques, j’établis le contexte historique dans lequel s’inscrit mon travail. Je présente ensuite mes recherches ayant conduit à la composition des œuvres à l’étude. Finalement, j’explique, par l’analyse ciblée de chacune des pièces, en quoi les outils de CAO se sont avérés déterminants dans la composition de mes œuvres. J’y aborde, notamment, la programmation textuelle (De deux choses Lune,

Par ailleurs), la programmation visuelle (Musique du rocher, Or Chess), ainsi que la

iv

Table des matières

TABLE DES MATIÈRES ... IV LISTE DES EXEMPLES ... VI LISTE DES TABLEAUX ... VII REMERCIEMENTS ... VIII

INTRODUCTION ... 1

DÉFINITIONS ... 1

Composition assistée par ordinateur (CAO) ... 1

Manipulation audio... 1

Musique acousmatique ... 1

Travail « hors-temps » et « en-temps » ... 2

A) PRÉOCCUPATIONS ARTISTIQUES ... 2

B) INFLUENCES MUSICALES ... 3

C) OBJECTIFS DE CRÉATION ... 4

CHAPITRE 1 ... 5

1.1 PROGRAMMATION TEXTUELLE ET VISUELLE ... 5

1.1.1 La programmation informatique textuelle : le cas de MUSIC N ... 5

1.1.2 La programmation informatique visuelle : les logiciels MAX et OpenMusic ... 7

1.2 STATIONS AUDIONUMÉRIQUES ... 10

1.3 LOGICIELS D’ANALYSE SPECTRALE, D’ÉDITION ET DE RESYNTHÈSE ... 11

1.4 INTÉGRATION DES OUTILS DE CAO DANS MON TRAVAIL CRÉATIF ... 12

CHAPITRE 2 ... 13

2.1 COMPOSITION ASSISTEE PAR ORDINATEUR : RECHERCHES PRELIMINAIRES ... 13

2.2 SÉLECTION DES LOGICIELS DE CAO ... 13

2.2.1 Pure Data ... 13

2.2.2 Common Music ... 14

2.2.3 Csound ... 14

v

2.2.5 Stations audionumériques ... 15

2.2.6 SPEAR ... 16

2.3 PRÉSENTATION SOMMAIRE DES ŒUVRES À L’ÉTUDE ... 16

2.3.1 Œuvres composées lors de la phase exploratoire ... 17

2.3.2 Œuvres utilisant la CAO de façon plus avancée ... 18

2.4 ANALYSE DE L’UTILISATION DES OUTILS DE CAO DANS CHAQUE ŒUVRE ... 19

2.4.1 De deux choses Lune ... 19

2.4.2 L’ombre véritable ... 25 2.4.3 Par ailleurs ... 30 2.4.4 Musique du rocher ... 36 2.4.5 Or Chess ... 46 3. CONCLUSION ... 56 BIBLIOGRAPHIE... 59 ANNEXES ... 61

ANNEXE A : PARTITION DE DE DEUX CHOSES LUNE ... 62

ANNEXE B : ENVIRONNEMENT ACOUSMATIQUE DE DE DEUX CHOSES LUNE ... 63

ANNEXE C : PARTITION DE L’OMBRE VÉRITABLE ... 64

ANNEXE D : ENVIRONNEMENT ACOUSMATIQUE DE L’OMBRE VÉRITABLE ... 65

ANNEXE E : POÈME L’OMBRE VÉRITABLE ... 66

ANNEXE F : PAR AILLEURS (MUSIQUE ACOUSMATIQUE) ... 67

ANNEXE G : MUSIQUE DU ROCHER (MUSIQUE ACOUSMATIQUE) ... 68

ANNEXE H : PATCH DE MUSIQUE DU ROCHER ... 69

vi

Liste des exemples

Exemple 1 Programmation textuelle moderne dans Csound ... 6

Exemple 2 Patch dans l’environnement graphique dans Pure Data, exemple de patch ... 8

Exemple 3 Environnement graphique dans The Patcher ... 9

Exemple 4 Interface graphique de la station audionumérique Reaper ... 11

Exemple 5 Musique de notes (De deux choses Lune, mes.10-11) ... 20

Exemple 6 Musique de timbres (De deux choses Lune, mes.12-15) ... 20

Exemple 7 Fenêtre d’édition dans le logiciel Grace ... 22

Exemple 8 Fenêtre console dans le logiciel Grace ... 22

Exemple 9 Définition de variables dans le langage SAL ... 23

Exemple 10 Code d'utilisation des variables ... 24

Exemple 11 Résultat du code de l'exemple 9 ... 24

Exemple 12 Réalisation mélodico-rythmique de l'exemple 9 (De deux choses Lune, mes.2) ... 25

Exemple 13 Dixième strophe de L'ombre véritable ... 27

Exemple 14 Structure de l’interface dans Csound (Par ailleurs, section D) ... 32

Exemple 15 Schéma de synthèse additive (Bresson, 2007, p. 27) ... 33

Exemple 16 Réalisation d'un instrument de synthèse additive dans Csound ... 34

Exemple 17 Partition de l'exemple 16 ... 34

Exemple 18 Boites et éléments graphiques interactifs dans Musique du rocher ... 40

Exemple 19 Patch secondaire initiant la lecture d'un drone ... 41

Exemple 20 Lecture « aléatoire » d’un fichier sonore (Musique du rocher) ... 42

Exemple 21 Dispositif permettant de visualiser l’emplacement de la tête de lecture ... 44

Exemple 22 Patch secondaire utilisé pour contrôler l’amplitude des fichiers du thème de La famille Plouffe et du cœur (Musique du rocher) ... 45

Exemple 23 Échiquier/Grille de divisions fréquentielles et temporelles des fichiers sonores ... 49

Exemple 24 Génération de contenu harmonique ... 52

vii

Liste des tableaux

Tableau 1 Logiciels de CAO sélectionnés pour mon travail de composition ... 13

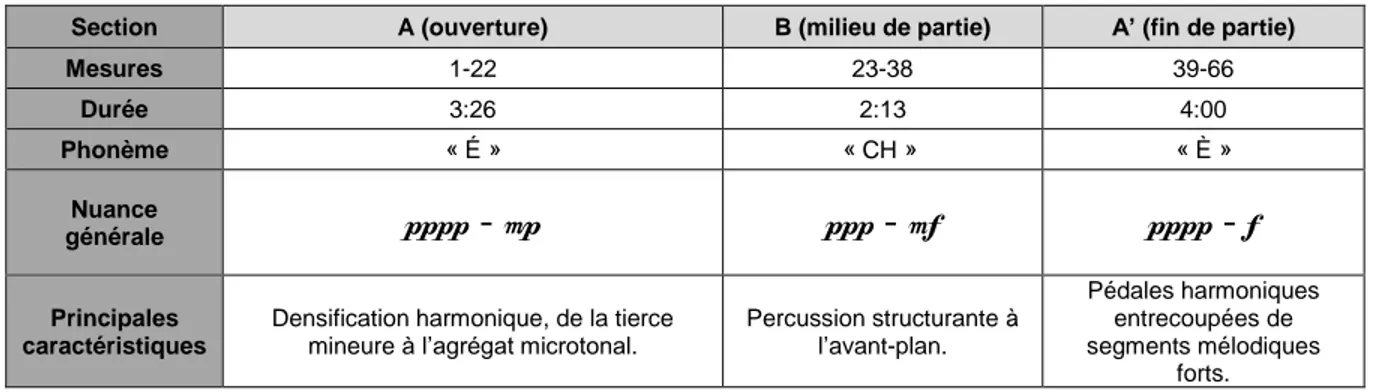

Tableau 2 Forme et élément caractéristiques de De deux choses Lune ... 21

Tableau 3 Forme et caractéristiques des discours de Par ailleurs ... 31

viii

Remerciements

Je tiens à remercier tout spécialement mon directeur de recherche, M. Aaron Liu-Rosenbaum, ainsi que mon co-directeur, M. Éric Morin, pour leur soutien et leur aide tout au long de mes études de maîtrise. Je remercie également Mme Yvonne Liu pour sa participation à l’enregistrement d’extraits de harpe utilisés comme matériau de composition dans ma pièce L’ombre véritable. Je remercie aussi mes parents, Marie-Claude Salvaille et Marc Millette, pour leur soutien indéfectible tout au long de mon cheminement universitaire.

Un merci tout spécial à l’ensemble Lunatik et au producteur de spectacle E27, ainsi qu’à leur directeur de l’époque, M. Patrick Giguère, qui ont commandé et créé deux œuvres incluses dans ce mémoire, soit De deux choses Lune et Par ailleurs. Au même titre, je tiens à remercier M. Samuel Breton pour l’enrichissant travail de collaboration ayant engendré

Musique du rocher.

De plus, je tiens à remercier particulièrement mon épouse, Ariane Nantel, pour son aide précieuse dans chacune des étapes de mes études et sans qui je n’aurais pas su trouver le courage de mener à bien mes études de deuxième cycle. Je tiens à dédier ce mémoire à mon fils, Maxence Millette.

1

INTRODUCTION

En guise d’introduction, je définirai d’abord des expressions qui sont en lien avec le propos de ce mémoire, puis j’exposerai mes préoccupations artistiques générales ainsi que les objectifs créatifs qui ont mené à la composition des œuvres à l’étude. Dans le chapitre 1, je décrirai ensuite le contexte historique dans lequel s’inscrit le présent travail créatif. Puis, dans le chapitre 2, je présenterai les outils de composition assistée par ordinateur (CAO) que j’ai utilisés ainsi que les œuvres à l’étude. Toujours dans le chapitre 2, ces œuvres seront ensuite analysées de manière à exposer de quelles façons les outils de CAO ont été utilisés et en quoi ceux-ci se sont finalement avérés déterminants pour mon travail de composition. S’en suivra une conclusion qui fera la synthèse de mes recherches et de mon travail de création, et expliquera l’impact de l’utilisation des outils de CAO et de manipulation audio sur celui-ci.

Définitions

Composition assistée par ordinateur (CAO)

« La composition assistée par ordinateur (CAO) met en œuvre des formalismes et techniques dans une perspective musicale, afin de proposer des outils de modélisation et de calcul aux compositeurs de notre époque. Une partie de ces outils se manifeste sous la forme de langages de programmation dédiés […] » (Bresson, 2017).

Manipulation audio

Dans le cas de la manipulation audio, on utilise des enregistrements sonores et on les transforme par diverses manipulations (découpe, filtrage, ajout d’effets, mixage,

modification de vitesse ou encore inversion du sens de la lecture).

Musique acousmatique

In acousmatic music, which exists in recorded form and is designed for loudspeaker listening, the listener perceives the music without seeing the sources or causes of the sounds. Acousmatic music thus ruptures traditional notions of music reception. In

2

terms of content the genre, playing on its invisibility and liberty, is ideal for exploring the ambiguous and allusive play of causalities, metamorphoses, acoustic imagery and the behaviour of sounds in virtual spaces. The recorded format of acousmatic music allows the composer to combine sounds created at different times and on different systems, and offers the utmost flexibility for juxtaposing and superimposing sounds with attention to the finer details of sound quality (Concise

Oxford Dictionary of Music, 2012).

Travail « hors-temps » et « en-temps »

Les notions de « hors-temps » et de « en-temps » ont été définies d’abord par Iannis Xenakis dans son article « La Voie de la recherche et de la question »1. Dans cet article, Xenakis souligne :

Il faut distinguer deux natures : en-temps et hors-temps. Ce qui se laisse penser sans changer par l'avant ou l'après est hors-temps. Les modes traditionnels sont partiellement hors-temps, les relations ou les opérations logiques infligées à des classes de sons, d'intervalles, de caractères... sont aussi hors-temps. Dès que le discours contient l'avant ou l'après on est en-temps. L'ordre sériel est en-temps, une mélodie traditionnelle aussi. Toute musique, dans sa nature hors-temps, peut être livrée instantanément, plaquée. Sa nature en-temps est la relation de sa nature hors-temps avec le hors-temps. En tant que réalité sonore il n'y a pas de musique hors-hors-temps pure ; il existe de la musique en-temps pure, c'est le rythme à l'état pur.

A) Préoccupations artistiques

Tout au long de mes études de premier cycle en composition, mon intérêt pour la CAO s’est accru de manière constante, principalement par l’écoute d’œuvres acousmatiques, la recherche et l’expérimentation technique. Au terme de ces études, j’ai conclu que les processus créatifs et les résultats artistiques d’un très grand nombre de musiques composées à l’aide de l’ordinateur correspondent à mes intérêts esthétiques et techniques. En plus de mon travail créatif, je m’intéresse également, de manière générale, à l’impact des outils de CAO sur mon processus de création.

3

B) Influences musicales

Mon premier contact avec la musique acousmatique s’est fait au cours de mes études au baccalauréat. L’œuvre Rumeurs (place de Ransbeck) de Robert Normandeau, composée en 1987, m’a tout particulièrement marqué. J’ai été captivé par cette composition qui m’amenait dans des sentiers inouïs. J’entendais, pour la première fois, une musique d’art construite avec d’autres éléments que des sons instrumentaux traditionnels.

Parallèlement à l’écoute d’autres œuvres acousmatiques, j’ai commencé à écouter les sons de mon environnement avec une oreille musicale et dans une perspective compositionnelle. Cet intérêt m’a amené à explorer un nouvel univers sonore où des sons enregistrés, issus de l’environnement, devenaient autant de matériaux compositionnels potentiels.

Je me suis également intéressé aux aspects techniques de la musique acousmatique, plus particulièrement à la transformation électroacoustique des sons enregistrés, jusqu’à ne plus en reconnaitre la source, et aux moyens de les agencer. Pour ce faire, j’ai exploré la manipulation audio (découpage, manipulation de la vitesse, ajout d’effets, etc.) à l’aide de

stations audionumériques2. De plus, j’ai dû m’interroger sur la manière de créer un discours

musical cohérent, intéressant et original basé sur de tels matériaux sonores.

Il m’a ensuite été donné de découvrir la pièce L’esprit des dunes de Tristan Murail (1993-94), une œuvre dont la composition a été assistée par ordinateur. La CAO, que je ne connaissais pas nommément à ce moment-là, m’a alors séduit. En effet, cette approche venait rejoindre un autre de mes grands intérêts à savoir la programmation informatique. J’ai alors expérimenté différentes approches de création par ordinateur via des langages de programmation textuelle et visuelle, de manière à intégrer la CAO à mon processus créatif.

2Une station audionumérique est un système contrôlé par ordinateur permettant d’effectuer l’ensemble des manipulations

requises dans un projet audionumérique (l’enregistrement, l’édition, la manipulation et la lecture de fichiers audios ou vidéos) (Lambert, 2011).

4

C) Objectifs de création

Les œuvres composées ont été le terreau d’un travail de recherche et d’expérimentation de certains aspects de la CAO. Dans le contexte de composition de musiques pour le concert, ce projet vise deux objectifs généraux : (1) intégrer l’utilisation de l’ordinateur dans différents contextes de composition (acousmatique, mixte et exclusivement instrumental); (2) intégrer dans ma pratique compositionnelle l’utilisation de l’ordinateur pour générer des matériaux musicaux.

Trois objectifs techniques spécifiques découlent du deuxième objectif général : (1) synthétiser des sons à l’aide de la programmation textuelle, (2) organiser du matériau

concret3 à l’aide de la programmation visuelle et (3) travailler directement sur le matériau

sonore enregistrés et le transformer à l’aide d’une station audionumérique (enregistrer, éditer, transformer ou encore disposer « en-temps » les fichiers audio).

3 Par « matériau concret », j’entends l’enregistrements de sons non-musicaux tell que compris par l’école de Pierre

5

CHAPITRE 1

1.1 Programmation textuelle et visuelle

L’avènement de l’ordinateur dans les années 1940 a créé de nouveaux territoires d’expérimentations, particulièrement en musique. Bien plus qu’une machine à compter, l’ordinateur allait offrir aux compositeurs la possibilité d’explorer d’autres avenues que celles offertes par la musique instrumentale traditionnelle. Avec le développement des outils d’informatique musicale, la programmation informatique est devenue, autour des années 1980, un outil à part entière pour certains compositeurs.

Dans cette section, il est discuté sommairement du développement des différents types de programmation informatique utilisés en composition musicale (programmation textuelle et visuelle).

1.1.1 La programmation informatique textuelle : le cas de MUSIC N

Dans la programmation textuelle, les programmes créés reposent sur un code écrit sous forme de texte. Ce code est écrit dans un « langage de haut niveau »4. Ce code est

ensuite transformé en « langage machine » par un compilateur5. L’exemple 1 est un extrait

de programmation textuelle moderne tiré du Manuel canonique de Csound (Barry Vercoe, et al., en ligne).

4Selon l’Office québécois de la langue française, un langage de haut niveau est un « langage de programmation proche

du langage humain, conçu en fonction du type d'apprentissage auquel il est destiné et totalement indépendant de l'ordinateur utilisé » (Office québecois de la langue française, 2012)

5

Selon l’Office québécois de la langue française, un compilateur est un « programme qui convertit le code source d'une application écrite dans un langage de haut niveau en code objet formé d'instructions du langage machine, ou d'instructions très voisines, en vue de son exécution » (Office québecois de la langue française, 2012).

6

Exemple 1 Programmation textuelle moderne dans Csound

Les premiers programmes informatiques issus de la programmation textuelle et dédiés à la CAO remontent aux années 1950. C’est à cette époque que Max Mathews crée MUSIC I (1957), le premier d’une série de logiciels phares de la CAO. On regroupe aujourd’hui sous l’étiquette MUSIC N les logiciels découlant de MUSIC I.

Depuis MUSIC IV (1963), les logiciels de la suite MUSIC N ont en commun d’être divisés en deux grandes sections : la section instruments et la section partition. La section

instruments permet la construction de sons par des assemblages plus ou moins complexes

de générateurs de fréquences dits « unitaires ». La section partition (score) contient une

série d’instructions qui tiennent lieu de partition pour les instruments virtuels de la section

instruments (Mathews, 1963). Ces instructions permettent, par exemple, de commander à

un instrument de jouer une fréquence donnée pendant telle ou telle durée.

De tous les logiciels de la suite MUSIC N aucun n’a eu autant de succès auprès des compositeurs que MUSIC V (1968). Culmination des efforts de Mathews au Bell Labs, MUSIC V est une version du logiciel principalement écrit en FORTRAN, permettant son utilisation sur différentes plateformes informatiques (Lazzarini, 2013). Lazzarini précise

7

d’ailleurs que ce logiciel peut toujours être opéré sur les systèmes modernes. MUSIC V donnera éventuellement naissance à Cmix (1978), CMusic (1980), Music 4C (1985) et

Csound (1986), ce dernier étant toujours largement utilisé aujourd’hui. D’autres logiciels,

comme Commun Music (1989), clairement inspirés de la suite MUSIC N, sont le fruit d’une

programmation textuelle en langage de haut niveau de type LISP6.

1.1.2 La programmation informatique visuelle : les logiciels MAX et OpenMusic C’est au cours des années 1990 que des outils de programmation visuelle font leur apparition sur le marché de la CAO. La programmation visuelle consiste à relier entre-elles, sur l’écran de l’ordinateur, diverses « boites » qui sont en fait des fonctions informatiques

codées et déjà compilées. Les réseaux de relationsqui en découlent se nomment patch

(exemple 2). Ce nom est tiré des synthétiseurs modulaires des années 1950-60 où les patchs étaient un ensemble de boites physiques connectées par des fils (Pure Data, 2012). L’exemple 2 montre un patch en programmation visuelle tiré de ma pièce Musique du

rocher.

6

Langage de programmation datant des années 1950. Son nom vient de List Processing. Ce langage est très utilisé dans le domaine de l’intelligence artificielle. C’est également ce langage qui sous-tend le logiciel OpenMusic.

8

Exemple 2 Patch dans l’environnement graphique dans Pure Data, exemple de patch

Patchwork (1989) et MAX (1985) sont parmi les premiers logiciels de CAO basés

sur la programmation visuelle. Créé par Miller Puckette en 1985, MAX est l’un des systèmes de CAO les plus connus. « The Max paradigm can be described as a way of combining pre-designed building blocks into configurations useful for real-time computer music performance » (Puckette, 2002, p.31).

En 1988, Puckette a développé The Patcher, un environnement graphique pour

MAX et l’une des premières interfaces graphiques de programmation visuelle en CAO.

Cette interface donnera le visuel typique de MAX. Dans l’exemple 3, on voit un patch

simple dans The Patcher. L’utilisateur peut se servir des glissières verticales pour modifier en temps réel les paramètres du patch.

9

Exemple 3 Environnement graphique dans The Patcher

En 1994, Miller Puckette intègre les rangs de l’Université de Californie à San Diego. Désireux d’apporter des améliorations à MAX, il entreprend l’écriture d’un nouveau

logiciel, Pure Data. Celui-ci a été conçu dès le début comme un logiciel de source ouverte7

(Puckette, 2002).

Outre la famille MAX et Pure Data, la programmation visuelle compte la famille

PatchWork/OpenMusic. PatchWork est une interface graphique conçue à l’IRCAM basée

sur le langage LISP. Ce logiciel permettait de programmer des contenus musicaux en reliant des boites les unes aux autres. Également conçu à l’IRCAM et basé sur le langage

LISP, OpenMusic possède un visuel plus moderne et introduit le concept de maquette, qui

permet un contrôle précis des matériaux musicaux dans le temps (Agon, Assayag, Laurson, Rueda, 1999).

7

La source ouverte (ou code de source ouverte) fait référence à un mouvement social initié à la fin des années 1990 qui défendait l’accès libre des utilisateurs aux informations logicielles. Selon le site opensource.org, pour être considéré « source ouverte », un logiciel doit rencontrer 10 critères, à consulter au lien suivant : https://opensource.org/osd-annotated.

10

1.2 Stations audionumériques

Dans les années 1950, les compositeurs se réclamant de la musique concrète, tel Pierre Schaeffer, travaillaient avec des bandes électromagnétiques sur lesquelles étaient enregistrés les sons. De nos jours, les sons sont habituellement transformés en contenu numérique et stockés sur différents types de support reliés à un ordinateur (disque dur, disque à mémoire flash (SSD), stockage infonuagique). Les procédés mécaniques utilisés dans les studios analogiques de l’époque de Schaeffer pour manipuler le son (découpage, collage, ralentissement, accélérations, etc.) sont maintenant imités et prolongés par une kyrielle d’outils accessibles à partir d’une station audionumérique sur ordinateur personnel.

Il existe sur le marché un grand nombre de stations audionumériques, chacune ayant ses particularités, mais elles ont toutes quelques traits communs, notamment la possibilité d’accueillir plusieurs pistes, la possibilité de transformer les sons, la capacité de gérer des plugiciels (plugins) et une disposition horizontale du temps. L’exemple 4 montre l’interface graphique du logiciel Reaper. Il s’agit d’une configuration caractéristique des différentes stations audionumériques.

11

Exemple 4 Interface graphique de la station audionumérique Reaper

On voit dans la moitié inférieure de l’exemple 4 un ensemble de glissière (sliders) servant au contrôle du niveau d’intensité relative des pistes sonores ainsi qu’à celui des effets, le cas échéant. Dans la moitié supérieure, à droite, sont disposé une représentation des fichiers sonores sur un axe temporel horizontal et, à gauche, d’autres contrôles de pistes.

1.3 Logiciels d’analyse spectrale, d’édition et de resynthèse

Les logiciels d’analyse spectrale, d’édition et de resynthèse forment un groupe d’outils important. Ils permettent d’extraire d’un fichier sonore l’ensemble des partiels d’un son et de les modifier. Plusieurs logiciels existent, parmi eux : AudioSculp, MetaSynth et SPEAR. Ce dernier a été développé à la Columbia University par Michael Kateley Klingbeil. La première démonstration de ce logiciel s’est faite lors du Columbia University Computer Music Center en février 2004 (Kateley Klingbeil, 2009).

12

1.4 Intégration des outils de CAO dans mon travail créatif

À travers quatre musiques composées dans le cadre de ma maîtrise (De deux choses

Lune, Or Chess, Par ailleurs et Musique du rocher), j’ai pu explorer et mettre en pratique

divers outils de CAO. De plus, je me suis plus spécifiquement penché sur la manipulation audio sur station audionumérique dans une cinquième pièce (L’Ombre véritable).

J’ai exploré la génération de matériaux sonores et musicaux à l’aide de la programmation textuelle dans De deux choses Lune (logiciel Common Music) et à l’aide de la programmation visuelle dans Or Chess (logiciel OpenMusic). J’ai notamment créé, dans ce dernier cas, des rythmes et des articulations de phrasés spécifiques. Par ailleurs, grâce aux analyses spectrales réalisées à l’aide de SPEAR, j’ai extrait le matériau brut nécessaire au fonctionnement des patchs créés dans OpenMusic pour Or Chess.

Dans Musique du rocher, où des fichiers sonores enregistrés sont diffusés de façon aléatoire, j’ai approfondi la programmation visuelle dans Pure Data. Dans ma pièce acousmatique Par ailleurs, j’ai composé les diverses textures sonore à l’aide du logiciel de programmation textuelle Csound. Finalement, à l’aide d’une station audionumérique (Reaper), j’ai manipulé des enregistrements de harpe et de voix pour composer la pièce

L’ombre véritable.

13

CHAPITRE 2

2.1

Composition

assistée

par

ordinateur

:

recherches

préliminaires

Le travail d’élaboration de ma maîtrise a débuté par une investigation visant à déterminer les divers outils de CAO qui s’offraient à moi. Les différents articles que j’ai consultés m’ont fourni un grand nombre de logiciels de CAO à considérer et à évaluer. J’ai sélectionné et catégorisé certain de ces logiciels selon leurs modes de fonctionnement.

2.2 Sélection des logiciels de CAO

La sélection d’un logiciel de CAO pour mon travail s’est faite selon trois critères : 1) le logiciel devait être abordable sur le plan financier, 2) il devait être bien adapté et efficace dans le contexte de la musique à composer et 3) il devait être plaisant à utiliser. C’est ce dernier point qui allait fixer mon choix entre deux logiciels de performance et de coût équivalents. Le tableau 1 expose les logiciels sélectionnés pour mon travail.

Tableau 1 Logiciels de CAO sélectionnés pour mon travail de composition

Type de logiciel Programmation visuelle « en-temps » Programmation textuelle « hors-temps » Programmation visuelle « hors-temps » Station audionumérique Analyse spectrale Choix de logiciel

Pure Data Common Music

Csound OpenMusic Reaper SPEAR

2.2.1 Pure Data

Pure Data est un logiciel de programmation visuelle de source ouverte. Il est conçu

pour effectuer un travail en direct. Il permet de gérer et modifier divers contenus : audio, MIDI, vidéo, graphique, senseurs et des périphériques d’entrée.

J’ai choisi d’utiliser Pure Data pour diffuser Musique du rocher en continu pendant la durée de l’exposition (un mois) où elle était présentée. En plus des fonctionnalités de

14

base du logiciel, le fait qu’il soit de source ouverte et gratuit a particulièrement influencé mon choix.

2.2.2 Common Music

Common Music est un logiciel de programmation texte destiné à des fonctions «

en-temps » et « hors-en-temps ». Il est basé sur le langage SAL et permet, entre autres, de générer des suites de nombres pour leur appliquer des permutations. Des fonctions MIDI et de lecture audio sont également incorporées au logiciel. J’ai choisi de travailler avec Common

Music pour la pièce De deux choses Lune essentiellement afin de m’initier, dans le contexte

de la CAO, à la programmation textuelle à l’aide du langage SAL, proche du langage LISP, mais nettement plus simple.

2.2.3 Csound

Csound est un compilateur audio en langage C dans la famille de MUSIC N. Il

permet de créer des instruments (point 1.1.1) et de les manipuler par la suite. Basé sur des générateurs unitaires et programmable par l’utilisateur, Csound est un système de musique par ordinateur écrit à l’origine par Barry Vercoe (1984) comme la première version en langage C de ce type de logiciel (Barry Vercoe et. al., 2014).

La dernière version du logiciel Csound, bien que relativement complexe, reste très performant malgré quelques archaïsmes hérités de ses premières versions. On explique d’ailleurs dans son manuel de référence :

Il y a des systèmes de musique par ordinateur plus récents qui ont des éditeurs graphiques de patch (par exemple Max/MSP, [Pure Data], jMax, ou Open Sound World), ou qui utilisent des techniques d'ingénieurie (sic.) logicielle plus avancées (par exemple Nyquist ou SuperCollider). Cependant Csound possède toujours l'ensemble le plus important et le plus varié de générateurs unitaires, est le mieux documenté, s'exécute sur le plus grand nombre de plates-formes, et il est très facilement extensible (Barry Vercoe et al., 2014).

15

J’ai choisi Csound parce qu’il assure un accès facile à des ressources d’aide en ligne et parce qu’il me permettait de réaliser l’ensemble de mes objectifs de création pour ma pièce Par ailleurs. En outre, il m’était accessible gratuitement.

2.2.4 OpenMusic

OpenMusic a été développé à l’Institut de recherche et coordination

acoustique/musique (IRCAM) à compter de 1986. Dernier né d’une longue liste de logiciels de programmation visuelle, il est un des rares à générer des données musicales « hors-temps » symbolisées sous forme de notation musicale traditionnelle. Outre le logiciel

PWGL, OpenMusic est le seul logiciel à offrir un contrôle aussi grand des matériaux

musicaux.

Comme je tenais à avoir un logiciel qui puisse traduire en notation musicale traditionnelle les données « hors-temps » fournies, j’ai dû faire un choix entre PWGL et

OpenMusic, tous deux gratuits. J’ai trouvé l’utilisation de ce dernier plus instinctive que celle de PWGL, d’où mon choix final.

2.2.5 Stations audionumériques

J’ai également eu besoin d’une station audionumérique pour mener à bien mon travail de composition pour la pièce L’ombre véritable. Grâce au cours de mixage que j’avais suivi au baccalauréat, je connaissais déjà différentes stations audionumériques, dont

Reaper, que j’utilise dans ma pratique professionnelle. Cette station audionumérique est

conçue d’une manière différente des autres, Pro Tools ou Digital Performer par exemple.

Reaper a en effet le double avantage d’être proposé à un coût raisonnable et de ne pas être

assujettie, comme les stations plus anciennes, aux limitations du monde analogique duquel elles s'inspirent. Par exemple, la quantité de sorties audio par tranche est quasi illimitée. De plus, il n'est pas nécessaire de spécifier à quoi servira la piste avant de la créer, une piste

16

pouvant recevoir un signal MIDI, audio ou vidéo. Elle peut également se voir attribuer le rôle de BUS8 ou de traitement d'effets.

2.2.6 SPEAR

Plusieurs logiciels d’analyse du spectre des sons offrent la possibilité d’éditer et de resynthétiser un son issu d’un fichier audio. L’un de ceux-ci, le logiciel SPEAR (Sinusoidal Partial Editing Analysis and Resynthesis), est un logiciel gratuit qui permet l’analyse d’un signal sonore selon le théorème de Fourier. Ce théorème « montre qu’une fonction périodique peut être décomposée en une série de fonctions sinusoïdales (série de Fourier) de fréquences et [d’] amplitudes variables. Celui-ci [le théorème] est généralisé par la transformée de Fourier qui permet d’associer un spectre en fréquence à une fonction intégrable quelconque » (Bresson, 2007, p.21). Le théorème de la transformée de Fourier est le suivant :

Un des formats utilisés par SPEAR est le SDIF. Ce format est polyvalent pour la gestion des données audio. Jean Bresson précise que « le format SDIF (Sound Description Interchange Format) a été développé conjointement par l’IRCAM et le CNMAT de Berkeley afin de disposer d’un standard ouvert et multiplateformes permettant la codification, le stockage et l’échange de données de description sonore » (Bresson, 2007, p. 125). J’ai choisi SPEAR, car il est le seul logiciel gratuit d’analyse spectrale, d’édition et de resynthèse que j’ai trouvé. De plus, il est facile de l’intégrer à des patchs dans

OpenMusic.

2.3 Présentation sommaire des œuvres à l’étude

La présentation des œuvres à l’étude est divisée en deux sections : 1) les œuvres composées pendant une phase exploratoire de la CAO et 2) les œuvres plus abouties, pour lesquelles l’usage de la CAO est plus contrôlé. Dans chacune de ces sections, les œuvres sont présentées selon l’ordre chronologique de leur composition.

8

17

2.3.1 Œuvres composées lors de la phase exploratoire

Les œuvres que j’ai composées dans le cadre de ma phase exploratoire sont De deux

choses Lune et L’ombre véritable. La première fait un usage limité de programmation

textuelle. La seconde utilise la manipulation audio.

J’ai expérimenté ces deux techniques de composition afin de découvrir où se situait mon intérêt quant à l’utilisation de l’ordinateur dans le processus de composition. À la suite de ce travail, j’ai choisi de me concentrer sur la CAO proprement dite. En effet, j’ai de loin préféré le travail de programmation, qui me semble au cœur de la CAO, à la logistique qu’implique la manipulation propre à la musique acousmatique (enregistrements, réécoute, sélection, manipulation et organisation des fichiers sonores).

2.3.1.1 De deux choses Lune

De deux choses Lune (voir annexes A et B) est une œuvre pour flûte, clarinette,

violon, violoncelle amplifiés et environnement sonore sur haut-parleurs, d’une durée de 3:15. L’amplification des instruments est importante, car elle permet de garder un équilibre d’intensité entre l’environnement sonore et les moments bruités, très doux, des instruments.

Cette œuvre a été commandée par l’ensemble Lunatik, de Québec, pour être jouée

dans un concert célébrant le 100e anniversaire de la création de l’œuvre majeur de

Schoenberg : Pierrot Lunaire. Le titre, De deux chose Lune, est d’ailleurs un clin d’œil au titre de l’œuvre de Schoenberg. Dans cette pièce, j’ai notamment mis en place une opposition entre la méthode compositionnelle utilisées pour l’ensemble instrumental et celle utilisée pour créer l’environnement sonore diffusé sur haut-parleurs. En effet, si cet environnement a été composé à partir de sources sonores concrètes, le discours musical de l’ensemble instrumental a, quant à lui, été composé sur ordinateur à l’aide du logiciel

18 2.3.1.2 L’ombre véritable

L’ombre véritable (voir annexes C et D) est une œuvre pour harpe, voix, voix

enregistrée et harpe enregistrée, d’une durée de 8:03. Elle est écrite sur un poème d’Ariane Nantel, lequel aborde l’abus sexuel d’enfants du point d’un spectateur impuissant, en l’occurrence le narrateur.

Il s’agit d’une œuvre mixte, soit une association en concert d’instruments acoustiques et d’une partie électroacoustique (Cont & Rhéaume, 2012). L’environnement sonore diffusé sur haut-parleurs a été réalisé à partir de plusieurs sons enregistrés de la harpe et de la voix chantée. Il y a donc une proposition miroir entre l’environnement sur haut-parleurs (harpe et voix enregistrées) et les musiciens sur la scène (harpe, chanteuse) : chaque instrumentiste sur scène possède un double acousmatique.

2.3.2 Œuvres utilisant la CAO de façon plus avancée

2.3.2.1 Par ailleurs

Par ailleurs (voir annexe F) est une œuvre acousmatique, c’est-à-dire une pièce

destinée à être diffusée uniquement sur haut-parleurs. Cette pièce, d’une durée de 9:44, est une commande du producteur de spectacle Erreur de type 27 (ville de Québec). Elle fut créée le 27 février 2015 au LANTISS de l’Université Laval sur un dôme de 26 haut-parleurs. Les matériaux sonores de cette pièce ont été créés à l’aide du logiciel de programmation textuelle Csound. Afin de faciliter leur articulation dans le temps, les matériaux ont ensuite été mis « en-temps » dans la station audionumérique Reaper.

Caractéristique importante, Par ailleurs explore la spatialisation comme élément discursif et traite donc l’espace comme un paramètre d’importance égale aux paramètres plus communs de la musique occidentale (hauteur, durée, timbres, intensité). À cette fin, il m’a été permis de travailler pendant près d’une semaine avec un dôme de 24 haut-parleurs (auxquels il faut ajouter deux amplificateurs de basse) afin de tester certaines idées prédéfinies et d’en expérimenter de nouvelles.

19 2.3.2.2 Musique du rocher

Musique du rocher (voir annexes G et H), une commande de l’artiste visuel Samuel Breton, est un « paysage sonore » créé à l’aide du logiciel Pure Data. Cette œuvre n’a pas de durée à proprement parler, l’algorithme utilisé générant des évènements sonores en continu. J’y explore le paradigme de la programmation visuelle (programmation du « paysage sonore ») dans un objectif de diffusion « en-temps » dans la salle où a été présentée l’exposition Saint-Centre, Sauveur Durocher.

2.3.2.3 Or Chess

Or Chess (voir annexe I) est une œuvre pour orchestre symphonique, d’une durée de

9:20. Dans cette pièce, une partie d’échecs est utilisée comme élément structurant et discursif. Les hauteurs sont par exemple extraites du spectre de chacun des phonèmes du mot « échecs » selon un réseau fourni par chaque coup de la partie. J’utilise le logiciel de programmation visuelle OpenMusic pour extraire les hauteurs du spectre et les interpréter comme éléments musicaux. L’intégration de la CAO se fait donc ici suivant un objectif de gestion « hors-temps » des matières.

2.4 Analyse de l’utilisation des outils de CAO dans chaque œuvre

2.4.1 De deux choses Lune

De deux choses Lune (voir annexes A et B) est une pièce de musique mixte pour

flûte, clarinette, violon, violoncelle amplifiés et environnement sonore sur haut-parleurs. La pièce est construite autour de deux types contrastants de matières musicales, soit une « musique de notes » agitée – une musique somme toute assez conventionnelle – et une « musique de timbres », c'est-à-dire une musique constituée de sonorités produites à l'aide de techniques instrumentales avancées. La « musique de notes » a été composée sur ordinateur à l’aide du logiciel Common Music. La « musique de timbres » a quant à elle été composée sans l’aide de la CAO. Voici un exemple de chacune de ces matières musicales :

20

Exemple 5 Musique de notes (De deux choses Lune, mes.10-11)

Exemple 6 Musique de timbres (De deux choses Lune, mes.12-15)

De son côté, l’environnement sonore diffusé sur haut-parleurs sert en quelque sorte de liant entre les deux principaux types de matières musicales. Il leur permet de s’articuler à l’intérieur des discours malgré leur haut niveau de contraste. L’environnement sonore est composé à l’aide de sons enregistrés, puis transformés dans une station audionumérique.

21 2.4.1.1 Forme de l’œuvre

De deux choses Lune est une pièce en cinq sections (voir tableau 2). Chaque section

dure en moyenne 38 secondes. Les deux principaux types de matière musicale (musique de notes, musique de timbres) sont exposés brièvement dans les sections A et A’. Ces expositions sont suivies d’un bref tuilage de ces matières dans la section A'', puis d’une courte transition polyrythmique dans la section B. Dans la dernière section (A+B), l’ensemble des éléments présentés précédemment est fusionné : des segments mélodiques sont construits à l’aide d’éléments de musique de timbre des sections A et d’éléments du complexe rythmique de la section B. Le tableau 2 résume la forme de la pièce.

Tableau 2 Forme et élément caractéristiques de De deux choses Lune

2.4.1.2 Utilisation des outils de CAO dans De deux choses Lune

De deux choses Lune est la première pièce que j’ai écrite dans le cadre de ma

maîtrise. L’utilisation de l’ordinateur y est basique, mais jette les bases de ma réflexion sur ma démarche artistique. J’y ai utilisé la programmation textuelle pour générer des suites de nombres avec lesquels j’ai construit des motifs mélodico-rythmiques.

J’ai utilisé le logiciel Common Music avec l’interface Grace. Cet environnement de travail offre beaucoup plus de possibilités que mon utilisation le suggère. Cependant, mon objectif était de faire mes premiers pas avec la CAO.

Sections A A’ A’’ B A+B

Mesures 1-8 9-20 21-31 32-38 39-53 Durée 0:28 0:35 0:45 0:23 0:59 Nuances Éléments caractéristiques Musique de notes agitée suivie de moments calmes caractérisés par le timbre. Musique de notes agitée suivie de moments calmes caractérisés par le timbre. Tuilage des éléments des sections précédentes. Polyrythmies , très peu de mouvements mélodiques. Tuilage des éléments des sections précédentes.

22

L’interface Grace se présente en fenêtres : une première fenêtre d’édition où l’on écrit le code (exemple 7) et une seconde fenêtre, nommée console, où s’affiche le résultat du code écrit dans la fenêtre d’édition (exemple 8).

Exemple 7 Fenêtre d’édition dans le logiciel Grace

Exemple 8 Fenêtre console dans le logiciel Grace

2.4.1.2.1 Langage informatique utilisé

Le logiciel Common Music est basé sur le langage de haut niveau SAL : Simple

23

Taube, professeur de composition et de théorie musicale à l’Université de l’Illinois, note d’ailleurs :

SAL incorporates many features of Lisp while avoiding the two most confusing aspects of Lisp programming style: prefix notation and the use of Quote to block evaluation […] As a result the SAL language is expressive but easy to learn so composers are able to start designing musical algorithms almost immediately (Taube, 2007).

Ce langage de programmation simple m’a permis d’obtenir aisément des résultats utiles et a confirmé mon intérêt pour la composition assistée par la programmation informatique.

2.4.1.2.2 Gestion du rythme, de l’articulation et des attaques à l’aide de la CAO

Dans De deux choses Lune, le nombre d’attaques par temps et l’articulation des motifs mélodiques ont été organisés grâce à un programme que j’ai conçu à cette fin à l’aide de Common Music. Six variables ont été nécessaires pour construire ce petit programme : 1- motif_a; 2- motif_b; 3- motif_c; 4- motif_d; 5- attaques (att); 6- articulations (arti).

Les variables 1 à 4 sont autant de motifs mélodiques que j’ai composé au piano, à l’oreille. De son côté, la variable att contient le nombre d’attaques dans une pulsation. Finalement, la variable arti contient le nombre de sons devant être joués legato. Dans le langage SAL, la définition des variables se fait dans un bloc de codes délimités par les mots

begin et end. L’exemple 9 montre la définition de mes six variables dans le langage SAL.

24

La variable motif_c de l’exemple 9 utilise le point d’interrogation (?) pour symboliser un long motif chromatique. Le code présenté à l’exemple 10 est celui qui permet l’interaction des variables décrites dans le bloc de codes présenté à l’exemple 9.

Exemple 10 Code d'utilisation des variables

Ce code, résolument simple, est écrit dans la fenêtre d’édition de l’interface Grace. Il génère quatre lignes de texte dans la fenêtre console qui donne les informations suivantes : la première ligne sélectionne un instrument, la deuxième détermine l’ordre des groupes d’attaques, la troisième sélectionne le motif mélodique utilisé et, enfin, la quatrième ligne détermine le phrasé. Un des résultats possibles du code illustré à l’exemple 9 est présenté à l’exemple 11. Je retranscris ensuite ce résultat en notation musicale (exemple 12).

25

Le processus expliqué ci-haut a été répété plusieurs fois. Cette méthode de travail m’a permis de composer la section A et ses variantes, ainsi que les patrons rythmiques de la section B. La superposition de lignes mélodico-rythmiques ainsi générées m’a permis d’obtenir l’effet de masse désiré dans chacune des sections.

2.5.1.3 Conclusion

J’ai expérimenté au cours de la composition de De deux choses Lune plusieurs façons de concevoir le code avec lequel j’ai finalement organisé le discours musical de l’œuvre. En effet, plusieurs codes permettaient d’arriver à un résultat comparable, celui retenu est le plus concis et efficace de ceux mis à l’essai. Ce travail basique de composition à l’aide de l’ordinateur m’a permis de confirmer mon intérêt pour la CAO. De plus, il m’a donné une bonne expérience de programmation – bonne habitudes de mise en forme, clarté du code, etc. – et m’a permis d’affiner ma compréhension de la logique inhérente à la programmation.

2.4.2 L’ombre véritable

La seconde pièce de la phase exploratoire de mon travail est L’ombre véritable (voir annexe C et D), une œuvre pour voix, harpe, voix enregistrée et harpe enregistrée. J’y explore la manipulation audio à l’aide de la station audionumérique Reaper.

Le texte utilisé dans cette pièce est un poème éponyme d’Ariane Nantel qui dénonce l’abus sexuel sur les enfants. Ce texte m’a donné l’idée d’une métaphore de la dépersonnalisation vécue par certains enfants abusés : chaque musicien sur scène aurait son double acousmatique sur haut-parleurs grâce à la manipulation audio. En effet, « comme

26

par un effet de miroir, l'enfant [victime d’abus] perd l'image de soi, en captant celle de son abuseur. Cette image est notamment caractérisée par l'impossibilité d'avoir des relations égalitaires avec les autres. L'enfant se voit comme un objet usé ou un tas de chair avariée. Cette dévalorisation conduit à une dépersonnalisation et à une cassure identitaire » (Harsevoets, 2002).

Cette idée de dépersonnalisation est à la base de l’utilisation de la voix enregistrée. Métaphoriquement, cette dernière représente la dépersonnalisation de l’enfant abusé. Et pour amplifier cette idée de dépersonnalisation, la voix enregistrée a été dénaturée par différents filtres pour en changer le timbre. L’utilisation d’une harpe diffusée sur haut-parleurs a été approchée globalement de la même manière : le rôle de celle-ci est de représenter un monde intérieur étrange, où des distorsions brouillent les pensées.

Ainsi, l’environnement sonore diffusé sur haut-parleurs représente l’intériorité, tandis que la musique jouée par les musiciens est associée à l’extériorité. La musique de la trame sonore est donc plus introspective, baignée d’une atmosphère caverneuse. Elle traduit une réflexion, alors que les musiciens traduisent plus l’action.

2.4.2.1 Forme et caractéristiques de l'œuvre

L’œuvre présente une forme continue. À travers cette directionnalité du discours sans retour, plusieurs objets sonores ponctuant régulièrement la trame acousmatique sont utilisés comme repères sructurels pour les musiciens et les auditeurs. La courbe dramatique de L’ombre véritable se calque sur celle du poème (voir annexe E). Le texte intégral est présenté à l’annexe E.

La dixième strophe du texte m’apparaît particulièrement intéressante (exemple 13). Elle contient cinq vers, un nombre impair, alors que toutes les autres strophes en contiennent un nombre pair. De plus, comme pour souligner la violence qu’il évoque, le dernier vers ne se termine pas par une rime, ce qui détone par rapport à ce qui est établi jusque là.

27

Exemple 13 Dixième strophe de L'ombre véritable

À mon sens, le sommet de ce texte est le « Non! », qui est le seul vers, le seul mot même de la neuvième strophe. Ce sommet en est également un dans la musique. La grande agitation agogique de la harpe et de l’environnement sonore marque à ce moment le sommet.

2.4.2.2 Utilisation des outils de CAO dans L’ombre véritable

Au cours de l’enregistrement des sons de la harpe pour la partie acousmatique, j’ai cherché à capter la grande diversité de sonorités de l’instrument, guidé par la harpiste Yvonne Liu. Dans cette section, je discuterai des éléments techniques de manipulation audio (filtres, mixage/montage, application d’effets, etc.) ainsi que des différents types de sonorités que j’ai enregistrés et retravaillés.

C’est dans un studio du Laboratoire des nouvelles technologies de la scène et du son (LANTISS) de l’Université Laval, que la séance d’enregistrement a eu lieu. Nous avons réalisé l’enregistrement à l’aide de trois microphones de proximité et une boule de plusieurs micros unidirectionnels (Holophone Surround) permettant une prise de son multidirectionnelle. Les trois micros de proximité étaient situés à des endroits stratégiques : deux à l’avant et un à l’arrière. Grâce à cette disposition, j’avais accès, pour chaque prise de son, à des qualités timbrales distinctes pour une même source sonore. La boule de micros captait, quant à elle, la résonance et la réverbération de la salle.

Afin de profiter au maximum du temps de studio imparti, j’ai esquissé sur papier un schéma descriptif de la trame acousmatique en vue de l’enregistrement. Plusieurs techniques de jeu ont été utilisées pour produire les différents types de son souhaités : des

D’une seule main il t’empoigne, Le monstre n’est pas sous le lit, Il s’étend contre toi malgré tes cris, Il te tient, s’accroche et s’éloigne Sous un prétexte d’amour que tu hais!

28

sons percussifs, filés, à hauteurs définies ou indéfinies, avec ou sans résonance, sons conventionnels, etc.

Les sons enregistrés provenant de modes de jeux non-standard sont :

❖ produire des sons avec mécanisme des pédales;

❖ exécuter diverses motifs rythmiques percussifs sur la table d’harmonie; ❖ gratter des cordes verticalement;

❖ enfoncer une demi-pédale, afin de créer une distorsion dans le timbre des cordes; ❖ percuter les cordes avec une cuillère de métal;

❖ frotter les cordes avec un ruban de tissu;

❖ attacher un/des élastiques sur les cordes (son percussif se terminant par la résonance d’une harmonique);

❖ insérer du papier entre les cordes (aigues).

Les manipulations audios effectuées sur les enregistrements de la harpe sont :

❖ l’application de filtres de fréquence (de très larges à très pointus); ❖ l’ajout de distorsion;

❖ l’étirement de sons dans le temps; ❖ le renversement du sens de lecture;

❖ l’ajout d’écho, de délais et de réverbération.

La séance d’enregistrements a donné environ deux heures de sons viables de harpe. J’ai d’abord classé les sons en fonction de leur principale caractéristique timbrale en faisant plusieurs dossiers dans la station audionumérique Reaper (sons percussifs, sons lisses, modes de jeux). J’ai ensuite travaillé avec Reaper pour la mise « en-temps » et la manipulation audio des fichiers sonores (montage/mixage, ajout d’effet, etc.).

29

J’ai créé la trame acousmatique en concomitance avec la composition de la partie instrumentale. La trame acousmatique est organisée dans Reaper comme la partition en terme de division de tempos et de métriques, ce qui permet de fins ajustements. Ce type d’organisation est d’autant plus efficace que les musiciens qui doivent se synchroniser au défilement de la trame acousmatique.

De son côté, la voix enregistrée a été captée dans mon studio personnel avec un seul micro. Il s’agit d’un micro de type SM58 (de SHURE), couramment employé pour capter la voix chantée ou parlée.

Comme elle vise à représenter la dépersonnalisation de l’enfant, la voix enregistrée n’est que très rarement diffusées sans traitement ou effets, pour marquer la différence entre la chanteuse et son double acousmatique. Parmi les traitements appliqués, il y a :

❖ filtrage de fréquences; ❖ distorsion;

❖ écho, délais et réverbération.

Contrairement à la harpe, pour laquelle je n’avais initialement que des esquisses, la voix enregistrée a été composée de manière détaillée avant la séance d’enregistrement. Elle est considérée comme une partie soliste dans la trame acousmatique.

2.4.2.3 Conclusion

La composition de L’ombre véritable m’a permis, entre autres choses,de travailler

avec le son directement, comme un sculpteur travaille un bloc de marbre. Dans une optique d’exploration de la station audionumérique Reaper et de la manipulation audio, j’ai circonscrit mon travail autour des techniques de manipulation audio les plus communes, soit l’application de filtres de fréquence, l’ajout de distorsion, l’étirement de sons, le renversement du sens de lecture ainsi que l’ajout d’écho, de délais et de réverbération.

30 2.4.3 Par ailleurs

Par ailleurs (voir annexe F) est une œuvre acousmatique dans laquelle l’articulation

discursive se base principalement sur la spatialisation des évènements sonores.

2.4.3.1 Forme et discours de l’œuvre

La pièce est divisée en cinq sections, les deux premières étant reliées par une courte transition. La forme est la suivante : A-transition-B-A’-C-D. Chacune des sections de Par

ailleurs comporte des sonorités spécifiques, ainsi qu’un discours de spatialisation distinct.

Les sections A et A’ sont caractérisées par des sons de types « cloches » (timbre inharmonique, transitoire d’attaque similaire à la cloche, etc.). Le premier A présente l’espace comme s’il s’agissait d’un motif rythmique, chacun des sons entendus provenant d’un point différent. La section B, par contraste, fait entendre des sons lisses, ponctués de battements. Les composantes harmoniques y sont bien perceptibles. La transition, qui relie la section A à la section B, amalgame leurs timbres caractéristiques (sons de cloche et sons lisses) et exploite le plein potentiel de l’espace de diffusion en projetant sur 360 degrés la musique. De son côté, la section C est constituée d’un son de type « cloche » avec une attaque de tam-tam. Lors de la création de l’œuvre cette attaque a été diffusée au plancher tandis que la résonance, pouvant s’apparenter aux résonances d’un carillon éolien (wind

chime), montait au-dessus de l’auditeur. Enfin, la section D présente un son dense et

complexe qui se présente sous la forme d’un glissando ascendant qui tourne autour des auditeurs. Le tableau 3 résume la forme et certaines caractéristiques de Par ailleurs.

31

Tableau 3 Forme et caractéristiques des discours de Par ailleurs

Sections A Transition B A’ C D Temps +

durée 1:23 1:23 – 1 :50 1:50 – 5:36 5:36 –6:18 6:18 –7:35 7:35 –9:50 Nuances

→

→

→

→

→

Densité Moyenne/faible Moyenne

Faible à moyennement

forte

Moyenne/faible Faible Forte

Discours spatial

Établissement de l’espace par la diffusion des sons en plusieurs points du dôme de haut-parleurs Diffusion sur l’ensemble du dôme qui englobe l’auditeur Diffusion sur l’ensemble du dôme qui englobe

l’auditeur. Diffusion des sons en plusieurs points du dôme de haut-parleurs

L’attaque est au sol sur 360 degré tandis

que la résonance monte au-dessus de l’auditeur Tournoiement autour des auditeurs Timbre dominant Cloches inharmoniques Sons lisses et cloches Sons lisses ponctués de battement. Les formants sont bien

perceptibles

Cloches inharmoniques

Son de type « cloche » avec une attaque de tam-tam. La queue de résonance, très longue, met en évidence différents formants Sons lisses très denses avec saturation. Immense cluster

2.4.3.2 Utilisation des outils de CAO

La pièce Par ailleurs ne comporte aucune partition traditionnelle. Cette musique est composée à l’aide de codes informatiques écrits dans le logiciel Csound. Dans le texte qui suit, j’exposerai d’abord la structure et les fonctionnalités de base de Csound. Ensuite, j’expliquerai de quelle manière j’ai utilisé Csound dans la composition de Par ailleurs.

L’exemple 14 présente l’interface Csound. Il s’agit de la structure textuelle du code informatique générant le son entendu dans la section D de Par ailleurs.

32

Exemple 14 Structure de l’interface dans Csound (Par ailleurs, section D)

La fenêtre d’édition des fichiers .csd (format des fichiers Csound) comporte deux sections distinctes (voir exemple 14), dans l’ordre : la section 1 est dédiée à la création d’instruments virtuels (instruments) et la section 2 fait office de partition à exécuter (score). Cette dernière présente, en code, l’ordre des évènements ainsi que l’utilisation des instruments créés dans la section 1.

+

Section 1 « instrument »

33 2.4.3.2.1 La synthèse sonore : exemple dans Csound

La synthèse sonore peut être définie comme « la construction de sons de manière artificielle, par combinaison d’entités élémentaires » (Bresson, 2007, p. 15). Il existe plusieurs formes de synthèse sonore, dont la synthèse additive obtenue par l’addition d’entités élémentaires, soit les partiels9. Ceux-ci sont combinés afin de produire des sons

artificiels plus ou moins complexes. La structure fondamentale d’un instrument de synthèse additive est présentée à l’exemple 15 :

Exemple 15 Schéma de synthèse additive (Bresson, 2007, p. 27)

Il y a plusieurs façons de réaliser une synthèse additive dans Csound, tout dépend du niveau de contrôle désiré. Dans le cadre de Par ailleurs, j’ai créé des sons en contrôlant précisément l’amalgame de partiels, c’est-à-dire en choisissant les partiels de manière individuelle.

La définition d’un instrument de synthèse additive comporte habituellement

plusieurs oscillateurs10. Dans Csound, le générateur unitaire poscil est utilisé plusieurs fois

pour obtenir une synthèse additive. L’exemple 16 présente une réalisation de synthèse

9Un partiel est une composante simple d’un son. La somme des partiels donne le timbre. 10

34

additive dans Csound à l’aide de quatre oscillateurs dont l’amplitude décroit et où la fréquence est préciser dans la section 2 score.

Exemple 16 Réalisation d'un instrument de synthèse additive dans Csound

Dans l’exemple 16, l’en-tête sert à définir les paramètres généraux des instruments pouvant être construits dans le projet, tel que le nombre de canaux (chnls = 2), ou la fréquence d’échantillonnage (sr = 44100). L’instrument élaboré dans la section 1 de l’exemple 16 est composé de quatre oscillateurs (ici poscil). Par exemple, à la ligne 13, a1 est le nom que j’ai donné à cet oscillateur spécifique. Puis, poscil est l’oscillateur utilisé, le

0.8 correspond à l’amplitude du signal et le p4 se rapporte à la fréquence. De son côté, le

code de la deuxième section de l’instrument permet d’envoyer le signal sonore aux haut-parleurs.

L’exemple 17 présente un code informatique qui utilise l’instrument créé selon le code de l’exemple 16.

Exemple 17 Partition de l'exemple 16

Table de fonction

Champs de paramètres Section 1

En-tête

35

Dans l’exemple 17, on retrouve d’abord la définition de la table de fonction11 utilisée à la ligne 25. Les champs de paramètres à la ligne 27 sont divisés en deux parties, les chiffres de gauche correspondant respectivement (1) au nom de l’instrument, (2) au temps de départ et (3) à la durée (en secondes) de l’intervention. Les champs de paramètres de la partie de droite permettent de varier la fréquence de chacun des oscillateurs définis dans la section 1 de l’exemple 16.

2.4.3.3 Diffusion sur dôme

Lors de la création, la diffusion de Par ailleurs s’est faite à l’intérieur d’un dôme constitué de 26 haut-parleurs, incluant deux amplificateurs de basses fréquences. J’ai eu la chance de travailler pendant près d’une semaine avec ce dôme installé dans les locaux du LANTISS à l’Université Laval. Ce travaille m’a notamment permis d’automatiser entièrement le discourt spatial de l’œuvre à l’aide de station audionumérique Reaper. Ce discours avait été esquissé d’abord lors du travail « hors-temps », puis a été remanié et adapté aux dômes dans les locaux du LANTISS.

Le dôme comportait quatre niveaux de haut-parleurs : trois circulaires concentriques et un quatrième muni d’un seul haut-parleur tout au sommet du dôme. Au sol, deux amplificateurs de basses fréquences étaient disposés de part et d’autre de cette « scène » circulaire.

Le discours spatial de l’œuvre repose sur une division du dôme en quatre quadrants. Un long développement discursif de deux types de sons s’étend sur l’ensemble de la durée de Par ailleurs (sons de « cloches » et sons lisses). J’ai attribué chacun des différents sons de cloche à un étage du dôme et chacun des différents sons lisses à l’un des quadrants. À l’approche de la fin de l’œuvre (section C), un nouveau son de type « cloche » est introduit. Ce timbre se voit attribué un nouveau traitement spatial. Le son était attaqué au sol et sa

11

Une table de fonction est utilisée afin de définir, en association à la section instrument, la qualité timbrale (forme de l’onde) du son résultant. L’explication détaillée d’une table de fonction dépassant largement le cadre de ce mémoire, je vous invite à consulter le manuel canonique de Csound pages 2279-2280(Barry Vercoe, MIT Media Lab et al., 2014).

36

résonnance montait jusqu’au sommet du dôme en parcourant l’ensemble des étages de haut-parleurs. Dans la dernière section (D), un dernier son était introduit, soit un son distorsionné et dissonant, de type cluster. La spatialisation de celui-ci était également singulière dans l’œuvre, tournant autour des auditeurs à l’étage inférieur du dôme, soit là où les haut-parleurs étaient les plus près des oreilles des auditeurs.

2.4.3.4 Conclusion

La composition de Par ailleurs a donné lieu à toutes sortes d’explorations de la CAO. D’abord, il m’a fallu apprendre le langage de programmation de Csound, puis devenir suffisamment agile pour pouvoir créer à l’aide de celui-ci. J’ai expérimenté plusieurs aspects de ce langage, à commencer par les nombreux générateurs unitaires et leurs fonctionnements spécifiques. J’ai également approfondi mes connaissances dans le domaine de l’audionumérique. Outre la génération de sons par ordinateur, je me suis affairé à développer un discours mettant de l’avant la spatialisation. Pour ce faire, j’ai appris à utiliser les fonctionnalités de spatialisation de Reaper.

2.4.4 Musique du rocher

Musique du rocher (voir annexe G) est une œuvre sonore qui a été diffusée à

ENGRAMM, dans le complexe Méduse, à Québec, du 13 janvier au 12 février 2017. Conçue pour s’intégrer à une exposition d’arts visuels, cette œuvre ne comporte ni début, ni fin. Commande de l’artiste Samuel Breton, cette œuvre a été réalisée complètement dans

Pure Data et utilise des déclenchements aléatoires d’évènements sonores, de manière à ce

que l’auditeur ne puisse percevoir de forme prédéfinie. Le patch constitué dans Pure Data pour Musique du rocher est disponible à l’annexe H.

Préalablement à la composition de cette œuvre, j’ai rencontré l’artiste Samuel Breton à quelques reprises afin de m’imprégner de son projet d’exposition Saint-Centre,

Sauveur Durocher. Cette exposition comportait plusieurs sérigraphies ainsi que des œuvres

animées alliant photographies, sérigraphies et vidéos d’animation. Chacune de ces œuvres était liée, de près ou de loin, avec le Centre Durocher (ville de Québec, quartier