Faculté des Sciences, 4 Avenue Ibn Battouta B.P. 1014 RP, Rabat – Maroc

Tel +212 (0) 37 77 18 34/35/38, Fax : +212 (0) 37 77 42 61, http://www.fsr.ac.ma

N° d’ordre : 2866

THÈSE DE DOCTORAT

Présentée par

Hanane RAMI

Discipline : Physique

Spécialité : Electronique, Imagerie et Vision

Soutenue le 30 Avril 2016

Devant le jury

Président

Pr. EL AMRAOUI Youssef PES, Faculté des Sciences, Rabat

Examinateurs :

Pr. ELHAJJAJI Abdellah PES, Faculté des Sciences, Tétouan.

Pr. ZAHID Nourddine PES, Faculté des Sciences, Rabat.

Pr. KABOUCHI Bousselham PES, Faculté des Sciences, Rabat.

Pr. MASMOUDI Lhoussaine PES, Faculté des Sciences, Rabat.

Invité

Pr. HAMRI Mohammed PES, Faculté des Sciences, Rabat.

Contribution au développement de descripteurs

LBP pour le suivi d’objet en mouvement

Avant d’entamer ce rapport, je tiens `a t´emoigner ma profonde gratitude `a toutes les personnes qui ont particip´e de pr`es ou de loin `a l’´elaboration de ce travail.

Le travail pr´esent´e dans ce m´emoire a ´et´e effectue au sein du Laboratoire LETS/G´eomat au d´epartement de physique de la facult´e des sciences a Rabat, sous la direction de Mr Lhoussaine MASMOUDI et Mr Mohammed HAMRI.

Mes vifs remerciements `a Mr. Lhoussaine MASMOUDI, Professeur de la Facult´e des Sciences de Rabat et Directeur de cette th`ese, qui a su se montrer attentif et patient durant ces trois ann´ees.

Je remercie chaleureusement Mr. Mohammed HAMRI, Professeur de la Facult´e des Sciences de Rabat, mon ex-encadrant qui m’a donn´e l’opportunit´e de faire ce travail de recherche.

Je tiens ´egalement `a exprimer toute ma gratitude `a Mr. Youssef El AMRAOUI Professeur de la Facult´e des Sciences de Rabat d’avoir accept´e la pr´esidence du jury.

je remercie ´egalement Mr. Abdellah ElHAJJAJI, Professeur de la Facult´e des Sciences de T´etouan, mon honorable rapporteur, de m’avoir consacr´e son temps et ses connais-sances dans l’examen de ma th`ese.

Mes remerciements `a Mr. Bousselham KABOUCHI, Professeur de la Facult´e des Sciences de Rabat, mon respectable rapporteur, pour son aide inestimable et sa contribution dans ce travail.

Je tiens a remercie Mr. Nourddine ZAHID ,Professeur de la Facult´e des Sciences de Rabat, mon honorable examinateur, d’avoir accept´e d’ˆetre parmi les jury .

tretenir de nombreux ´echanges forts constructifs et enrichissants.

Une salutation sp´eciale `a mon coll`ege Rachid ZENNOUHI pour sa disponibilit´e, nos ´

echanges professionnels notamment en mati`ere de programmation furent constructifs et m’ont aid´ee dans ce m´emoire. Mes sinc`eres remerciements `a l’ensemble des personnels du d´epartement de physique, sans oublier tous ceux qui m’ont encourag´ee, soutenue de pr´es ou de loin. Qu’ils trouvent ici le t´emoignage de ma gratitude pour la bienveillance et l’amiti´e dont ils ont constamment fait preuve `a mon ´egard tout au long de ce travail

Je ne pourrai omettre de remercier les personnes les plus importantes dans ma vie, qui n’ont pas h´esit´e `a m’apporter tout le soutient durant toute cette p´eriode, mes chers parents et mes fr`eres. Un grand merci a vous pour votre soutient.

Dans ce travail, nous avons trait´e deux probl`emes : le probl`eme de segmentation par d´etection de contour d’une part, et le probl`eme de suivi d’objet en mouvement dans une s´equence d’image d’autre part,. Ce m´emoire comporte deux volets :

• Le Premier volet, pr´esente une nouvelle m´ethode de d´etection de contour bas´ee sur le filtre de Sobel (SOBEL-PCA). L’approche est r´ealis´ee dans un espace RVB (rouge, vert, bleu), on introduit l’analyse de composante principale (ACP) pour r´eduire le nombre de composante couleur, de telle sorte que, au lieu de travailler sur les trois composantes il nous reste que deux composante couleur. La m´ethode a ´et´e appliqu´ee sur des images synth´etiques et r´eelles.

• Deuxi`eme volet, propose deux approche pour le suivi d’objet en mouvement dans une s´equence d’image.

Premi`ere approche : (LBP-EFF) :

Cette approche est r´ealis´ee en deux ´etapes principales. Dans la premi`ere, nous intro-duisons le facteur d’oubli exponentiel dans le calcul du Motive binaire locale LBP dans une s´equence d’images. Dans la seconde, nous effectuons un algorithme de suivi bas´ee sur le calcul de la mesure de similarit´e entre deux histogrammes, pour cet objectif, nous utilisons trois type de mesure de similarit´e : la m´ethode Zero Mean Normalized Cross-Correlation (ZNCC), Somme Absolute intensit´e Diff´erence (SAD) et Chi-Square `

a distance. Pour l’´evaluation des r´esultats de suivi , nous utilisons l’erreur cumulatives de la distance euclidienne ECED.

Deuxi`eme approche :(CS-LBP-EFF) :

L’objectif de la seconde approche est de proposer une m´ethode de suivi qui fonctionne dans le milieu ext´erieur et aquatique. Cette approche utilise le descripteur Centre-sym´etrique LBP en combinaison avec l’operateur facteur d’oubli exponentiel pour pro-duire un nouveau descripteur CS-LBP-EFF.

Cet derni`ere pr´esente plusieurs avantages tels que la tol´erance aux changements d’´eclairage, la robustesse sur les zones de l’image `a plat, et l’efficacit´e de calcul.

Nos approches LBP-FEP et CS-LBP-EFF donnent de meilleurs r´esultats que celui LBP original et Centre-sym´etrique LBP (CS-LBP). Les approches propos´ees ont ´et´e test´ees sur les images de la s´equence de synth`ese et r´eelles dans les deux milieux ext´erieur et aquatique, et les r´esultats sont satisfaisants.

Mots cl´es : D´etection de contour, S´equence d’image aquatique, Suivi d’objet, CS-LBP, LBP, Exponential Forgetting Factor (EFF), ZNCC. SAD, Chi-Square distance, ACP

In this work, we have dealt two problems : In the one hand, edge detection and in the other hand, we have studied the tracking object in underwater sequence using the LBP texture descriptor. This memory is composed of two parts :

The First part presents a new method of edge detection based on the Sobel filter (SOBEL-PCA).

The approach is performed in a RGB space (red, green, blue), introducing the principal component analysis (PCA) to reduce the number of color component. So that, instead of working on the three components we still have only two color components. The method was applied to synthetic and real images. The goal of the Second part is to propose two approaches for object tracking in image sequence. First approach : (LBP-EFF) : This approach is achieved into two main steps. In the first one, we use the Exponential Forgetting Factor in the calculation of Local Binary Pattern (LBP) to tracking the motif in a sequence of images. In the second one, we perform the algorithm by the pattern selec-ted based on a distance measure to find similarity between two histograms, for this goal we use three types of similarity measures : the Zero Mean Normalized Cross-Correlation method (ZNCC), Sum of Absolute Intensity Difference (SAD) and Chi-Square distance. For evaluation the algorithm tracking results, we use the error cumulative Euclidean distance ECED from the pixel position for each images.

Second approach : (CS-LBP-EFF) :

The aim of the second approach is to propose a fish tracking method that operates in the natural underwater environment. This approach uses the Center-Symmetric LBP descriptor in combination with the exponential forgetting factor operator in order to produce (CS-LBP-EFF).

This new descriptor has several advantages such as tolerance to illumination changes, robustness on flat image areas, and computational efficiency.

Our approaches LBP-EFF and CS-LBP-EFF give best results than the original one LBP and Center-Symmetric LBP (CS-LBP). The proposed approaches have been tested on synthetic and real sequence images and the results are satisfactory.

KEYWORD : edge detector, Underwater, Sequence image, Tracking, CS-LBP des-criptor, Exponential Forgetting Factor (EFF), ZNCC. SAD, Chi-Square distance, PCA

Remerciement. . . i

R´esum´e . . . iii

Abstract . . . iv

Sommaire v Liste des Figures viii Liste des Tableaux x Abbreviations xi Introduction G´en´erale . . . 1

I Segmentation d’image couleur 4 1 LA PERCEPTION VISUELLE 5 1.1 Introduction. . . 5

1.2 Le Syst`eme de la Perception visuelle . . . 7

1.2.1 Syst`eme de vision humaine . . . 7

1.3 Les principaux ph´enom`enes de la vision . . . 9

1.4 Le syst`eme de la vision artificielle . . . 11

1.5 L’imagerie couleur . . . 14

1.6 Repr´esentation de la couleur. . . 15

1.6.1 Syst`emes de primaires . . . 16

1.6.2 Syst`emes luminance-chrominance . . . 18

1.6.2.1 Syst`emes perceptuellement uniformes . . . 19

1.6.2.2 Syst`emes antagonistes . . . 20

1.6.2.3 Autres syst`emes . . . 21

1.6.3 Syst`emes perceptuels. . . 21

1.6.3.1 Syst`emes d’axes ind´ependants . . . 22

1.6.4 Syst`emes hybrides . . . 22

1.6.5 Synth`ese des syst`emes de repr´esentation de la couleur . . . 23

1.7 Conclusion . . . 25

2 Les M´ethodes de Segmentation 26 2.1 Introduction. . . 26

2.2 Strat´egies de segmentation. . . 27

2.2.1 Strat´egies scalaires . . . 27 v

2.2.2 Strat´egies marginale . . . 28

2.2.3 Strat´egie vectorielle . . . 29

2.2.4 Strat´egie hybride . . . 29

2.3 Les approches de Segmentation . . . 30

2.3.1 Les approches contour . . . 30

2.3.2 Approche r´egion . . . 31

2.3.3 La Segmentation g´eom´etrique de l’image. . . 33

2.3.3.1 Approche ascendante ou croissance de r´egion . . . 33

2.3.3.2 Approche structurelle : division-fusion de r´egions . . . 34

2.3.4 La classification pixellaire . . . 36

2.3.4.1 Le M´ethodes clustering . . . 37

2.3.4.2 Les algorithmes de type centres mobiles . . . 38

2.3.4.3 L’algorithme ISODATA . . . 39

2.3.4.4 La classification floue . . . 40

2.3.5 Les approches de classification statistiques. . . 41

2.3.6 La classification par analyse d’histogrammes . . . 41

2.3.6.1 Analyse d’histogrammes multidimensionnels 3D . . . 41

2.3.6.2 Analyse d’histogrammes bidimensionnels 2D. . . 42

2.3.6.3 Analyse d’histogrammes monodimensionnels 1D. . . 42

2.4 M´ethodes mixtes . . . 44

2.4.1 L’association d’approches de type r´egion et de type contour . . . . 45

2.4.2 L’association de la classification couleur et la segmentation g´eom´etrique 46 2.5 Les crit`eres d’´evaluation . . . 47

2.5.1 Evaluation de segmentation en contour´ . . . 47

2.5.1.1 Mesure de Abdou et Pratt . . . 47

2.5.1.2 Mesure de Pelli et Mallah . . . 48

2.5.1.3 Crit`eres de Fram et Deutsch . . . 48

2.5.1.4 Crit`eres de Baker . . . 48

2.5.2 Evaluation de segmentation en r´´ egion . . . 49

2.5.2.1 Evaluation non-supervis´´ ee. . . 49

2.5.2.2 Evaluation supervis´´ ee . . . 50

2.6 Conclusion . . . 51

3 La D´etection de contour par l’approche de PCA 52 3.1 Introduction. . . 52

3.2 Analyse en Composantes Principales (ACP) . . . 53

3.2.1 L’approche d’ACP . . . 54

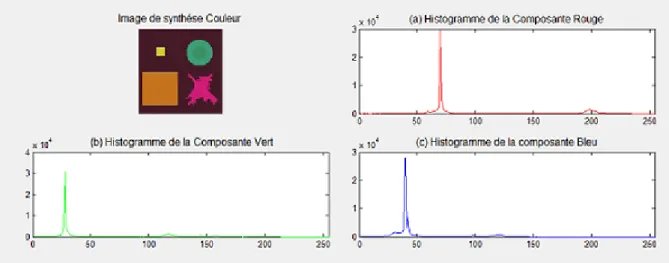

3.2.2 R´esultat exp´erimental . . . 55

3.2.3 Cas d’une image synth´etique . . . 55

3.2.4 Application `a des images r´eelles . . . 57

3.3 Conclusion . . . 59

II Suivi d’objet en mouvement 61 4 Les M´ethodes de Suivi d’Objets en Mouvement 62 4.1 Introduction . . . 62

4.1.1 Les diff´erentes approches de suivi d’objets . . . 63

4.1.1.1 M´ethode par appariement de d´etections . . . 63

4.1.1.2 M´ethode de Segmentation dynamique . . . 65

4.1.1.3 M´ethode de fenˆetre englobante (Imagette) . . . 66

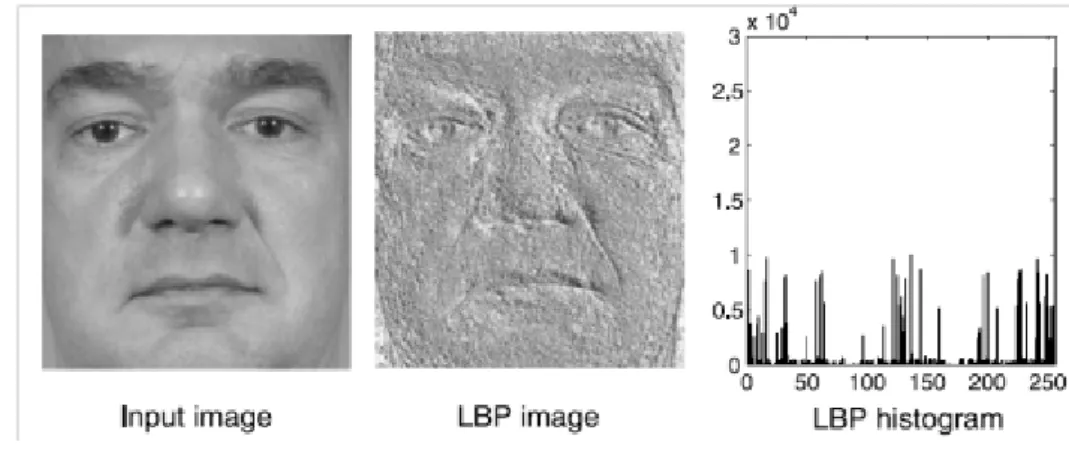

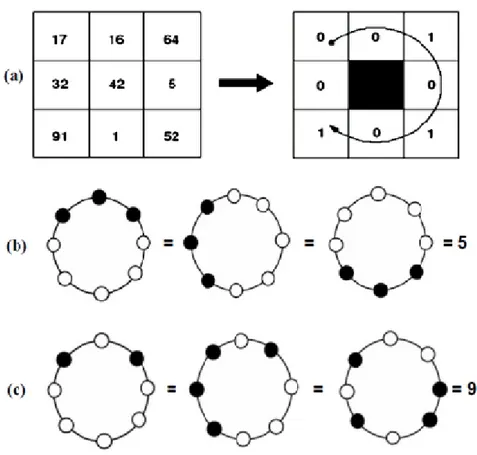

4.1.2 Motifs binaires locaux (Local Binary Pattern) . . . 67

4.1.2.1 Local Binary Pattern LBP basique . . . 68

4.1.3 LBP multi ´echelle . . . 69

4.1.4 LBP invariant par rotation . . . 70

4.1.5 Center-Symmetric LBP . . . 72

4.2 L’approche propos´ee . . . 73

4.2.1 Premier Descripteur LBP-EFF . . . 74

4.2.2 Applications . . . 74

4.2.2.1 L’approche LBP-EFF . . . 75

4.2.2.2 S´equence synth´etique . . . 75

4.2.2.3 S´equence r´eelles . . . 77

4.2.3 Deuxi`eme Descripteur CS-LBP-EFF . . . 78

4.2.3.1 L’approche CSLBP-EFF . . . 79

4.2.3.2 S´equence synth´etique . . . 79

4.2.3.3 S´equence r´eelle . . . 82

4.2.4 Application dans un milieu aquatique . . . 84

4.2.4.1 Filtre homomorphique . . . 84

4.2.4.2 R´esultats exp´erimentaux . . . 87

4.2.5 R´esultat exp´erimental de l’approche LBP-EFF pour la s´equence sous marine . . . 92

4.3 Conclusion . . . 94

Conclusion G´en´erale . . . 96

1.1 Sch´emas de principe de la perception humaine. . . 6

1.2 Principe de la vision artificielle. . . 6

1.3 Coupe Sch´ematique de l’œil . . . 7

1.4 Mosa¨ıque des photor´ecepteurs sur la r´etine . . . 9

1.5 coupe sch´ematique de la r´etine . . . 10

1.6 Sch´emas de principe d’un capteur CCDs . . . 12

1.7 Principe de demosaicing `a partir d’un CFA de bayer . . . 14

1.8 Les familles de syst`emes de repr´esentation de la couleur . . . 24

2.1 Segmentation par strat´egie scalaire.. . . 28

2.2 Segmentation par strat´egie marginale. . . 28

2.3 Segmentation par strat´egie vectorielle. . . 29

2.4 Image de synth`ese originale, Image de synth´ese segment´e. . . 32

2.5 Algorithme de division-fusion. . . 35

2.6 (a) r´egion homog`enes de l’image de synth`ese, (b) Nuages de points-couleur dans l’espace RGB . . . 37

2.7 Histogramme unidimensionnels associ´es `a l’image de synth`ese couleur . . 43

2.8 Illustration de la m´ethode des lignes de partage des eaux. . . 46

3.1 Images de synth`ese, Peppers et Lena . . . 55

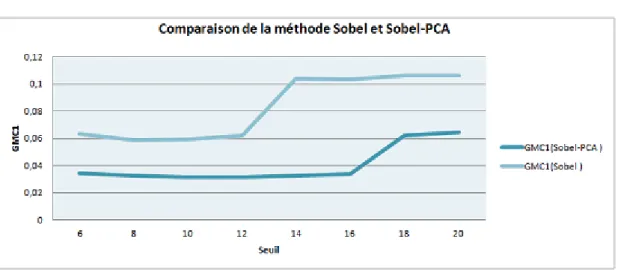

3.2 D´etection de contour par l’operateur de Sobel PCA pour l’image de synth´ese 56 3.3 la mesure de coh´erence pour l’image de synth`ese couleur. . . 56

3.4 D´etection de contour par l’operateur de Sobel PCA pour l’image de Pappers 57 3.5 l’´evaluation de la m´ethode propose pour l’image r´eel Peppers couleur. . . 58

3.6 D´etection de contour par l’operateur de Sobel PCA pour l’image de lena . 58 3.7 L’´evaluation de la m´ethode propose pour l’image r´eel lena couleur . . . . 59

4.1 Repr´esentation d’objet. . . 63

4.2 Construction d’un motif local binaire et calcule du code LBP. . . 68

4.3 Repr´esente un exemple d’image, LBP et l’histogramme de LBP. . . 69

4.4 LBP multi-´echelle. . . 70

4.5 Construction et uniformit´e d’un motif LBP. . . 71

4.6 LBP et CS-LBP descripteur pour 8 pixel voisins. . . 72

4.7 Quelques images extraites de la s´equence d’image d’une ballon . . . 75

4.8 Suivi de ballon dans une s´equence d’image par la m´ethode propos´ee. . . . 75

4.9 R´esultat de la m´ethode LBP et LBP-EFF on utilisant la Square distance comme mesure de similarit´e dans une s´equence synth´etique. . . 76

4.10 Quelques images extraites de la s´equence d’image r´eelle. . . 77 viii

4.11 Suivi du visage sur quelques images de la s´equence par la m´ethode propos´ee. 77

4.12 L’erreur cumulative de la distance euclidienne de la position du pixel central de l’imagette. . . 78

4.13 m´ethode de calcul de CS-LBP et CS-LBP-EFF pour 8 pixels voisins . . . 79

4.14 Suivi de ballon dans une s´equence d’image par la m´ethode propos´ee. . . . 79

4.15 L’erreur cumulative de la distance euclidienne de la position du pixel central de l’imagette. . . 81

4.16 Suivi de visage dans une s´equence d’image par la m´ethode propos´ee. . . . 82

4.17 L’erreur cumulative de la distance euclidienne de la position du pixel central de l’imagette. . . 83

4.18 Proc´edure de calcul de filtre homomorphique. . . 85

4.19 (a) l’image 1 de la 1er s´equence sous marine et son image filtr´ee (b) la 4´eme image de la deuxi`eme s´equence et son image filtr´ee. . . 86

4.20 Les s´equences r´eelles utilis´ees pour notre approche de suivi. . . 87

4.21 s´election d’imagettes dans les s´equences r´eelles utilis´ees pour notre ap-proche de suivi. . . 87

4.22 L’erreur cumulative de la distance euclidienne de la position du pixel central de l’imagette de la premi`ere sequence. . . 89

4.23 L’erreur cumulative de la distance euclidienne de la position du pixel central de l’imagette de la deuxieme sequence. . . 91

4.24 R´esultat de la deuxi`eme s´equence pour la m´ethode LBP-EFF.. . . 93

4.25 L’erreur cumulative de la distance euclidienne de la position du pixel central de l’imagette de la premi`ere sequence .. . . 93

4.26 L’erreur cumulative de la distance euclidienne de la position du pixel central de l’imagette de la deuxi`eme sequence . . . 94

3.1 R´esultat d’´evaluation pour l’image de synth`ese . . . 56

3.2 R´esultat d’´evaluation de notre approche pour l’image de Pappers . . . 57

3.3 R´esultat d’´evaluation de notre approche pour l’image de Lena . . . 59

4.1 Erreur cumulative de la distance euclidienne de la s´equence synth´etique . 76

4.2 Erreur cumulative de la distance euclidienne de la s´equence r´eelle . . . . 77

4.3 L’erreur cumulative de la distance euclidienne des trois m´ethodes pour la s´equence synth´etique . . . 80

4.4 L’erreur cumulative de la distance euclidienne de la position du pixel central de l’imagette . . . 82

4.5 la distance euclidienne des trois m´ethodes pour la premi`ere s´equence r´eelle 88

4.6 La distance euclidienne des trois m´ethodes pour deuxi`eme s´equence r´eelle 90

4.7 R´esultat de la premi`ere s´equence pour la m´ethode LBP-EFF. . . 92

LAH List Abbreviations Here

CIE Commission Internationale de l’ ´Eclairage RGB Rouge, Verte Et Bleu

CGL Corps Genouille Lateral

HSV Teinte , Saturation Et Luminosite CMJ Cyan, Magenta et Jaune

Isodata Iterative Self-Organizing Data Analysis Techniques A PCA Analyse En Composante Principales

1D Un Seul Dimensions 2D Deux Dimensions 3D Trois Dimensions Max Maximale

Min Minimum

GMC1 The first measure of coherence LBP Local Binary Pattern

LBPROT LBP invariant par rotation MBP Motif binaire m´edian CS-LBP Center-Symmetric LBP EFF Exponentiel Forgetting Factor

LBP-EFF Local Binary Patterns- Exponentiel Forgetting Factor CS-LBP-EFF Center-Symmetric LBP- Exponentiel Forgetting Factor

—————————————————————————————-INTRODUCTION G´

EN´

ERALE

De tout temps, l’homme a tent´e d’´elaborer des machines capables de reproduire ou de faciliter son travail soit l’´evolution des techniques et les connaissances dans de nom-breux domaines, comme la m´edecine, la physique, les math´ematiques et plus r´ecemment l’informatique, ont permis d’inventer toutes sortes d’outils, du plus rudimentaire au ro-bot le plus perfectionn´e. Plus particuli`erement, le progr`es de la m´edecine nous a aid´e `

a mieux comprendre le syst`eme visuel humain, et depuis quelques d´ecennies, l’homme cherche `a remplacer par la machine, les m´ecanismes du syst`eme visuel humain, pour des applications aussi vari´ees telle que la robotique, la vid´eo surveillance . . . Cette discipline constitue ce que nous appelons la vision par ordinateur.

Le suivi d’objet dans une s´equences d’images, en vision par ordinateur est, depuis ces derni`eres ann´ees, un th`eme de recherche tr`es actif. Le suivi d’objets s’est r´ev´el´e ˆetre un outil indispensable pour des applications aussi diverses que la compression vid´eo, l’imagerie m´edicale, l’interaction homme machine, et l’analyse de s´equences sportives... Il s’appuie sur des propri´et´es d’invariance des objets d’int´erˆet, cette invariance peut concerner la g´eom´etrie de la sc`ene ou des objets, l’apparence des objets (c’est-`a-dire la photom´etrie ou la couleur) ou encore la cin´ematique (par exemple les contraintes spatio-temporelles).

Le suivi d’objets est un vaste sujet qui englobe un certain nombre de probl´ematiques. On peut notamment citer :

• D´etection d’objets en mouvement : ces objets correspondent g´en´eralement `a des ´ev´enements importants dans la sc`ene.

• Suivi d’objets en mouvement : qui consiste `a localiser `a chaque instant les objets d’int´erˆets dans la sc`ene.

• D´etection de mouvements coh´erents : sert `a d´eterminer les diff´erents mouvements ainsi que leurs distributions dans la sc`ene, ceci permet d’identifier les ´ev´enements inhabituels dans le cas de la vid´eo surveillance par exemple.

• L’estimation du mouvement : a pour but d’estimer, `a partir d’une s´equence d’images, le mouvement apparent des objets composant une sc`ene tridimensionnelle.

• Extraction de couches de mˆeme mouvement : c’est-`a-dire partitionner l’image en r´egions ayant chacune un mouvement diff´erent.

La d´etection et le suivi d’objets en mouvement sont parmi les probl`emes les plus ´etudi´es ces derni`eres ann´ees, Ils sont `a la base de tout syst`eme de vision. C’est pour cette raison que nos travaux de recherche s’articulent autour de ces deux probl`emes.

1. la segmentation des images couleur : L’objectif de cette premi`ere partie est la segmen-tation d’une image couleur dans le sens de la d´etection de mouvement. Nous proposerons un algorithme de d´etection de contours des images couleur bas´ee sur le filtre de Sobel en utilisant l’analyse en composante principales PCA.

2. la deuxi`eme partie sera consacr´ee au probl`eme de suivi d’objets en mouvement dans des s´equences d’images ; elle traitera le probl`eme de suivi d’objet en mouvement `a l’aide de d´eveloppement de deux nouvelles approches inspir´ees des motifs binaires locaux (Lo-cal Binary Patterns, LBP) : Le premier nouveau descripteur, appel´e LBP-EFF. Le deuxi`eme nouveau descripteur, appel´e CSLBP-EFF.

Pour tester l’efficacit´e de notre approche, nous avons utilis´e plusieurs types de s´equence, les s´equences synth´etiques et les s´equences r´eelle o`u les deux nouveaux descripteurs LBP-EFF et CS-LBP-EFF sont compar´e respectivement `a la m´ethode originale LBP et CSLBP. A la fin, nous aborderons le probl`eme des s´equences d’image aquatique, Ce-pendant le traitement et l’analyse des images sous-marines sont des tˆaches relativement complexes (illumination non uniforme L’absorption des couleurs. . . .).

Ces diff´erents ph´enom`enes produisent g´en´eralement des images de faible qualit´e, peu contrast´ees, dont les couleurs ont ´et´e modifi´ees. L’extraction d’´el´ements caract´eristiques est donc d´elicate et ne peut ˆetre r´ealis´ee qu’avec les techniques classiques utilis´ees dans le traitement d’images. Nous avons test´ee les descripteurs propos´ees dans la deuxi`eme partie pour le suivi d’un poisson dans une s´equence d’image sous-marine.

Organisation de th`ese Ce m´emoire est organis´ee en quatre chapitres : Tout d’abord, dans le premier chapitre, nous pr´esentons le contexte g´en´eral d’une chaˆıne d’analyse d’images num´eriques couleur en faisant le parall`ele avec le syst`eme visuel humain. Dans la Deuxi`eme Chapitre, nous ´etudions l’´etat de l’art des m´ethodes de segmentation d’image

couleur, que cela soit de type r´egion ou contours ou mixte.

Une nouvelle technique de segmentation bas´ee sur le filtre de Sobel, et l’analyse en com-posante principale (SOBEL-PCA) propos´ee dans le troisi`eme chapitre.

Finalement, dans le quatri`eme chapitre, nous pr´esentons les diff´erentes m´ethodes de suivi d’objet en mouvement. Nous avons class´e les diff´erentes approches de suivi, leurs avantages et leurs limites, ainsi que l’´elaboration d’une nouvelle approche bas´ee sur deux nouveaux descripteurs LBP-EFF et CSLBP-EFF.

Segmentation d’image couleur

LA PERCEPTION VISUELLE

1.1

Introduction

Toute action de la vision humaine peut sommairement ˆetre divis´ee en trois phases : la perception, la transmission et l’analyse.

L’homme per¸coit son environnement tridimensionnel 3D grˆace `a ses yeux auxquels par-vient un flux lumineux compos´e de photons. Le signal re¸cu comporte ainsi diff´erentes longueurs d’ondes.

Une fois cette information acquise, elle est transform´ee en message nerveux v´ehicul´e via le nerf optique, vers le cerveau, l’analyse est effectu´ee par le cortex c´er´ebral.

Une fois le message est analys´e, l’homme pourrai donc prendre une d´ecision et/ou r´ealise une action tout en s’adaptant a son enivrement.

Le principe de ce processus peut ˆetre sch´ematis´e par la figure 1.1.

Figure 1.1: Sch´emas de principe de la perception humaine (inspir´es de [1])

.

Au niveau de l’œil, le signal lumineux est re¸cu puis transform´e en un signal neuronal interpr´etable directement par le cerveau. Par contre en vision artificielle, la transmission de l’information image n’est pas directe ; il est donc n´ecessaire de la stocker.

La vision artificielle est une branche de l’intelligence artificielle dont le principal but est de permettre `a une machine d’analyser, traiter et comprendre une ou plusieurs images prises par un syst`eme d’acquisition (par exemple : cam´eras, etc.).

Une contribution consiste `a tenter d’imiter la vision humaine ou animale par le truche-ment de composants ´electroniques. Cette mani`ere de proc´eder peut ˆetre per¸cue comme un traitement des donn´ees visuelles par le biais de mod`eles fond´es sur la g´eom´etrie, la physique, la biologie, les statistiques et la th´eorie d’apprentissage.

La vision artificielle a aussi ´et´e d´ecrite comme une initiative dans l’automatisation et l’int´egration d’une vaste gamme de processus et de mod`eles sur la perception visuelle.

L’imagerie couleur se d´ecompose en trois ´etapes. Un capteur optique acquiert tout d’abord des images tout comme le fait l’œil. L’information visuelle ainsi obtenir se ca-ract´erise par une image couleur ou a niveau de gris.

Ces images sont ensuite stock´ees sous forme num´erique pour ˆetre finalement analys´ees et/ou trait´ees en fonction de l’application vis´ee figure 1.2.

Ce chapitre pr´esente les analogies entre la vision humaine et l’imagerie couleur aux trois niveaux : perception/acquisition, transmission/repr´esentation et analyse/traitement

1.2

Le Syst`

eme de la Perception visuelle

Cette partie se propose de pr´esenter les analogies entre l’œil et les syst`emes de vision artificiels.

1.2.1 Syst`eme de vision humaine

L’œil

l’œil est une sph`ere pilotable suivant trois axes de rotation. Les ´el´ements principaux le composant sont, dans le sens de cheminement de l’information image figure 1.3. :

• la scl`ere : pas dans le processus de vision ; c’est l’enveloppe externe de l’œil qui se transforme sur l’avant en une corn´ee quasi-ronde et transparente. Elle est normalement blanche et transparente ;

• la corn´ee : est la couche externe convexe de l’œil. Elle est compos´ee de quatre couches successives. Sa courbure d´epend des individus et varie aussi avec l’ˆage ; • l’humeur aqueuse : est un liquide salin et alcalin sous pression qui maintient la

rigidit´e du globe oculaire ;

• l’iris : est un diaphragme vertical perc´e en son centre par la pupille. Il r´egule la quantit´e de lumi`ere atteignant la r´etine en ajustant la taille et la forme de la pupille ;

• le cristallin : est une lentille transparente plac´ee derri`ere l’iris. Il compl`ete le rˆole de la corn´ee et assure la mise au point de l’image optique , ce ph´enom`ene constitue l’accommodation ;

• Le corps vitr´e : constitue 80% du volume de l’œil et compos´e d’un liquide albu-mineux parfaitement transparent sous forme de gel´ee. Son indice de r´efraction varie suivant la longueur d’onde, ce ph´enom`ene est la cause de l’aberration chromatique. Il diminue aussi l’acuit´e visuelle ;

• La r´etine : constitue une interface entre le flux lumineux et le syst`eme ner-veux dont elle fait partie int´egrante. Elle est constitu´ee de deux types de pho-tor´ecepteurs : les cˆones et les bˆatonnets qui vont transformer l’information photo-nique en stimuli ´electriques ;

• La fov´ea : est la zone centrale de la r´etine qui se trouve au niveau de l’axe optique de l’œil. Elle est essentiellement constitu´ee de cˆones ;

• Le nerf optique : permet le transport de l’information visuelle ´electrique issue de la r´etine vers le cerveau. Au niveau de la connexion r´etine/nerf optique, une zone appel´ee papille ne contient aucun photo-r´ecepteur.

La liste pr´ec´edente met en ´evidence deux structures principales : le syst`eme optique r´ealisant la mise au point de l’image sur la r´etine et l’interface photosensible transfor-mant les signaux lumineux re¸cus en un signal neuronal.

1.3

Les principaux ph´

enom`

enes de la vision

L’accommodation est la facult´e d’adapter l’œil en fonction de la distance aux objets observ´es. C’est l’´equivalent du syst`eme de mise au point pour un syst`eme imageur arti-ficiel.

Celle-ci est r´ealis´ee tout d’abord par la corn´ee qui assure les deux tiers de la convergence des rayons lumineux. De par sa facult´e de d´eformation, le cristallin complet ensuite la mise au point de l’image projet´ee sur la r´etine.

Les maladies courantes des yeux telles que l’hyperm´etropie, la myopie et la presbytie sont des troubles issus du dysfonctionnement de l’accommodation. La presbytie vient en particulier d’une diminution de l’amplitude de d´eformation du cristallin.

Figure 1.4: Mosa¨ıque des photor´ecepteurs sur la r´etine [31] a) La fov´ea : arrangement r´egulier et serr´e de cˆones. b) La p´eriph´erie : la taille des cˆones augmente et des bˆatonnets plus petits s’ins`erent entre eux. c) Arrangement al´eatoire des cˆones au niveau de la fov´ea.

L’adaptation `a la lumi`ere : La luminosit´e de notre environnement varie fortement (nuit noire, soleil). L’œil doit donc ˆetre capable de capter les photons dans l’obscurit´e mais aussi de se prot´eger d’une lumi`ere trop vive. Il dispose de plusieurs syst`emes pour s’adapter aux variations d’ambiante.

Ce ph´enom`ene est visible, par exemple, lors d’un passage d’une pi`ece fortement ´eclair´ee `

a une pi`ece sombre ou l’inverse. Dans les deux cas, il faut quelques secondes pour que la vision se stabilise. Pour cela, trois syst`emes entrent en jeu :

• la r´egulation de la quantit´e de lumi`ere : atteignant la r´etine est r´ealis´ee grˆace `

a l’iris. Il est capable de modifier la forme et la taille de la pupille pour laisser passer plus ou moins de lumi`ere tout comme le fait l’ouverture du diaphragme d’un objectif photographique. Ce ph´enom`ene tr`es rapide n’est cependant que temporaire et permet aux autres dispositifs plus lents de se mettre en place ;

• le pigment visuel : est compos´e de rhodopsine pour les bˆatonnets et d’iodopsine pour les cˆones ; il a pour charge d’absorber les photons et d’exciter les cellules visuelles. Ces mol´ecules poss`edent, de plus, la propri´et´e de blanchir avec l’intensit´e lumineuse et ainsi de r´eduire leur pouvoir absorbant.

• le traitement neural des informations : est encore mal compris. Cependant, il semble que les neurones en contact avec les cellules r´etiniennes jouent ´egalement un rˆole dans leur contrˆole du gain.

Figure 1.5: coupe sch´ematique de la r´etine

L’acuit´e visuelle : L’acuit´e est le pouvoir de r´esolution, c’est-`a-dire la limite de taille des objets d´ecelables.

G´en´eralement, l’acuit´e minimum de l’œil est d’une minute d’arc ce qui correspond `a un point d’une imprimante 300 ppp vu `a une distance de 30 cm (cela d´epend aussi du contraste).

Pour cela, l’image projet´ee sur la r´etine par le syst`eme optique doit ˆetre de bonne qualit´e. Les d´efauts optiques r´eduisent donc la pr´ecision de la vision. Un autre facteur jouant sur l’acuit´e visuelle est intrins`eque `a la r´etine. Ainsi, elle compte globalement une centaine de millions de photor´ecepteurs mais le nerf optique n’est compos´e que d’un million de fibres. L’information est donc compress´ee avec pertes.

La sensibilit´e `a la lumi`ere :La sensibilit´e absolue est l’aptitude `a d´etecter de faibles quantit´es de lumi`ere. Celle de l’œil est li´ee `a la probabilit´e pour un photon d’ˆetre ab-sorb´e. ´Etant de taille plus importante que les cˆones et sensible sur une bande plus large

du spectre, les bˆatonnets offrent une meilleure sensibilit´e `a la lumi`ere. Seuls quelques photons suffisent `a provoquer une sensation,[27].

La sensibilit´e diff´erentielle quant `a elle correspond `a l’´ecart de luminance juste discer-nable ; c’est le contraste minimum visible `a une luminance donn´ee. Cette caract´eristique est aussi fonction de la longueur d’onde.

La vision des couleurs : La vision des couleurs se rapporte `a la capacit´e `a diff´erentier les longueurs d’ondes du spectre du flux lumineux arrivant `a l’œil. Il faut tout de mˆeme faire attention `a ne pas confondre la couleur physique port´ee par la lumi`ere et la percep-tion qui en est faite. L’homme est trichromate mais de nombreux ˆetres vivants ne sont que monochromates ou dichromates car ne disposant respectivement que d’un ou deux types de cˆones.

En 1802, Young avan¸cait (suivi par Helmholtz) l’id´ee que l’œil est compos´e de trois types de cellules de sensibilit´es spectrales diff´erentes (rouge, vert et bleu) [2,3]. Les premi`eres critiques `a cette approche furent ´emises en 1878 par Henring qui proposait plutˆot que l’homme est sensible aux diff´erences de couleurs [4]. Ainsi, les couleurs seraient per¸cues via les oppositions noir/blanc, rouge/vert et bleu/jaune.

En fait, de r´ecentes ´etudes men´ees par Padgham et Saunders montrent que les deux th´eories sont pr´esentes [5]. Les trois types de cˆones sont bien sensibles `a des longueurs d’ondes diff´erentes, et donc `a des couleurs diff´erentes, mais l’information sur les couleurs antagonistes serait aussi transmise au cerveau. Cette derni`ere est calcul´ee au niveau de la r´etine par les cellules horizontales par un simple agencement d’inversions et de som-mations des signaux issus des cˆones.

Globalement, l’apparence color´ee ne r´esulte pas d’une transcription brute des signaux lumineux mais plutˆot d’une manipulation des signaux re¸cus par les photor´ecepteurs au niveau de la r´etine puis de leur interpr´etation par le cerveau. La couleur est donc finalement une vue de l’esprit !

1.4

Le syst`

eme de la vision artificielle

Bien ´evidemment, des solutions artificielles ont ´et´e mises en place pour imiter l’œil et en particulier pour permettre la capture d’images.

Le but principal de tels dispositifs est la restitution de la prise de vue effectu´ee dans le but de recr´eer le mˆeme stimulus visuel lors de sa restitution. La visualisation la plus

fid`ele possible de l’image capt´ee est ainsi recherch´ee.

Tout comme pour l’œil, la premi`ere partie d’un imageur artificiel est compos´ee d’un syst`eme optique permettant de focaliser les rayons lumineux sur une zone photosensible. Dans le cadre d’un appareil photographique, cela correspond `a l’objectif. Ce dispositif peut ˆetre plus ou moins complexe. Un syst`eme de diaphragme jouant le rˆole de l’iris est g´en´eralement pr´esent (obturateur).

Il permet de laisser passer plus ou moins de lumi`ere. De plus, la focalisation des rayons est r´ealis´ee par un ensemble de lentilles et de miroirs plus ou moins complexe suivant la qualit´e du syst`eme optique.

La mise au point est r´ealis´ee quand le flux lumineux est focalis´e de mani`ere `a obtenir une image nette sur la zone photosensible. C’est un syst`eme d’accommodation artificiel. Dans certaines cam´eras num´eriques, des prismes dichro¨ıques peuvent aussi ˆetre uti-lis´es pour s´eparer le flux lumineux et l’amener vers plusieurs capteurs ind´ependants am´eliorant de cette mani`ere le pouvoir de r´esolution, figure 1.6. La qualit´e de l’image en est donc am´elior´ee une fois r´esolus les probl`emes li´es au recalage des diff´erentes images.

Figure 1.6: Sch´emas de principe d’un capteur CCDs

D`es que la lumi`ere arrive sur la zone photosensible, elle est transform´ee en une infor-mation exploitable pour la restitution. Sur les films argentiques des appareils photogra-phiques, la sensibilit´e aux radiations des cristaux d’halog´enures d’argent (combinaison de l’argent avec un halog`ene) permet la capture de l’information lumineuse.

Le d´eveloppement du film r´ev`ele ensuite les zones expos´ees `a la lumi`ere. Les syst`emes num´eriques sont form´es quant `a eux par un ensemble de composants ´electroniques pho-tosensibles qui transforment la lumi`ere en une excitation ´electrique fonction de l’´energie re¸cue.

Les plus utilis´es sont les CCDs (Charged Coupled Device) qui sont essentiellement achro-matiques. Pour produire une image couleur, des filtres couleurs sont plac´es au dessus des capteurs (figure 1.7) : l’ensemble forme un CFA (Color Filter Array).

Le plus r´epandu des CFAs est le mod`ele GRGB de Bayer, mais des arrangements bas´es sur CYGM (Cyan, Yellow, Green, Magenta) sont aussi utilis´es. Sony a ´egalement pro-pos´e derni`erement un arrangement RGBE, avec E pour Emerald. D’apr`es Sony, l’ajout de l’Emerald permettrait de se rapprocher plus du syst`eme de perception humaine et de r´eduire les erreurs de reproduction des couleurs.

La sortie de la matrice de CCDs est alors compos´ee d’un sous-´echantillonnage des diff´erentes composantes chromatiques.

Un post-traitement des donn´ees, le demosaicing, est ensuite n´ecessaire pour obtenir l’image finale (figure 1.7).

Les imageurs classiques utilisent des filtres sensibles aux fr´equences du visible mais il est possible d’en employer d’autres pour cr´eer des images de rayonnements non visibles (radar, infrarouge...).

La restitution du signal re¸cu est alors r´ealis´ee en fausses couleurs.

Une fois les signaux lumineux capt´es, leur restitution est un probl`eme complexe. Com-ment interpr´eter les donn´ees acquises ? En argentique, l’exposition plus ou moins longue du film au r´ev´elateur ne donnera pas du tout le mˆeme rendu visuel.

En num´erique, les signaux ´electriques ´emis par les capteurs doivent ˆetre interpr´et´es en terme de couleur en tenant compte de la r´eponse spectrale des diff´erents filtres.

Ce probl`eme est tr`es complexe car il fait intervenir un grand nombre de param`etres. Ainsi, le rendu visuel (en consid´erant un syst`eme de visualisation parfait) des syst`emes imageurs artificiels est tr`es souvent imparfait et fortement variable.

Les syst`emes analogiques fournissent en sortie une image papier (photographie...) contrai-rement aux syst`emes num´eriques qui stockent les images sous forme informatique. De nombreux formats de codage des images sont utilis´es pour compresser plus ou moins le volume d’informations. Pour l’analyse d’images, c’est plutˆot la mani`ere de repr´esenter une couleur qui est importante.

Figure 1.7: principe de demosaicing `a partir d’un CFA de bayer a) Arrangement des diff´erentes couleurs de filtres sur le CFA de bayer b) Arrangement des diff´erentes couleurs de filtres sur le nouveau CFA de Sony

c),d) et e) ; Canaux rouge, vert et bleu issu du CCD avec un CFA de Bayer f) l’image brute en sortie de la matrice de CCDs (m´elange des trois canaux)

g) l’image obtenue apr`es demosaicing.

1.5

L’imagerie couleur

L’utilisation de la couleur en vision par ordinateur est une id´ee naturelle. Notre propre perception visuelle est color´ee et a ´et´e ´etudi´ee en tant que telle depuis tr`es longtemps, ce qui a permis de d´egager les lois colorim´etriques.

La couleur a ´et´e employ´ee en vision par ordinateur assez tˆot, les premi`eres approches ´

etant issues de la colorim´etrie. La disponibilit´e de cam´eras couleur, et surtout la r´ecente formalisation des probl`emes de r´eflectance ont donn´e un vif regain d’int´erˆet `a la re-cherche sur la couleur en vision par ordinateur.

Il existe aujourd’hui de nombreuses techniques de codage de l’information couleur. Le but de cette section est de les pr´esenter rapidement en faisant ressortir leurs domaines d’applications et leurs caract´eristiques.

L’œil dispose de trois types de r´ecepteurs chromatiques. De plus, les diverses exp´eriences men´ees sur l’appariement de couleurs ont permis de d´emontrer le principe de tri variance visuelle de la couleur.

L’id´ee de ces ´etudes est de r´ealiser le m´elange pond´er´e de diverses sources lumineuses pour produire une couleur `a ´egaliser, tout comme le ferait un peintre `a partir d’un en-semble de tubes de couleur pour obtenir une teinte particuli`ere.

De cette mani`ere, il a ´et´e montr´e que toute couleur peut ˆetre obtenue par combinai-son lin´eaire de 3 couleurs dites primaires. Plusieurs combinaisons diff´erentes peuvent d’ailleurs amener `a la mˆeme perception color´ee : les couleurs sont alors dites metam`eres. Par cons´equent, il apparaˆıt naturel de coder la couleur avec trois composantes num´eriques. Nous pr´esenterons donc bri`evement, les espaces couleurs les plus fr´equemment utilis´es en commen¸cant par ceux utilis´es en acquisition et en restitution d’images. Nous expo-serons ensuite les espaces standards d´efinit par la CIE (Commission Internationale de l’ ´Eclairage) pour tenter d’uniformiser les espaces couleurs utilis´es.

Enfin, nous verrons l’int´erˆet d’utiliser des espaces perceptuellement uniformes ou fond´es sur le syst`eme visuel humain pour le traitement d’images.

Ne voulant pas alourdir ce manuscrit et ´etant peu utiles `a sa suite, nous ne rentrerons pas ici dans les d´etails des diff´erents espaces colorim´etriques mais exposerons plutˆot leurs diff´erentes caract´eristiques. Pour de plus amples informations, vous pourrez vous reporter `a la th`ese de Nicolas Vandenbroucke[1],ou bien le livre d’ Alain Tr´emeau,[6].

1.6

Repr´

esentation de la couleur

De nombreux travaux portent sur le processus de formation des couleurs et le syst`eme de perception des couleurs de la vision humaine, [7–11], mais, ici, seuls les syst`emes de repr´esentations de la couleur seront abord´ees. Les termes utilises sont :

• La luminance : Il s’agit de la notion d’´emettre plus ou moins de lumi`ere. • La teinte : Elle correspond `a une couleur, une longueur d’onde dominante. • La saturation : Elle indique le niveau de coloration d’une teinte, la puret´e de la

couleur.

La teinte et la saturation d´efinissent la chrominance d’une couleur. Un syst`eme de repr´esentations de la couleur est un syst`eme de coordonn´ees qui permet de repr´esenter la couleur.

trois composantes par analogie au syst`eme visuel humain qui comporte trois cˆones diff´erents, r´eceptifs `a trois longueurs d’ondes diff´erentes. Une couleur est repr´esent´ee par les valeurs de ces trois composantes. Comme dans la th`ese de Nicolas Vandenbroucke [1], cinq cat´egories de syst`emes peuvent ˆetre distingu´ees :

• Les syst`emes de primaires ;

• Les syst`emes luminance-chrominance ; • Les syst`emes perceptuels ;

• Les syst`emes d’axes ind´ependants ; • Les syst`emes hybrides.

Les quatre premi`eres cat´egories sont class´ees dans les syst`emes classiques, par opposition aux syst`emes hybrides. Nous allons pr´esenter les syst`emes les plus couramment utilis´es pour chaque cat´egorie.

1.6.1 Syst`emes de primaires

Ces syst`emes s’appuient sur l’utilisation de trois couleurs fondamentales (les primaires). Ils se diff´erencient par le choix des primaires et du blanc de r´ef´erence (codage du blanc). Le syst`eme le plus courant est RGB (Red Green Blue), introduit par la CIE. Les compo-santes couleurs de ce syst`eme sont d´efinies par R ∈ [Rmin; Rmax] ,G ∈ [Gmin; Gmax], B ∈ [Bmin; Bmax].

Pour mod´eliser certaines couleurs du domaine visible, la composante R doit parfois ˆetre n´egative, [9], or, g´en´eralement, les intervalles de variation sont R ∈ [0; 255], G ∈ [0; 255] et B ∈ [0; 255] . Ce qui signifie que certaines couleurs ne peuvent pas ˆetre mod´elis´ees. Il y a autant de syst`emes RGB que de blancs de r´ef´erence, [1,12].

les travaux des r´ef´erences [14–16] proposent un autres syst`emes XYZ. Ce syst`eme a ´et´e propos´e pour prendre en compte le probl`eme des valeurs n´egatives de la composante R du syst`eme RGB. Chaque composante de ce syst`eme est une combinaison lin´eaire des composantes RGB.

Pour chaque syst`eme RGB, une matrice de passage a donc ´et´e d´efinie pour passer des coordonn´ees R, G et B aux coordonn´ees X, Y et Z, [1].

Ce syst`eme est rarement utilis´e directement car il sert plutˆot de syst`eme de transition pour passer d’un syst`eme RGB vers un autre syst`eme.

La transformation la plus couramment employ´ee, [1,6] : x y z = 0.607 0.174 0.200 0.299 0.587 0.114 0.000 0.066 1.116 R G B (1.1)

Lorsque les intervalles de variation du syst`eme RGB sont R ∈ [0; 255], G ∈ [0; 255] et B ∈ [0; 255], les intervalles de variation des composantes XYZ sont X ∈ [0; 250.16],Y ∈ [0; 255] et Z ∈ [0; 301.41 ].

Dans la suite de ce rapport, nous consid´erons toujours ces intervalles de variation pour les composantes RGB.

Les trois composantes de ces syst`emes sont li´ees `a la luminance. Or, deux couleurs peuvent avoir le mˆeme caract`ere chromatique avec des luminances diff´erentes. Pour ne tenir compte que de la chrominance, les coordonn´ees peuvent ˆetre normalis´ees de la fa¸con suivante, [1,17] : r = R R + G + B , g = G R + G + B et b = B R + G + B. (1.2) x = X X + Y + Z , y = Y X + Y + Z et z = Z X + Y + Z (1.3) Cette normalisation permet d’obtenir des coordonn´ees comprises entre 0 et 1 et comme x + y + z = 1 , la couleur peut ˆetre repr´esent´ee dans un plan.

Ces nouvelles coordonn´ees sont ind´ependantes des variations scalaires de la luminance de la couleur ´etudi´ee. En effet, si chaque composante R, G et B est multipli´ee par le mˆeme scalaire, alors les valeurs de r, g et b ne changent pas.

L’inconv´enient de cette normalisation est qu’elle n’est pas d´efinie pour R = G = B = 0. Quand on se trouve dans ce cas particulier, une solution est de prendre r = g = b = 13 , [17].

s’appuie sur une synth`ese soustractive est utilis´e pour la t´el´evision et les imprimantes. Une quatri`eme composante peut ˆetre ajout´ee (composante ( noire )).

La transformation suivante peut ˆetre utilis´ee, [12] : C M Y = 0 1 1 1 0 1 1 1 0 R G B (1.4)

Les intervalles de variation sont C ∈ [0; 510], M ∈ [0; 510] et Y ∈ [0; 510]. Un des inconv´enients d’un syst`eme de synth`ese additive est qu’il ne permet pas de mod´eliser certaines couleurs (certaines nuances de vert s’obtiennent en ajoutant des lumi`eres bleues et vertes et en retranchant du rouge, [9] or les couleurs sont repr´esent´ees avec des valeurs positives).

Dans de nombreuses applications en imagerie, comme l’affichage, l’impression, la restau-ration d’images, etc..., il est souhaitable que les propri´et´es d’un syst`eme de repr´esentations de la couleur se rapprochent le plus possible de celles de la vision humaine.

Si nous notons D, la distance qui s´epare deux couleurs dans un syst`eme donn´e et si nous appelons diff´erence, la diff´erence entre deux couleurs per¸cue par l’œil humain, un syst`eme qui se rapproche d’un syst`eme visuel humain doit poss´eder la propri´et´e appel´ee (P) :

∀C1; C2; C3, trois couleurs telles que la diff´erence de couleur per¸cue entre C1 et C3 est

la mˆeme que celle per¸cue entre C2 et C3 alors D(C1; C3) = D(C2; C3).

Tous ces syst`emes de primaires ne poss`edent pas de distance D qui v´erifie la propri´et´e (P) et constituent donc une approche limit´ee pour ces applications. C’est pourquoi d’autres syst`emes poss´edant cette propri´et´e (P) ont ´et´e propos´es, comme les syst`emes luminance-chrominance.

1.6.2 Syst`emes luminance-chrominance

Parmi les syst`emes luminance-chrominance, quatre types sont diff´erenci´es :

• Les syst`emes perceptuellement uniformes (une distance D v´erifiant (P) peut leur ˆetre associ´ee) ;

• les syst`emes de t´el´evision que nous ne d´etaillerons pas ici puisqu’ils sont parti-culi`erement d´edi´es `a la t´el´evision et sont largement abord´ees dans la r´ef´erence [1] ;

• Les syst`emes antagonistes ; • Les autres syst`emes.

Tous ces syst`emes poss`edent une composante de luminance et deux composantes de chrominance.

1.6.2.1 Syst`emes perceptuellement uniformes

Parmi les syst`emes perceptuellement uniformes, deux syst`emes sont propos´ees par la CIE : CIELUV not´ee aussi L*u*v* et CIELAB not´e aussi L*a*b*, [12]. Ces deux syst`emes se d´eduisent de XY Z par les transformations suivantes :

L∗= 116(Y bY )13 − 16, siY Y b > 0.01 903.3Y bY0, sinon (1.5) u∗= 13L∗(u0− ub0) avec u0 = 4X X + 15Y + 3Z (1.6) v∗= 13L∗(v0− vb0) avec v0 = 4X X + 15Y + 3Z (1.7) a∗ = 500(f (X Xb ) − f (Y Yb )) (1.8) b∗= 200(f (Y Yb ) − f (Z Zb )) (1.9) avec f (x) = (x)13, si x > 0.008856 7.787x + 11616, sinon

Les termes Xb , Yb, Zb, ub0 et vb0 sont `a associer au blanc de r´ef´erence.

Dans les images que nous utilisons dans ce rapport, le blanc de r´ef´erence est cod´e (255 255 255)T, en RGB.

Zw = 301.41 .

Les intervalles de variation sont donc :L∗ ∈ [0; 100] , u∗ ∈ [−131 : 95; 220 : 8] ,v∗ ∈

[−139.05; 121.47] , a∗ ∈ [−137.72; 96.14] et B∗∈ [−99.23; 115.65] .

1.6.2.2 Syst`emes antagonistes

Les syst`emes antagonistes de Faugeras [18] ont pour but de repr´esenter le mieux possible la perception visuelle humaine.

En s’appuyant sur des ´etudes physiologiques montrant que l’activit´e ou la r´eponse des cˆones r´ecepteurs de la r´etine humaine, notes LMS (Long Medium Short) est propor-tionnelle non pas `a l’intensit´e du stimulus mais `a son logarithme, Faugeras utilise le logarithme des trois signaux L, M et S.

Un syst`eme semblable s’appuyant sur le syst`eme RGB a aussi ´et´e propos´ee par Garbay et al.[28] :

A = 1

3(log(R) + log(G) + log(B)) (1.10) C1 = √ 3 2 (log(R) − log(G)) et (1.11) C2 = log(B) − (log(R) + log(G) 2 ) (1.12)

Les intervalles de variation sont donc A ∈ [0; log(255)], C1 ∈ [−

√ 3 2 log(255); √ 3 2 log(255)] et C2 ∈ [−log(255); log(255)].

Mˆeme si la mod´elisation du non lin´earit´e de la r´eponse des cˆones de la r´etine humaine n’est pas conserv´ee, g´en´eralement, le syst`eme de Swain et Ballard [19]est pr´ef´er´e car il n’utilise pas le logarithme :

A = R + G + B 3 (1.13) C1 = √ 3 2 (R − G) et (1.14) C2 = B − R + G 2 (1.15)

Les intervalles de variations sont donc : A ∈ [0; 255], C1 ∈ [− √ 3 2 255; √ 3 2 255] et C2 ∈ [255; 255].

1.6.2.3 Autres syst`emes

Enfin, d’autres syst`emes semblables ont ´et´e propos´es par Simonetto et Soadane [20], ou Carron [8]. Nous pr´esentons le syst`eme le plus couramment utilis´e, celui de Carron :

Y = (R + G + B) 3 , (1.16) Ch1= R − (G + B) 2 et (1.17) Ch2 = √ 3 2 (B − G). (1.18) Ainsi, les intervalles de variation sont

Y ∈ [0; 255], Ch1 ∈ [−255; 255] et Ch2 ∈ [− √ 3 2 255; √ 3 2 255].

1.6.3 Syst`emes perceptuels

Les syst`emes perceptuels distinguent trois grandeurs : la luminance, la teinte et la satu-ration. Ils sont notes HSI (Hue Saturation Intensity).

De nombreuses propositions ayant ´et´e faites pour le calcul de ces trois composantes, [1,21], nous ne pr´esentons que les ´equations les plus utilis´ees :

H = π, si R = B = G arcos 1 2((R−G)+(R−B)) √ ((R−G))2+(R−B)(G−B)), si B ≤ G 2π − arcos 1 2((R−G)+(R−B)) √ ((R−G))2+(R−B)(G−B)), sinon (1.19) S = 0, si R = B = G 1 −3min(R.G.B)R+G+B ), sinon (1.20) I = R + G + B 3 (1.21)

1.6.3.1 Syst`emes d’axes ind´ependants

Dans les syst`emes de primaires, les trois composantes sont fortement corr´el´ees car elles poss`edent toutes une information commune qui est la luminance.

Des syst`emes d’axes ind´ependants ont ´et´e propos´es. Ils s’appuient sur l’utilisation de l’analyse en composantes principales qui permet d’obtenir des composantes d´ecorr´el´ees. Les deux syst`emes les plus utilis´es sont :

I1= R + G + B 3 , (1.22) I2 = R − B 2 et (1.23) I3= 2G − R − B 4 , (1.24) avec I1 ∈ [0; 255],I2 ∈ [−2552 ;2552 ] et I3 ∈ [−2552 ;2552 ].

Ce syst`eme est fond´e sur une approximation de la transformation de Karhunen-Loeve, [23–25], o`u I1 est la composante la plus discriminante.

• Le syst`eme H1H2H3 de Braquelaire et Brun [26] dont les composantes sont d´efinies par : H1 = R + G, (1.25) H2 = R − G et (1.26) H3 = B − R + G 2 , (1.27)

o`u H1 ∈ [0; 510], H2 ∈ [−255; 255] et H3 ∈ [−255; 255]. Levine [7] montre que les trois directions privil´egi´ees par la vision humaine sont les directions : rouge-vert, bleu-jaune et blanc-noir. Ce syst`eme met en ´evidence ces trois directions privil´egi´ees.

1.6.4 Syst`emes hybrides

L’approche hybride de Vandenbroucke[1] consiste `a choisir, pour un ensemble d’images donn´ees, parmi toutes les composantes couleurs de tous les syst`emes de repr´esentations de la couleur, les trois composantes les plus pertinentes pour une application donn´ee, en utilisant une technique d’apprentissage supervis´e. Ces trois composantes forment le

syst`eme hybride.

Ce syst`eme est largement utilis´e dans des applications qui sont caract´eris´ee par des sc`enes dynamiques. Il s’adapte mieux `a l’analyse de ce type d’images.

En se basant sur l’approche de Vandenbroucke ,nous avons d´evelopp´e un algorithme pour d´eterminer l’espace hybride par la m´ethode Support a Vecteur machine SVM [30].

1.6.5 Synth`ese des syst`emes de repr´esentation de la couleur

Parmi les syst`emes qui viennent d’ˆetre bri`evement pr´esent´es, nous avons test´e les dix sui-vants : RGB, XY Z, CMY, L*u*v*, L*a*b*, AC1C2, YCh1Ch2, HSI, I1I2I3 et H1H2H3. Ce sont les plus repr´esentatifs et les plus utilis´es en traitement d’images.

La remarque qui peut ˆetre faite est la suivante : les mod`eles luminance-chrominance L*a*b* et L*u*v*, et le mod`ele perceptuel HSI se rapprochent le plus de la vision hu-maine mais il reste `a d´eterminer si cela a une influence sur les r´esultats obtenus au niveau de la mise en correspondance. De plus, le passage vers ces mod`eles est coˆuteux en temps de calcul.

Sur la figure 1.8, nous proposons des regroupements en 4 familles telles que nous les avons pr´esent´ees dans ce premier chapitre :

• Les syst`emes de primaires

• Les syst`emes luminance-chrominance • Les syst`emes perceptuels

Figure 1.8: Les familles de syst`emes de repr´esentation de la couleur[1].

Les rectangles gris´es correspondent `a ces quatre familles et les fl`eches indiquent les trans-formations qui ont ´et´e pr´esent´ees. Chacun des syst`emes pr´esent´es est reli´e par ces fl`eches directement ou indirectement au syst`eme d’acquisition de l’image (R, G, B).

Nous distinguons, au sein de chaque famille, des sous-familles qui sont repr´esent´ees par des rectangles aux contours discontinus.

A chaque syst`eme de repr´esentation de la couleur correspond un espace tridimensionnel couleur, dans lequel un stimulus de couleur est repr´esent´e par un point-couleur.

Ces diff´erents syst`emes sont utilis´es pour repr´esenter les couleurs des ´el´ements de surface des objets projet´es sur les pixels d’une image num´erique couleur.

Nous venons de pr´esenter un certain nombre de syst`emes de repr´esentation de la couleur, chacun ayant des propri´et´es particuli`eres. Il faut savoir que cette liste est loin d’ˆetre exhaustive car il existe de nombreux autres syst`emes parfois sp´ecifiques `a une application particuli`ere.

Actuellement, la CIE travaille sur un mod`ele d’apparence color´ee (CIECAM97s) qui tente de prendre en compte les divers m´ecanismes visuels jouant un rˆole sur la perception humaine de la couleur (CIE98).

Ce mod`ele empirique permet d’exprimer la couleur d’un objet observ´e en tenant compte de son voisinage.

Dans le domaine du traitement d’images couleur, l’utilisation future de ce mod`ele se traduit par la prise en compte de la couleur et de la taille des r´egions adjacentes `a une r´egion de l’image, ce qui pourrait apporter de nombreux changements dans les algorithmes de traitement.

La CIE envisage ´egalement de proposer un syst`eme (L, M, S) fond´e sur les signaux issus des trois familles de cˆones pr´esents dans la r´etine de l’œil humain.

Cette multitude de syst`emes de repr´esentation de la couleur rend difficile le choix du syst`eme de repr´esentation le mieux adapt´e `a un probl`eme donn´e.

1.7

Conclusion

Ce chapitre pr´esente les principaux ´el´ements qui composent le syst`eme de la vision hu-maine et les diverses analogies avec le syst`eme de vision artificielle.

Il introduit aussi les diff´erentes espaces de couleur permettant la repr´esentation de l’infor-mation image acquise par le syst`eme artificielle. Tout en mettant l’accent sur le syst`eme hybride, qui s’adopte pour le d´eveloppement d’un algorithme de segmentation bas´ee sur l’approche contour.

Les M´

ethodes de Segmentation

2.1

Introduction

La plus part des probl`emes d’analyse d’image peuvent ˆetre r´esolus en deux ´etapes : La premi`ere ´etape consiste `a pr´etraiter l’image ou bien simplifier l’image pour essayer de ne garder que les informations utiles `a l’analyse. L’utilisation des filtres permet d’´eliminer les effets ind´esirables et de purifier l’image, afin de r´eduire le bruit et renforcer des contrastes. La deuxi`eme ´etape, appel´e segmentation, cette derni`ere consiste `a extraire, `

a partir d’une image num´erique, les informations pertinentes en regard de l’application concern´ee.

Ces informations sont nomm´ees, en vision par ordinateur, indice visuel ou primitive g´eom´etrique caract´eristique de l’image, tel que des contours, des droites, des coins, des r´egions, `a savoir un regroupement de pixels connexes et proches au sens d’un crit`ere. La primitive g´eom´etrique constitue une information cl´e sur l’image, tout en r´eduisant l’importante masse de donn´ees que repr´esentent les valeurs d’intensit´e des pixels. De ce fait, elles sont `a la base de traitements plus ´evolu´es, tels que la reconnaissance d’objet ou bien encore l’asservissement visuel, du recalage, de la mise en correspondance, de la compression, . . . [12].

La segmentation est l’op´eration qui transforme l’image en contours ou en zones de r´egions homog`enes ; tous les pixels d’une mˆeme r´egion ´etant affect´es d’une mˆeme ´etiquette. Ce chapitre se focalise sur les m´ethodes de segmentation d’image couleur.

De nombreuses m´ethodes ont ´et´e d´evelopp´ee et utilis´ee dans la litt´erature [138]. Le choix de la m´ethode de segmentation et le succ`es de son utilisation d´epend beaucoup

d’applications envisag´ees.

Les diff´erentes technique de segmentation peuvent ˆetre class´ees selon trois cat´egorie : • Les m´ethodes bas´ees sur l’extraction de discontinuit´es (contours) dans l’image, • Les approches bas´ees sur la classification du couleur (espaces couleurs ou

histo-grammes)

• Les m´ethodes de segmentation ascendantes ou structurales.

Malgr´e les r´esultats obtenu par leur utilisation dans divers domaine d’imagerie, une nou-velle orientation des travaux de recherche r´ecents se penchent plutˆot sur des approches mixtes, alliant contours et r´egions ou bien encore classification et r´egions.

Ils s’av`erent que ce type d’approche s’adapte mieux pour des images pr´esentant de nuances, de d´egrad´es de couleurs tels que les images naturelles et fortement textur´ee [44].

Par la suite nous dressons les strat´egies de segmentation de primitive couleur de type r´egion, suivie par les diff´erentes approches de segmentation tout en introduisant les nouvelles approches mixtes.

2.2

Strat´

egies de segmentation

Dans la litt´erature, il existe quatre types diff´erentes des strat´egies de la segmentation des images couleur `a savoir la strat´egies scalaires, marginales, vectorielles et hybrides [12,32] ;

2.2.1 Strat´egies scalaires

Cette strat´egie consiste de passer d’une image couleur `a une image monochrome ou a niveau de gris. En effet, elle commence par une fusion, sous forme monocomposante, des 3 composantes de l’image couleur (P1,P2,P3), puis traite l’image en niveaux de gris ainsi obtenue (figure 2.1).

Parmi les m´ethodes qui permettent le passage d’une image vectorielle couleur `a une image scalaire, la transformation Karhunen-lo`eve [12].

dont on ne retient que la premi`ere composante. En effet, les ´etudes d’Ohta et al.[33] montrent que pour la plupart des images couleurs, tout ou partie de l’information couleur est port´ee par le premier axe principal.

Cette strat´egie nous permet de b´en´eficier de tout l’arsenal des m´ethodes de segmentation des images monochromes.

Figure 2.1: Segmentation par strat´egie scalaire.

2.2.2 Strat´egies marginale

Cette strat´egie consiste `a traiter chaque composante s´epar´ement en utilisant des traite-ments mono composants, emprunt´es `a l’imagerie monochrome.

La figure ci-dessous (Fig.2.2) illustre cette strat´egie, qui, de par sa structure, ignore to-talement la corr´elation pouvant exister entre les diff´erentes composantes, d´elaissant ainsi une information pouvant participer `a l’am´elioration des performances des traitements [32].

Figure 2.2: Segmentation par strat´egie marginale.

L’avantage de cette strat´egie est de n’utiliser que des traitements scalaires. Toutes les m´ethodes d´efinies en imagerie monochrome sont alors directement exploitables, sans aucune adaptation.

On peut, bien ´evidemment, employer des diff´erents traitements pour chaque composante, en fonction de la nature de ces composantes.

2.2.3 Strat´egie vectorielle

Du fait des corr´elations spatiales et chromatiques entre chacun des plans image, il est souvent plus convenable de segmenter les r´egions de mani`ere globale.

En effet, chaque pixel P est trait´e comme un vecteur P(x1, x2, x3) dans l’espace couleur engendr´e par les vecteurs −X→1,

−→ X2,

−→ X3.

Donc, la segmentation prenant en compte les trois composantes (figure 2.3),en mˆeme temps pour prendre de consid´eration la corr´elation entre les composante.

Figure 2.3: Segmentation par strat´egie vectorielle.

La strat´egie vectorielle pr´esente ´egalement l’int´erˆet de ne n´ecessiter qu’un seul traite-ment, mais il peut s’av´erer coˆuteux en temps.

2.2.4 Strat´egie hybride

Le m´elange des deux strat´egies marginales et vectorielles r´esulte la strat´egie hybride. Elle est couramment utilis´ee dans la segmentation par analyse d’histogrammes des images couleur.

Elle consiste `a ´etudier les histogrammes bidimensionnels obtenus par projection de l’his-togramme tridimensionnel selon deux des trois axes colorim´etriques utilis´es.

Par exemple, Cl´ement[34] a construit des histogrammes marginaux bidimensionnel (2D) (par exemple RV, RB, VB pour des images couleurs cod´ees dans l’espace colorim´etrique RVB), puis les traiter comme des images `a niveaux de gris en utilisant une strat´egie

marginale.

Les modes repr´esentent des r´egions dans l’image peuvent ˆetre d´etect´es par un algorithme du type ligne de partage des eaux.

Dans les sections suivantes nous cˆotoierons les deux principales approches de segmenta-tion `a savoir : l’approche contour et l’approche r´egion, ensuite dans la quatri`eme section nous aborderons en d´etail la classification pixellaire et enfin nous terminerons ce chapitre par les m´ethodes mixtes de la segmentation.

2.3

Les approches de Segmentation

La segmentation des images consiste `a cr´eer une partition de l’image en sous ensembles homog`enes appel´es r´egions, un ensemble de crit`eres donn´ees dans la r´ef´erence[35]. Dans le cas de la segmentation d’une image couleur, les caract´eristiques utilis´ees sont les composantes colorim´etriques des pixels. G´en´eralement, on regroupe les m´ethodes de segmentation en deux grandes classes :

• Approche contours. • Approche r´egion.

Les deux approches sont compl´ementaires et aucune n’a prouv´ee sa sup´eriorit´e par rap-port `a l’autre, chacune ayant des avantages et ses domaines d’application.

2.3.1 Les approches contour

L’extraction des contours a en g´en´eral l’avantage de fournir des contours bien localis´es et fonctionne bien lorsque les zones de part et d’autre du contour ont des intensit´es moyennes diff´erentes. Les m´ethodes qui extraient les r´egions sont peu pr´ecises sur les contours.

Dans une image, les variations (d’intensit´e, de couleur, de texture. . . ) repr´esentent des changements de propri´et´es physiques ou g´eom´etriques de la sc`ene ou de l’objet observ´e correspondant.Dans un grand nombre de cas, ces variations des propri´et´es sont des informations importantes pour les op´erations de la segmentation.

de la sc`ene.

La d´etection de contour se d´efinit comme la recherche de discontinuit´es locales entre les propri´et´es de deux ensembles connexes de pixel.

Pour d´etecter les contours nous pr´esentons bri`evement les m´ethodes d´erivatives, car ces m´ethodes sont imm´ediates pour d´etecter et localiser les variations d’une telle fonction. Pour cette raison on consid`ere que l’image num´erique est le produit d’un ´echantillonnage d’une fonction continue `a support born´e et continument d´erivable. On peut classer les m´ethodes de d´etection en contour en quatre classes [12] :

• Les m´ethodes qui fusionnent les r´esultats marginaux (carte de contour ou cartes de normes du gradient)

• La m´ethode de Di Zeno qui calcule le vecteur gradient couleur `a partir des vecteurs gradients marginaux.

• La m´ethode Carron qui calcule le vecteur gradient bas´e sur la teinte. • Les m´ethodes fond´ees sur les d´eriv´ees secondes.

Ces m´ethodes ne conduisent pas directement `a une segmentation de l’image, car les contours obtenus sont rarement connexes, il faut donc proc´eder `a une fermeture des contours si l’on souhaite une partition compl`ete de l’image [36].

En effet, apr`es fermeture de contours, la dualit´e contours r´egions apparaˆıt nettement,Les r´egions sont d´efinies comme l’int´erieur ferm´e.

2.3.2 Approche r´egion

Dans les approches qui extraient les r´egions, les m´ethodes de classification sont beaucoup utilis´ees. Elles d´eterminent une partition de l’espace des couleurs et ne prennent pas en compte la disposition spatiale des pixels.

Dans l’espace des donn´ees, les r´egions peuvent ˆetre regard´ees comme des r´egions de hautes densit´es, s´epar´ees par des r´egions de faible densit´e.

La segmentation d’une image I en r´egion Ri a pour but de regrouper des pixels connexes ayant des couleurs similaires, afin de constituer des r´egions de couleurs homog`enes, ces r´egions ´etant dans la mesure du possible li´ees `a un objet ou `a une partie d’un objet repr´esent´e dans l’image [37].

Chaque pixel est affect´e `a une r´egion unique. Les pixels de chaque r´egion doivent res-pecter des crit`eres d’homog´en´eit´e et de connexit´e [38] .

`

A l’issue de la segmentation, une couleur al´eatoire (une ´etiquette ou label) peut ˆetre affect´ee aux r´egions form´ees, de mani`ere `a visualiser la partition (figure 2.4).

Figure 2.4: image de synth`ese originale. (b) image segment´e.

Les m´ethodes de l’approche r´egion existantes peuvent ˆetre class´ees dans deux cat´egories, selon que l’analyse s’effectue dans le plan image ou dans un espace couleur [35].

La premi`ere cat´egorie fond´ee sur l’analyse spatiale du plan image 2D afin de reconsti-tuer des ensembles de pixels connexes pr´esentant des couleurs homog`enes, cette m´ethode appel´ee construction de r´egion. La deuxi`eme fond´ee sur la classification de pixels en fonc-tions de leurs attributs spectraux, cette m´ethode appel´ee classification pixellaire. Les m´ethodes de construction de r´egions traitent les pixels en utilisant l’interaction spatio-colorim´etrique dans l’espace image (2D). Ces techniques consistent `a regrouper it´erativement des ensembles de pixels connexes en r´egions selon des propri´et´es d’ho-mog´en´eit´e. Le but de ce type d’approche est de d´efinir des crit`eres de regroupement des pixels permettant l’obtention de r´egions homog`enes. Les relations spatiales sont ainsi utilis´ees tout au long du processus de segmentation.

Ces m´ethodes peuvent ˆetre subdivis´ees en deux classes : m´ethodes de croissance en r´egion et m´ethodes structurelles.

![Figure 1.4: Mosa¨ıque des photor´ ecepteurs sur la r´ etine [ 31 ] a) La fov´ ea : arrangement r´ egulier et serr´ e de cˆ ones](https://thumb-eu.123doks.com/thumbv2/123doknet/2195603.11970/22.893.177.811.466.653/figure-mosa-ique-photor-ecepteurs-etine-arrangement-egulier.webp)

![Figure 1.8: Les familles de syst` emes de repr´ esentation de la couleur[ 1 ].](https://thumb-eu.123doks.com/thumbv2/123doknet/2195603.11970/37.893.166.784.120.982/figure-familles-syst-emes-repr-esentation-couleur.webp)