HAL Id: tel-03155480

https://tel.archives-ouvertes.fr/tel-03155480

Submitted on 1 Mar 2021

HAL is a multi-disciplinary open access

archive for the deposit and dissemination of sci-entific research documents, whether they are pub-lished or not. The documents may come from teaching and research institutions in France or abroad, or from public or private research centers.

L’archive ouverte pluridisciplinaire HAL, est destinée au dépôt et à la diffusion de documents scientifiques de niveau recherche, publiés ou non, émanant des établissements d’enseignement et de recherche français ou étrangers, des laboratoires publics ou privés.

Protection des données personnelles et droit à la vie

privée : enquête sur la notion controversée de “ donnée à

caractère personnel ”

Julien Rossi

To cite this version:

Julien Rossi. Protection des données personnelles et droit à la vie privée : enquête sur la notion controversée de “ donnée à caractère personnel ”. Science politique. Université de Technologie de Compiègne, 2020. Français. �NNT : 2020COMP2549�. �tel-03155480�

Par Julien ROSSI

Thèse présentée

pour l’obtention du grade

de Docteur de l’UTC

Protection des données personnelles et droit à la vie

privée : enquête sur la notion controversée de

« donnée à caractère personnel »

Soutenue le 2 juillet 2020

Spécialité : Sciences de l’Information et de la Communication et

Science Politique : Unité de recherche COSTECH (EA-2223)

Université de technologie de Compiègne

École doctorale « Sciences de l’ingénieur »

Laboratoire COSTECH, EA 2223

Protection des données personnelles et droit à la vie

privée : enquête sur la notion controversée de

« donnée à caractère personnel »

Thèse de doctorat en

Sciences de l’information et de la communication et Science politique Présentée par :

Julien Rossi

sous la direction de :

Virginie Julliard et Jérôme Valluy Soutenue publiquement le 2 juillet 2020

Membres du jury :

Serge BOUCHARDON – Professeur des Universités à l’Université de Technologie de

Compiègne

Isabelle GARCIN-MARROU – Professeure des Universités à Sciences Po Lyon

Gloria GONZÁLEZ FUSTER – Professeure de recherche à la Vrije Universteit Brussel

Virginie JULLIARD – Professeure des Universités à Sorbonne Université

Valérie SCHAFER – Professeure des Universités à l’Université du Luxembourg

Jérôme VALLUY – Maître de conférences HDR à l’Université Paris 1 Panthéon-Sorbonne,

Protection des données

personnelles et droit à la vie privée

Enquête sur la notion controversée de

« donnée à caractère personnel »

Remerciements

Le « nous » académique choisi dans cette thèse n’est pas qu’une façon d’écrire un peu ampoulée et désuète. Il sert aussi à rappeler qu’un travail de recherche n’est jamais produit par le supposé génie d’un·e chercheur·e isolé·e, mais est, en réalité, le fruit d’un effort collectif auquel de nombreuses personnes contribuent.

Je tiens à commencer par Jérôme Valluy et Virginie Julliard, mes directeur et directrice de thèse. Je leur suis redevable de nombreux conseils avisés, de nombreuses relectures attentives, de nombreuses idées qui ont fait progresser ma réflexion.

Je remercie les membres du jury qui me font l’honneur de lire et commenter ce travail, d’autant qu’ils ont accepté ce travail supplémentaire en plein milieu d’une période particulièrement incertaine.

Cette thèse ne serait pas elle-même sans la thèse T.A.C., sans la découverte de la recherche technologique, et sans les moments de convivialité partagés au Minibar ou à la terrasse du bistrot en face de la gare de Compiègne. Le COSTECH, qui m’a financé, est un excellent endroit pour y faire sa thèse. Je remercie chaleureusement tou·te·s celles et ceux que j’y ai côtoyé·e·s : Charles,

春 梅, Clément, Cléo, Édouard, Églantine, Gaëlle, Hugues, Isabel, Jean-Édouard, Karl, Manon, Nina, Peppe, Serge, Yann et tant d’autres. Je remercie en particulier Xavier Guchet, pour son travail de référent de l’école doctorale, sans oublier Christine Bry, pour sa disponibilité et l’impressionnante efficacité avec laquelle elle a répondu à toutes mes questions administratives. Merci aussi à tant de collègues universitaires avec qui j’ai travaillé, qui m’ont soutenu, m’ont fait réfléchir, me rappeler que j’ai encore moult progrès à faire… Je n’ai pas l’espace d’être exhaustif, mais je pense en particulier à Francesca Musiani et aux autres membres du groupe « Gouvernance d’Internet » du GDR Internet, IA et Société. Je pense aussi à tous les collègues rencontrés à Bruxelles, et notamment celles et ceux du LSTS avec qui j’ai eu la chance de travailler.

Je voudrais adresser de chaleureux remerciements aux collègues du Département de communication de Rennes 2. Même si les étudiant·e·s y produisent assez de copies à corriger pour pouvoir nager dedans comme Picsou au milieu de ses billets de banque, je garderai de très bons souvenirs de ces années d’ATER et j’espère que nous nous reverrons quand cette histoire de virus sera derrière nous.

Merci aux projets ENEID et Sensibdata pour avoir contribué financièrement à mes travaux de recherche.

Je voudrais aussi exprimer ma gratitude envers toutes les personnes qui ont accepté, gratuitement, de me donner du temps, pour un entretien, pour un conseil, pour m’aider à accéder à des informations, ou encore pour compléter un questionnaire.

Il ne faudrait pas oublier toutes celles et ceux qui sans qui il n’y aurait même pas eu de projet de thèse. Je dois des remerciements tout d’abord à Jean-Jacques Lavenue, qui fut mon directeur de mémoire à Sciences Po Lille. C’est lui qui m’a fait tomber dans la marmite de la protection des données. Je remercie aussi Clément Fontan. Sans ses conseils je n’aurais probablement jamais réussi à faire aboutir mon projet.

Je n’oublie pas non plus le soutien que Gloria Origgi et Iván Székely m’ont apporté au moment décisif de chercher des financements pour la thèse.

Je dois aussi des remerciements à Attila Péterfalvi, Júlia Sziklay, et tous les collègues de l’Autorité nationale pour la protection des données et la liberté de l’information de Hongrie, qui m’ont beaucoup apporté et qui ont continué à me soutenir pendant la thèse. Je voudrais aussi saluer mes anciens collègues de la CNIL et du Centre des hautes études du Ministère de l’intérieur. J’ai beaucoup appris à leur contact.

Ces pages de remerciements seraient incomplètes si elles ne mentionnaient pas les collègues et ami·e·s de l’Université de Szeged, qui m’ont fait découvrir et aimer le métier d’enseignant-chercheur l’année avant le début de la thèse : Péter Kruzslicz, Laureline Congnard, Souleymane N’Diaye, Andrea Gyivicsán, Tünde Silay et Attila Badó.

Merci aussi à mes proches pour m’avoir soutenu et supporté pendant toute la durée de la thèse. Il va sans dire que cette thèse n’aurait pas existé sans mes parents. Ils m’ont soutenu, pas seulement dans mes études, mais dans tout le reste.

Merci à Alda, Camille, Grégoire, Kaja, Lune, Marine, Mélanie, Nebiha, Sergio et Souleymane pour vos relectures et vos aides pour certaines traductions. Merci à Guillaume pour toutes ces journées passées à écrire des scripts en Python. Merci enfin à Mélanie de m’avoir tant soutenu et aidé dans le sprint final de la fin de thèse, et de m’avoir offert un refuge fleuri loin de l’enfer de mon studio parisien pendant le confinement. Enfin, puisqu’une page de remerciements sur la protection des données à caractère personnel ne serait pas complète sans un peu de chiffrement : Yahou ! Dru ! Pogolin ! Kneu !

Enfin, je ne peux conclure les remerciements d’une thèse qui porte sur la protection des données, de la vie privée, et plus largement des droits humains, sans remercier celles et ceux qui se sont battu·e·s et continuent à se battre pour les défendre. Merci à vous.

Résumé

La menace qu’Internet et les technologies numériques de l’information et de la communication en général font ou feraient peser sur la vie privée soulève de nombreux débats, tant dans la presse qu’au niveau politique. L’affaire Snowden en 2013, puis l’adoption en 2016 du Règlement général de protection des données (RGPD), ont renforcé la visibilité de ces controverses dans l’espace public.

Cette thèse part d’une triple interrogation : pouvons-nous définir ce qu’est la « vie privée », existe-t-il un consensus autour de la question, et ce consensus évolue-t-il avec des évolutions de notre milieu technique qui affectent nos modes de communication, et donc d’intrusion dans celle-ci ?

En définissant la « vie privée » comme l’objet protégé par des textes normatifs – textes de loi, jurisprudence et standards techno-politiques d’Internet – qui protègent le droit à la vie privée, il est possible d’en étudier empiriquement l’évolution et les controverses qui l’accompagnent. Le droit de la protection des données à caractère personnel a émergé en Europe dans les années 1970 pour protéger une « vie privée » perçue comme menacée par une informatique encore à ses débuts. Aujourd’hui, le RGPD, ou encore certains documents édictés par des organismes de standardisation comme l’Internet Engineering Task Force (IETF) ou le World Wide Web Consortium (W3C), visent à protéger cette vie privée au travers d’un corpus de règles, la « protection des données », qui concerne les « données à caractère personnel ».

Les définitions juridiques de cette notion produites dans des arènes institutionnelles et celles produites dans des arènes de standardisation technique sont identiques. L’étude de la généalogie de la protection des données révèle en outre le rôle déterminant d’informaticiens dans l’invention de la « protection des données » et en particulier des principes qui régissent aujourd’hui encore les dispositions contenues dans le RGPD.

L’analyse des controverses qui ont eu lieu dans les arènes d’élaboration de ces normes montre que la notion de « donnée à caractère personnel » inscrite dans les textes de notre corpus reflète essentiellement le système de convictions d’une coalition d’acteurs inspirés par des idéaux libéraux utilitaristes, attachés à l’autonomie de l’individu et accordant de l’importance au respect de son consentement. Ce paradigme s’est imposé dans les arènes étudiées face à d’autres conceptions de la « vie privée », notamment celles qui la définissent comme un espace collectivement défini ôté au regard de l’espace public, ou encore celles qui préconisent une patrimonialisation de ces données.

Ce n’est donc pas l’informatique qui a directement déterminé une évolution dans l’objet de la protection du droit de la vie privée, mais ses perceptions par un groupe d’acteurs. Convaincus de l’utilité sociale de la protection de leur conception libérale de la vie privée, ces derniers sont parvenus à faire émerger, en Europe, dans les années 1970, une nouvelle catégorie juridique : le

droit à la protection des données. Le RGPD, adopté en 2016, tout comme les projets de standards du Web visant à protéger la vie privée et étudiés dans cette thèse, reprennent les principes issus de ces premiers débats. Ce faisant, l’arrivée de l’informatique a, indirectement mais effectivement, été un élément déclencheur dans l’évolution de la « vie privée » définie comme objet du droit à la vie privée.

Mots-clefs : informatisation de la communication, vie privée, protection des données, données à caractère personnel, approches communicationnelles du droit et des politiques publiques

English summary

Internet and digital information and communication technologies in general are often portrayed as a threat to privacy. This gives rise to many debates, both in the media and among decision-makers. The Snowden revelations, in 2013, followed by the adoption in 2016 of the General Data Protection Regulation (GDPR), have moved these discussions under the spotlight of the public sphere.

The research presented in this dissertation was born out of three questions: can we define what “privacy” is? Is there any consensus on its definition? And does this consensus change with the evolution of the technical milieu transforming our ways of communicating, and by doing so, the way in which our privacy can be intruded upon?

By defining “privacy” as the object which is protected by normative texts – laws, court decisions, techno-political standards of the Internet – protecting the right to privacy, it becomes possible to conduct an empirical study of how it evolved and how it has been a topic of contention.

Data protection law emerged in Europe during the 1970’s. Its aim was to protect a “privacy” that was perceived as under threat by the advent of computers. Currently, the GDPR, or some documents adopted by standards-settings organisations like the Internet Engineering Task Force (IETF) or the World Wide Web Consortium (W3C), are written with the intention that they protect this privacy through a set of rules and principles referred to as “data protection”, that apply to “personal data”.

The legal definitions of this notion produced by political institutions and those crafted in standards-settings bodies are identical. Furthermore, the study of the genealogy of data protection reveals that computer scientists have played a pivotal role in the invention of the principles that “data protection” still relies on, for instance in the GDPR.

The analysis of the controversies that took place in the shaping of these rules shows that the notion of “personal data” written down in the normative texts we analysed essentially reflects the beliefs system of a coalition inspired by liberal utilitarian ideals, valuing individual autonomy and granting importance to the respect of one’s consent. This framing of “privacy” has become

the paradigm on the field. Other theories, such as those defining “privacy” as a space bound by collectively defined borders protecting it from the public eye, or those advocating the recognition of private property rights on personal data, have been less successful in shaping policy outcomes. The advent and spread of networked computers have not directly determined the evolution of the object that is protected by the right to privacy. It is, rather, the perceptions a group of actors had of computers, that caused such an evolution. Convinced that their liberal conception of privacy is socially valuable, they managed to craft a new legal category during the 1970’s in Europe: the right to the protection of personal data. The GDPR, adopted in 2016, just like Web standards aiming at enhancing the protection of privacy, rely those same principles that were invented during these early debates. Therefore, it can be said that the emergence of computers has indeed, but indirectly, been a triggering factor in the evolution of “privacy” defined as the object protected by the right to privacy.

Keywords : digitisation of communication, privacy, data protection, personal data, communicational theories of Law and public policy

Table des matières

Remerciements...4

Résumé... 6

English summary...7

Table des matières...9

Table des abréviations...15

Table des tableaux et illustrations...19

Introduction générale...25

Vie privée et milieu technique...29

Traces numérique et surveillance...32

Droit à la vie privée, droit à la protection des données à caractère personnel...35

Le droit saisi par une approche communicationnelle...42

Construction de l’objet de recherche...46

Hypothèses...49

Annonce du plan...54

Chapitre 1 : Méthode et terrains...57

1.1. Le cadre méthodologique...57

1.2. Description des terrains...70

1.2.1. Présentation générale...70

1.2.2. Les enquêtes exploratoires centrées sur la première hypothèse...71

1.2.3. L’étude de la socio-genèse du droit de la protection des données au Conseil de l’Europe et à l’OCDE...74

1.2.3.1. Identification du terrain...74

1.2.3.2. Travail sur archives...76

1.2.3.3. Entretiens...78

1.2.3.4. Autres documents...81

1.2.4. L’adoption du Règlement général de protection des données...82

1.2.4.1. La jurisprudence de la Cour de justice de l’Union européenne...82

1.2.4.2. Identification du terrain...82

1.2.4.3. Exploration ethnographique...85

1.2.4.4. Analyse qualitative de documents...89

1.2.4.5. Entretiens...92

1.2.5. Le Privacy Internet Group et le Tracking Protection Working Group du W3C...95

1.2.5.1. Identification du terrain...95

1.2.5.2. Entretiens...95

1.2.5.3. Listes de discussion (mailing-lists)...99

1.2.5.4. Observation participante lors de la réunion F2F annuel du Privacy Interest Group au Technical Plenary and Advisory Committee de Lyon en 2018...103

1.2.5.5. Autres documents exploités dans l'analyse...104

1.3. Explorer les différentes conceptions de la notion de « vie privée »...105

Chapitre 2 : Penser le droit à la vie privée...107

2.2. Le paradigme libéral de la vie privée et son évolution foucaldienne...113

2.3. Les critiques du paradigme libéral de la vie privée...126

2.3.1. La critique néolibérale par l’École de Chicago...126

2.3.2. La critique féministe de la vie privée...131

2.3.3. Les critiques marxistes et marxiennes...134

2.3.4. La critique communautariste...141

2.3.5. L’approche par les contextes : critique ou reformulation du paradigme libéral de la vie privée ?...145

2.4. Les entrées par la technique...149

2.4.1. Utopies communicationnelles, Big Data et Quantified Self...149

2.4.2. La souveraineté numérique...155

2.4.3. Critique écologiste, antiproductiviste et technocritique de l’informatique et questions de « vie privée »...159

2.5. Conclusion du chapitre...164

Chapitre 3 : La généalogie du droit à la protection des données à caractère personnel ... 166

3.1. Introduction...166

3.2. Le retour à l’agenda du droit à la vie privée aux États-Unis dans les années 1960...170

3.2.1. L’échec des premières tentatives de faire reconnaître le droit à la vie privée au début du XXe siècle...170

3.2.2. La reconnaissance du droit à la vie privée à la fin du McCarthyisme...171

3.2.3. L’ordinateur dans l’imaginaire social des années 1960 : une figure inquiétante du complexe militaro-industriel de la Guerre froide...174

3.2.4. De la science-fiction à la politique : les fichiers informatisés deviennent un problème public...177

3.2.5. La montée en puissance du paradigme libéral de la vie privée dans le débat...183

3.3. L'invention en Europe de la Datenschutz (protection des données)...187

3.3.1. Comment la controverse sur l’ordinateur et les fichiers de renseignements personnels a traversé l’Atlantique...187

3.3.2. L’invention de la « protection des données » dans le Land de Hesse puis du « droit à l’auto-détermination informationnelle » en République fédérale d’Allemagne...190

3.3.3. Les Pays-Bas...195

3.3.4. La Suède...197

3.3.5. La France...200

3.4. Le rôle du Conseil de l’Europe et de l’OCDE...203

3.4.1. Rappels sur le choix des terrains...203

3.4.2. Le groupe d’experts sur la protection de la vie privée vis-à-vis des banques de données électroniques du Conseil de l'Europe...204

3.4.3. Les groupes informatiques successifs de l'OCDE...210

3.4.4. L’invention des principes de la protection des données...216

3.5. La formation de la privacy community...223

3.6. Le rôle du « paradigme de la vie privée » dans la privacy community...231

3.7. Le clivage entre Common Law et droit continental dans les arènes étudiées...236

3.8. Le rôle de l'argument de la confiance sur la période 1966 – 1981...247

3.9. Conclusion du chapitre...257

Chapitre 4 : L’adoption du RGPD (2009-2016)...260

4.1.1. De la Convention 108 au RGPD...260

4.1.2. La communautarisation du droit des données à caractère personnel...261

4.1.3. Le Règlement général de protection des données (RGPD)...272

4.1.4. Le rôle structurant du réseau transgouvernemental des autorités de protection des données dans le sous-système de politique publique de protection des données de l’Union européenne...285

4.1.5. Les groupes d’intérêt dans l’Union européenne : expertise, crédibilité, légitimité...294

4.2. Identification des coalitions de cause...310

4.3. Les principaux points de controverse...322

4.3.1. Sélection des points de controverse étudiés...322

4.3.2. Quel degré de transfert de compétences à l’Union européenne ?...324

4.3.3. Bases légales, consentement et intérêt légitime...332

4.3.4. La définition de la notion de « donnée à caractère personnel »...337

4.3.5. La formule de « l’approche basée sur le risque »...341

4.3.6. L’encadrement du profilage...346

4.4. L’argument de l’équilibre avec l’objectif d’intérêt général de la croissance économique dans une « économie du savoir »...350

4.5. La stabilité de l’argument de la confiance comme articulation entre le paradigme de la vie privée et le référentiel global...359

4.6. La stabilité du paradigme libéral de la vie privée...364

4.7. Conclusion du chapitre...379

Chapitre 5 : La « privacy » dans la production des standards techniques du Web. .381 5.1. Introduction...381

5.2. Les arènes de la gouvernance d'Internet et les standards techniques...383

5.2.1. La gouvernance d'Internet...383

5.2.2. Des standards techniques normatifs et performatifs...385

5.2.3. Les arènes de la gouvernance d'Internet...398

5.2.4. Les standards techno-politiques d'Internet...406

5.3. Le World Wide Web Consortium (W3C)...415

5.4. Les activités liées à la protection de la « vie privée » au W3C...422

5.4.1. Identifier les arènes de mise en débat de la « privacy » au cours du temps...422

5.4.2. L’échec du projet Platform for Privacy Preferences (P3P)...424

5.4.3. L’essor de l’Internet des objets et les controverses sur la « vie privée »...427

5.4.4. Le rôle et le fonctionnement du Privacy Interest Group...430

5.4.5. Le Tracking Protection Working Group et le projet Do Not Track...438

5.4.6. Présentation des outils de communication utilisés par le PING et le TPWG...446

5.5. La contrainte discursive du consensus dans la controverse sur le « tracking » et la « privacy »...450

5.5.1. Présentation de la controverse sur la définition du mot « tracking »...450

5.5.2. Un agir communicationnel qui s'impose...453

5.5.3. À la non-recherche d'une définition commune de la vie privée, un concept « essentiellement contesté »...460

5.5.4. La controverse sur la définition du « tracking »...466

5.5.5. La structuration d'une privacy community des standards du Web...478

5.6. Analyse des arguments sur la « vie privée » en circulation dans les arènes du W3C étudiées...481

5.6.2. La vie privée contextuelle...487

5.6.3. Le thème de la confiance...491

5.6.4. La réglementation en embuscade...498

5.6.5. À la recherche des contre-arguments...507

5.7. Conclusion du chapitre...514

Chapitre 6 : Focus sur les controverses définitionnelles autour de la notion de « donnée à caractère personnel »...519

6.1. Introduction : la « donnée à caractère personnel » comme objet de controverses...519

6.2. L’invention de la notion juridique de « donnée à caractère personnel »...521

6.2.1. Des données relatives à des « personnes »...523

6.2.2. Les données qui relèvent de l'intimité, ou toute donnée ?...531

6.3. La définition de la notion de donnée à caractère personnel en débat devant la Cour de justice de l’Union européenne...538

6.3.1. Le rôle de la Cour de justice de l’Union européenne dans le droit de la protection des données à caractère personnel en Europe...538

6.3.2. « Toute information … » : le rappel de la définition...542

6.3.3. « identifiée ou identifiable, directement ou indirectement » : les adresses IP sont-elles des données à caractère personnel ?...545

6.3.4. Conclusion partielle sur la jurisprudence de la CJUE sur la notion de « donnée à caractère personnel »...547

6.4. Les débats sur la définition de « donnée à caractère personnel » à inclure dans le texte du RGPD...547

6.4.1. La proposition initiale de la Commission européenne...547

6.4.2. « Singling out » : la proposition d'amendement de European Digital Rights...549

6.4.3. L’« approche fondée sur le risque », l’anonymisation et la pseudonymisation...554

6.4.4. Le compromis inscrit dans le RGPD...558

6.5. La reprise de la notion de donnée à caractère personnel dans les discussions issue du droit européen par le W3C...561

6.6. Discussion de l’hypothèse initiale d’une distinction entre approche juridique et approche informaticienne...568

6.7. Conclusion du chapitre : une définition stable sur le temps long de la notion de donnée à caractère personnel, qui correspond aux représentations du paradigme libéral de la vie privée ...578

Conclusion générale...580

Bibliographie...589

Travaux cités...589

Articles de presse...617

Normes juridiques citées...620

Accords internationaux...620

Droit dérivé des Communautés européennes puis de l’Union européenne...621

Droit dérivé de la Communauté économique des États de l’Afrique de l’Ouest...622

Lois et règlements...622

Autriche...622

Californie (État des États-Unis d’Amérique)...623

États-Unis d’Amérique...623

France...623

Hongrie...624

New York (État des États-Unis d’Amérique)...624

Pays-Bas...624

Rhénanie-Palatinat (Land allemand)...624

Royaume-Uni...625

Russie...625

Saint-Marin...625

Schleswig-Holstein (Land allemand)...625

Suède...625

Jurisprudence citée...625

Allemagne...625

Communautés européennes puis Union européenne...626

Cour européenne des droits de l’Homme...626

États-Unis d’Amérique...626

France...627

Hongrie...627

Minnesota (État)...627

Pays-Bas...627

Rhénanie-du-Nord–Westphalie (Land allemand)...627

Décisions d’autorités administratives indépendantes...628

Agencia Española de Protectión de Datos (AEPD – Espagne)...628

Commission nationale de l’informatique et des libertés (CNIL – France)...628

Garante Privacy (Italie)...628

Avis et autres résolutions non-contraignantes...628

Communautés européennes puis Union européenne...628

Conseil de l’Europe...629

Groupe de travail de l’Article 29...629

OCDE...630

Documents de corpus cités...630

Documents d’archives...630

Archives du Conseil de l’Europe...630

Archives de l’OCDE...632

Documents versés à la Consultation de 2009 de la Commission européenne...633

Documents versés à la Consultation de 2010 de la Commission européenne...634

Corpus de documents récupérés du collectif Lobbyplag...636

E-mails des listes de discussion publiques du W3C...640

Liste public-privacy...640

Liste public-tracking...641

Autres listes de discussion...645

Documents de standardisation technique...646

Autres rapports et documents institutionnels...652

Autres documents et publications...660

Romans et nouvelles (fiction)...660

Livres de non-fiction...661

Productions audiovisuelles...661

Annexe 1 : Tableau comparatif entre la listes des principes énumérés dans les Lignes

directrices de l’OCDE et ceux de la Convention 108 du Conseil de l’Europe...666

Annexe 2 : Tableau de l’évolution de la notion de « donnée à caractère personnel » ... 668

Annexe 3 : Chronologie de l’adoption du RGPD...679

Annexe 4 : Liste exhaustive des « policy papers » et documents institutionnels intégrés au corpus pour l’étude de l’adoption du RGPD...681

Corpus « Lobbyplag »...681

Documents issus de la consultation de 2009...685

Documents issus de la consultation de 2010...691

Documents du Conseil de l’Union européenne...702

Annexe 5 : Nombre d’amendements par disposition de la proposition de RGPD....704

Annexe 6 : Tableau comparatif entre l’art. 7 de la directive 95/46/CE, l’art. 6 paragraphe 1 de la proposition de RGPD de 2012, et l’art. 6 paragraphe 1 du RGPD tel qu’adopté en avril 2016...706

Annexe 7 : Exemple de grille d’entretien du terrain sur le RGPD...708

Annexe 8 : Composition de l’Industry Coalition for Data Protection en septembre 2012... 710

Annexe 9 : Composition du W3C PING et du W3C TPWG...713

Annexe 10 : Chronologie des actions en matière de « privacy » dans les arènes de standardisation technique...717

Annexe 11 : Grille d’entretien des entretiens exploratoires...725

Annexe 12 : Liste des décisions de la CEDH et de la CJUE étudiées...727

Annexe 13 : Évolution des « principes » de la protection des données, des propositions de la British Computer Society à la Résolution (73) 22 du Conseil de l’Europe...731

Annexe 14 : Structure du questionnaire exploratoire en ligne...741

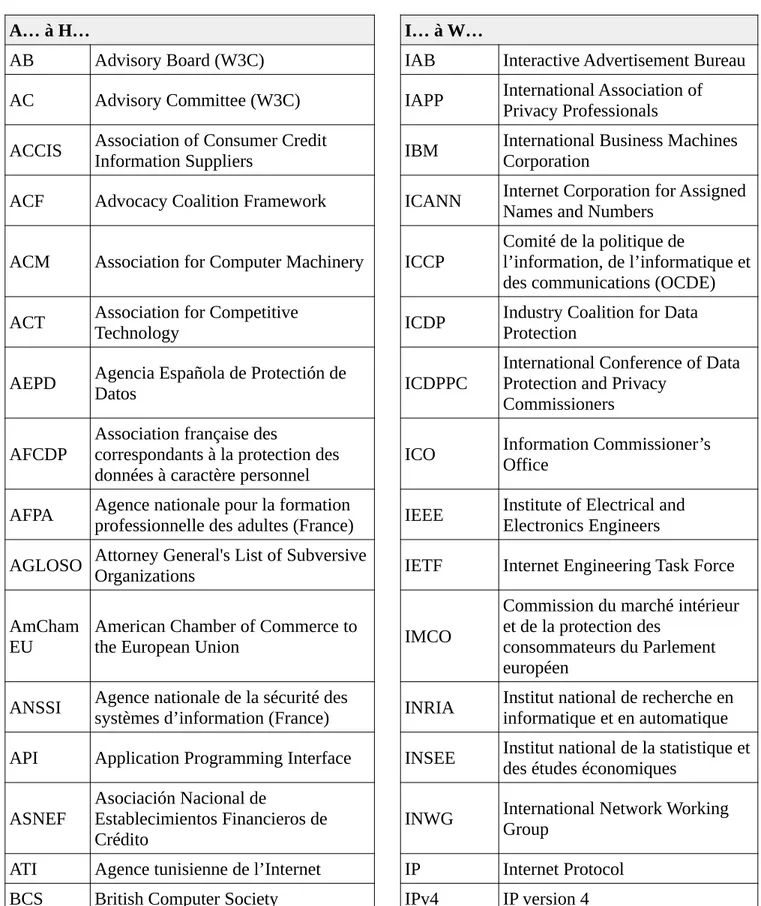

Table des abréviations

A… à H… I… à W…

AB Advisory Board (W3C) IAB Interactive Advertisement Bureau

AC Advisory Committee (W3C) IAPP International Association of Privacy Professionals ACCIS Association of Consumer Credit

Information Suppliers IBM

International Business Machines Corporation

ACF Advocacy Coalition Framework ICANN Internet Corporation for Assigned Names and Numbers

ACM Association for Computer Machinery ICCP

Comité de la politique de

l’information, de l’informatique et des communications (OCDE) ACT Association for Competitive

Technology ICDP

Industry Coalition for Data Protection

AEPD Agencia Española de Protectión de Datos ICDPPC

International Conference of Data Protection and Privacy

Commissioners AFCDP

Association française des

correspondants à la protection des données à caractère personnel

ICO Information Commissioner’s

Office

AFPA Agence nationale pour la formation professionnelle des adultes (France) IEEE Institute of Electrical and Electronics Engineers AGLOSO Attorney General's List of Subversive

Organizations IETF Internet Engineering Task Force

AmCham EU

American Chamber of Commerce to

the European Union IMCO

Commission du marché intérieur et de la protection des

consommateurs du Parlement européen

ANSSI Agence nationale de la sécurité des systèmes d’information (France) INRIA Institut national de recherche en informatique et en automatique API Application Programming Interface INSEE Institut national de la statistique etdes études économiques ASNEF

Asociación Nacional de

Establecimientos Financieros de

Crédito INWG

International Network Working Group

ATI Agence tunisienne de l’Internet IP Internet Protocol

BEUC Bureau européen des unions de consommateurs IPv6 IP version 6

BSA Business Software Alliance IRC Internet Relay Chat

C. Cass. Cour de Cassation (France) ISFE Interactive Software Federation ofEurope CAEM Comité d’assistance économique

mutuelle ISO

Organisation internationale de normalisation

CCJ Comité de coopération juridique du Conseil de l’Europe ISOC Internet Society CDT Center for Democracy and

Technology JAI Justice et affaires intérieures

CECA Communauté européenne du charbon et de l’acier JBCE Japan Business Council in Europe CECIL Centre d'Études sur la Citoyenneté, l'Informatisation et les Libertés JOCE Journal officiel des Communautés européennes CEDH Cour européenne des droits de

l’Homme JSON JavaScript Object Notation

CEE Communauté économique

européenne LIBE

Commission des libertés civiles, de la justice et des affaires intérieures

CEPD Comité européen de la protection des données NCP Network Control Protocol CERN Centre européen de recherche

nucléaire NDA Note de l’auteur

CFDT Confédération française démocratiquedu travail NDT Note de traduction CJCE Cour de justice des Communautés européennes NDT Note de tradution CJUE Cour de justice de l’Union européenne (ex-CJCE) NIR

Numéro d’inscription au répertoire des personnes physiques

CLODO Comité de libération et de détournements d’ordinateurs NIS Network and Information Systems CNIL Commission nationale de l’informatique et des libertés (France) NOYB None Of Your Business

COINTEL

PRO Counter INTelligence PROgram NSA

National Security Agency (États-Unis d’Amérique)

Conventio n EDH

Convention de sauvegarde des droits de l’Homme et des libertés

NTIA National Telecommunications and Information Administration

fondamentales (États-Unis d’Amérique) CPDP Computers, Privacy and Data Protection (conférence) NWG Network Working Group

CSV Comma-Separated Values OASIS Organization for the Advancementof Structured Information Standards

CUG Computer Utilization Group de l’OCDE OCDE Organisation de coopération et de développement économiques CWV Comité Waakzaamheid Volkstelling OECE Organisation européenne de coopération économique DAPIX Groupe « échange d’informations et protection des données » (Conseil de

l’UE)

ONG Organisation non

gouvernementale

DARPA Defense Advanced Research Projects Agency OPA Online Publishers Association

DG Direction générale OSI Open Systems Interconnection

DG JUST Direction générale de la justice et des consommateurs (Commission européenne)

P3P Platform for Privacy Preferences

DNS Domain Name System PIB Produit intérieur brut

DNT Do Not Track PII Personnally Identifiable Information

DPD Délégués à la protection des données PING Privacy Interest Group (du W3C)

DSK Datenschutzkomision (Autriche) PME Petites et moyennes entreprises

DSTI

Direction de la science, de la technologie et de l’innovation (OCDE)

PRISM Nom de code d’un projet de surveillance de la NSA DUDH Déclaration universelle des droits de l’Homme RFA République fédérale d’Allemagne EDPB European Data Protection Board

(voir : CEPD) RFC Request for Comments

EDPS

European Data Protection Supervisor (Contrôleur européen de la protection des données)

RFID Radio-frequency identification EDRi European Digital Rights RGPD Règlement général de protection des données EFF Electronic Frontier Foundation SAFARI Système automatisé pour les fichiers administratifs et le

EMOTA European Multi-channel and Online Trade Association SIS Système d’information Schengen

EPC European Publishers Council SPT Comité de la politique scientifique

et technologique (OCDE)

EPIC Electronic Privacy Information Center SSRC Social Science Research Council Euratom Communauté européenne de l’énergieatomique TAG Technical Architecture Group (W3C) euroISPA Europe Internet Service Providers Association TCE Traité instituant la Communauté européenne

F2F Face-to-face Meetings (W3C) TCP Transmission Control Protocol

FBI Federal Bureau of Investigation TFUE Traité sur le fonctionnement de l’Union européenne FECEMD Federación de Comercio Electrónico

y Marketing Directo TIC

Techniques (ou technologies) de l’information et de la

communication

FEDMA Federation of European Direct and Interactive Marketing TPAC Technical Plenary and Advisory Committee (W3C)

FPF Future of Privacy Forum TPE Tracking Preference Expression

FTC Federal Trade Commission TPS Tracking Compliance and Scope

G29 Groupe de travail de l’Article 29 TPWG Tracking Protection Working Group (du W3C)

GAFA Google Amazon Facebook Apple TUE Traité sur l’Union européenne

GAMIN Gestion automatisée de médecine infantile UE Union européenne

HEW Health, Education and Welfare UNIVAC UNIVersal Automatic Computer

HRPC Human Rights Protocol Considerations (IRTF) URL Uniform Resource Locator

HTML HyperText Markup Language URSS Union des républiques socialistes soviétiques

HTTP HyperText Transfer Protocol W3C World Wide Web Consortium

HTTPS HTTP Secure WFA World Federation of Advertisers

HUAC House Committee on Un-American

Activities WHATWG

Web Hypertext Application Technology Working Group

Table des tableaux et illustrations

Tableaux Illustrations

Tableau 1 : Évolution des

fréquences d’emploi des termes « data protection » et

« datenschutz » dans le corpus de livres numérisés par Google Books, visualisées avec l’outil Google

Ngram Viewer p. 52

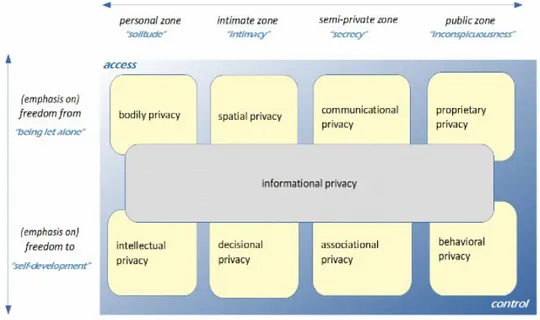

Figure 1 : Définition de

la « vie privée » sous

forme de schéma p. 39

Tableau 2 : Tableau de présentation

synoptique des terrains p. 71 Figure 2 : En-tête typiqued’un document de l’OCDE récupéré sur microfiches, ici un rapport du sous-groupe sur les banques de données du groupe informatique de la Direction de la science, de la technologie et de l’industrie de l’OCDE, daté du 15 novembre 1976, traduit en français depuis l’anglais, et classé

« diffusion restreinte » p. 76

Tableau 3 : Entretiens réalisés dans

le cadre de la campagne d’entretiens

exploratoires p. 72

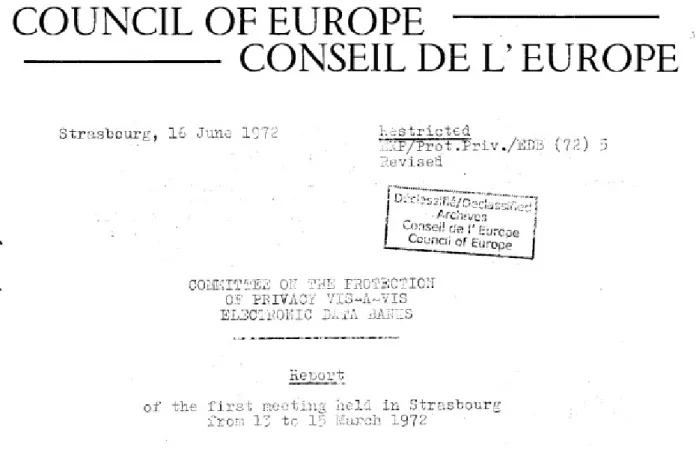

Tableau 4 : Liste des entretiens

réalisés dans le cadre du terrain sur la socio-genèse de la protection des

données p. 80 Figure 3 : Haut de la première page de la version révisée du 5e document attribué en 1972 au groupe d’experts sur la protection de la vie privée vis-à-vis des banques de données électroniques du Conseil de l’Europe, daté du 16 juin, classé « diffusion restreinte », et portant la marque d’un tampon indiquant son caractère déclassifié, sans précision de la date de

déclassification. p. 78

menés dans le cadre de l’enquête de terrain sur l’adoption du RGPD

socialisation informelle et de réseautage à la CPDP.

Tableau 6 : Tableau des entretiens

réalisés dans le cadre du terrain sur

le W3C Privacy Interest Group p. 98

Figure 5 : Capture

d’écran de la page « ISSUE-5: What is the

definition of tracking? »

du Tracking Protection

Working Group du W3C. p. 105

Tableau 7 : Liste des listes de

discussion publiques du W3C téléchargées dans le cadre de l’étude

de terrain sur le W3C PING p. 103

Figure 6 : Capture

d'écran du site Internet https://privacy.google.co m en date du 18 juillet

2017 p. 109

Tableau 8 : Comparaison entre le

Premier amendement à la constitution des États-Unis d’Amérique et l’article 10 de la Convention EDH p. 241 Figure 7 : Extrait de capture d’écran de la page https://www.researchgate. net/publication/22819898 2_Privacy_As_Contextua l_Integrity, du 19 juillet 2019 p. 110

Tableau 9 : Évolution de la notion

de donnée à caractère personnel en

droit français p. 269

Figure 8 : Capture

d'écran de l’ancienne

version de reCAPTCHA p. 138

Tableau 10 : Proposition

d’amendement de l’ONG EDRi au sujet du considérant 33 de la proposition initiale de RGPD de la

Commission européenne p. 336

Figure 9 : Capture

d'écran du site Internet www.fitbit.com/fr prise le

vendredi 29 avril 2016 p. 153

Tableau 11 : Comparaison de la

proposition de définition du

« profilage » formulée par EDRi en anglais, avec la version en langue anglaise de la définition du

« profilage » à l’article 4 du RGPD p. 348

Figure 10 : La console

d'un IBM System/360, ordinateur mis sur le

marché en 1965 p. 175

Tableau 12 : Tableau de

présentation d’une sélection de RFC

de l’IETF p. 388

Figure 11 : Extrait du

compte-rendu du séminaire sur la

protection des données de 1977 à Vienne, rédigé par le secrétariat de l’OCDE

(DSTI/ICCP/77.47) p. 213

Tableau 13 : Aperçu non-exhaustif

des arènes de standardisation

p. 414 Figure 12 : Schéma

illustratif montrant une

techno-politique de la vie privée

sélection d’auteurs et de rapports et une sélection d’autres auteurs et

rapports auxquels ils font référence. Alan Westin, George Orwell et Arthur Miller sont en rouge.

Tableau 14 : Récapitulatif des trois

propositions de définitions soumises au TPWG dans le cadre d'un appel à objections du 8 au 20 novembre

2013 p. 477

Figure 13 : Extrait du

Journal officiel des Communautés

européennes, n° C 120, p.

54 p. 263

Tableau 15 : Définitions de la

notion de « donnée à caractère personnel » dans les Lignes directrices de l’OCDE et dans la Convention 108 du Conseil de

l’Europe p. 530

Figure 14 : Extrait du

Journal officiel des Communautés

européennes, n° C 120, p.

55 p. 264

Tableau 16 : Comparaison entre les

définitions de la notion de donnée à caractère personnel dans la directive 95/46/CE et dans la proposition initiale de RGPD de la Commission

européenne p. 548

Figure 15 : Capture

d’écran d’un extrait de la carte de Bruxelles sur le site Google Maps, prise le 2 mai 2019, montrant la proximité géographique entre l’hémicycle bruxellois du Parlement européen, le bureau de représentation du Land de Bavière auprès de l’UE, et le siège bruxellois de Google, de part et d’autre

du parc Léopold p. 295

Tableau 17 : Proposition

d’amendement de Bits of Freedom de la notion de « personne

concernée » p. 552

Figure 16 : Cartographie

des coalitions de cause avec Gephi sur la base des données fournies par

Lobbyplag p. 312

Tableau 18 : Comparaison entre la

définition de la notion de « donnée à caractère personnel » dans la

directive 95/46/CE et dans la version

adoptée en lecture finale du RGPD p. 559

Figure 17 : En-tête d’un

des position papers recueillis par le projet Lobbyplag (Corpus

Lobbyplag, ICDP1, 2011) p. 317

Tableau 19 : Définition de la notion

de « donnée à caractère personnel » dans le droit de l’Union européenne

p. 567 Figure 18 : Capture

d’écran d’un extrait du document

et dans des documents de standardisation techno-politique

BITSOFFREEDOM1 du corpus Lobbyplag, dans lequel Bits of Freedom propose un amendement à la proposition initiale de RGPD de la Commission européenne

Tableau 20 : Exemples de réponses

données à la question : « pouvez-vous décrire brièvement, dans vos propres mots, ce que signifie le terme de « protection des

données » ? » p. 574

Figure 19 : Capture

d’écran d’un amendement proposé par l’AmCham EU, dans le document AMCHAMEU1 du

corpus Lobbyplag, p. 11 p. 340

Suite de la table des illustrations Figure 20 : Extrait de la page 5 de la

réponse de la FEDMA à la consultation de 2009 de la

Commission européenne (document

FEDMA1) p. 344

Figure 33 : Apparition du

signal « DNT:1 » dans le code source d'un logiciel développé en Python en janvier 2011 par Jonathan

Mayer p. 440

Figure 21 : Proposition

d’amendement à l’article 20 de la proposition de RGPD formulée par

l’AmCham EU p. 349

Figure 34 : Extrait d'une

capture d'écran de Firefox version 61 montrant l'activation du signal

DNT:1 p. 441

Figure 22 : Extrait du position paper

intitulé « Proposal for a Data Protection Regulation – BEUC analysis of consumer benefits versus administrative burden of key

provisions », à la page 3 du document BEUC1 du corpus de position papers récupérés depuis le

dépôt Github de Lobbyplag p. 360

Figure 35 : Extrait de

capture d'écran de la page d'accueil des archives publiques de la liste de discussion public-privacy

sur le site du W3C p. 447

Figure 23 : Proposition

d’amendement 67, extraite d’un position paper d’EDRi, en page 52 du document EDRI2 du corpus

Lobbyplag p. 378

Figure 36 : Capture

d’écran d’une discussion sur le canal IRC #privacy du W3C pendant la réunion F2F du PING le 26 octobre 2018 lors du

TPAC de Lyon p. 448

Figure 24 : Premier extrait de

capture d'écran de RFC 791 visible

p. 389 Figure 37 : Capture

d'écran du début du

sur le site de l'IETF depuis la page https://tools.ietf.org/html/rfc791 compte-rendu détaillé de la réunion du 19 janvier 2017, disponible à l'adresse web : https://www.w3.org/2017/ 01/19-privacy-minutes.html

Figure 25 : Deuxième extrait de

capture d'écran de RFC 791 visible sur le site de l'IETF depuis la page

https://tools.ietf.org/html/rfc791 p. 390

Figure 38 : Capture

d'écran de la console d'analyse des flux réseaux depuis le navigateur web Firefox en allant visiter le

site web www.lemonde.fr p. 469

Figure 26 : Extraits de capture

d'écran de RFC 1087 visible sur le site de l'IETF depuis la page

https://tools.ietf.org/html/rfc791 p. 392

Figure 39 : Evolution de

l'utilisation du mot « trust » sur

public-tracking et public-privacy p. 492

Figure 27 : Extrait de la

présentation de David Clark lors de

l'IETF 24 en 1992 p. 403

Figure 40 : Exemple de

sémiotisation par les navigateurs web de signes de danger ou de

confiance en fonction du support ou non du protocole HTTPS par les

sites visités p. 496

Figure 28 : Le schéma de la

procédure d'adoption d'une

Recommandation du W3C p. 418

Figure 41 : Évolution de

l'emploi du terme « law » au cours du temps sur les

mailing-lists du W3C p. 501

Figure 29 : Nombre d’occurrences

du mot « privacy » en valeur absolue entre août 1995 et octobre 2017 sur

les mailing-lists téléchargées p. 423

Figure 42 : Extrait de

capture d'écran de la page https://github.com/w3ctag /design-reviews/blob/mas ter/2015/05/fingerprint.m

d p. 511

Figure 30 : Capture d’écran d’une

boîte de dialogue P3P dans Internet

Explorer p. 426

Figure 43 : Proposition

d’amendement de l’AmCham EU aux définitions des notions de « personne concernée » et de « donnée à caractère

personnel » p. 555

mails envoyés par mois sur la liste de discussion public-p3p-spec

nombre d’occurrences absolues de l’emploi de certains mots dans la liste de discussion

public-privacy

Figure 32 : Schéma des liens

interpersonnels entre listes de

diffusion du W3C. p. 437

Figure 45 : Évolution en

nombre d’occurrences absolues de l’emploi de certains mots dans la liste de discussion

Introduction générale

« Les Français vont […] vivre dans une civilisation de l'information. La recherche de l'information devient une activité rentable, sa détention une source de puissance. Le renseignement qui lui sert de matière première est dorénavant recherché ; une pression croissante s'exerce pour que soient recueillies des données nouvelles, dont la veille encore il aurait été techniquement et financièrement inconcevable d'envisager l'utilisation. L'information circule, empruntant de nouveaux circuits » (Conseil d’État

(France), 1970, p. 5)

« Difficile […] pour les adolescents de ne pas trop exposer leur vie privée sur les

réseaux. Nombre d'entre eux n'hésitent pas à dévoiler des photos d'eux (88%) sur leur profil, leur adresse mail (68%), s'ils sont célibataires ou non (58%), leur adresse postale (27%). Une impudeur d'autant plus préjudiciable qu'un ado compte en moyenne 210 amis sur Facebook et que 31% des sondés avouent avoir accepté dans leurs contacts des personnes qu'ils n'avaient jamais rencontrées. » (Bancaud, 2011, non paginé, dans le

journal 20 Minutes)

Les craintes suscitées par la diffusion de l'Internet pour la vie privée ne datent pas d’hier. Les plus anciens fournisseurs d'accès à Internet (FAI) français remontent au milieu des années 1990. Dès septembre 1998, Le Monde Diplomatique publiait un article de Mathieu O'Neil intitulé « Internet, ou la fin de la vie privée » (O’Neil, 1998). Loin de disparaître, ces craintes semblent s’être intensifiées. En 2011, Alex Türk, alors président de la Commission nationale informatique et libertés (CNIL) française publiait un livre sous le titre de : « La vie privée en péril » (Türk, 2011). En 2012, un journaliste du Guardian titrait l’un de ses articles : « La fin de la vie privée en ligne ?1 » (Arthur, 2012). Selon un sondage réalisé par BVA en France en 2018, « qu’il s’agisse de leurs coordonnées personnelles (numéros de téléphone, adresse ...) (78 %) ou de leurs documents privés (photos, vidéos …) (67 %), la majorité des Français se montrent inquiets quant à la protection de leur vie privée sur Internet » (BVA, 2018, p. 3). Nous pourrions multiplier de

1 Traduction de l’auteur. Texte original : « The end of online privacy? » Note sur les traductions :

Lorsqu’une traduction a été faite par nos soins, cela sera indiqué comme ici en note de bas de page. Les autres traductions ont été réalisées par une traductrice professionnelle, Camille Thompson, puis relues et corrigées par l’auteur. Les quelques exceptions – notamment pour les traductions depuis l’allemand – sont également précisées.

Le travail d’analyse a toujours porté sur le texte original, et jamais sur des traductions, sauf pour les langues autres que le français, l’anglais, le néerlandais, l’espagnol, l’italien, le hongrois ou, selon le niveau de difficulté, l’allemand. Les traductions sont données à titre indicatif et sont insérées dans le corps du texte pour faciliter la lecture.

tels exemples. Les révélations d’Edward Snowden, en 2013, sur les programmes de surveillance secrets de la National Security Agency (NSA) des États-Unis d’Amérique, auxquels de grandes entreprises multinationales comme Facebook et Microsoft ont participé (Greenwald, 2013 ; Lyon, 2015), ne sont pas étrangères au renforcement de ces craintes et de leur visibilité médiatique et politique accrue.

La figure de Big Brother dans 1984 de George Orwell (1949) continue à être une métaphore socialement répandue de la surveillance. Des Big Brother Awards sont régulièrement décernés à des entreprises ou à des personnalités accusées par des associations d’avoir particulièrement contribué au renforcement de dispositifs de surveillance2. Des films comme

Minority Report en 2002, tiré d’une nouvelle de Philip K. Dick (1956), ou encore nombre

d’épisodes de la série Black Mirror, montrent que la question de la surveillance continue à inspirer les réalisateurs. Cette inspiration se retrouve également dans d'autres domaines artistiques. L'exposition financée par l'Open Society Foundation et intitulée « Watching You,

Watching Me » a parcouru plusieurs pays dont les États-Unis, la Hongrie, la Belgique et

l'Allemagne depuis 20143.

À l’âge de l’« hyper-affichage de soi » (Carré et Panico, 2012), la crainte de l’érosion ou de la disparation de la vie privée est partagée par de nombreux chercheurs, comme Susan B. Barnes, qui s'inquiétait dans un article de 2006 du fait que les adolescents dévoilent leur vie privée sur des réseaux sociaux comme Facebook (Barnes, 2006). Une partie non négligeable de ces craintes se concentre sur les enfants et les adolescents, qui seraient imprudents et vivraient dans un contexte d'extinction de la vie privée :

« La masse de millions de données personnelles dévoilées en public [sur les réseaux sociaux] aboutit à fortement fragiliser la vie privée dans le monde entier pour des générations entières, et en particulier pour les jeunes4. » (Sziklay, 2016, p. 57)

D’autres travaux de recherche ont mis en évidence un « paradoxe de la vie privée » ou « privacy paradox » dans les comportements en ligne (Acquisti et Gross, 2006 ; Acquisti, Ida et Rochelandet, 2011 ; Estienne, 2011 ; Martin-Juchat et Pierre, 2011 ; Norberg, Home et Home, 2007). Les personnes observées au cours de ces travaux manifestaient un comportement de divulgation de soi en contradiction apparente avec la valeur qu'ils affirmaient accorder à la vie privée. Du point de vue de l'analyse économique, les internautes n'agissent donc pas en consommateurs rationnels sur le marché de la vie privée (Rochelandet, 2010). Il y aurait une

2 Voir la liste de toutes les cérémonies de remise de ces « prix » à travers le monde sur :

http://www.bigbrotherawards.org/ (page consultée le 28 juillet 2019).

3 Voir par exemple sur le site du Staatliche Museum zu Berlin :

https://www.smb.museum/en/exhibitions/detail/watching-you-watching-me-a-photographic-response-to-surveillance.html (page consultée le 28 juillet 2019).

4 Traduction de l’auteur. Texte original : « A milliós nagyságrendben nyilvánosságra hozott személyes adatok tömege egyrészt igen sérülékeny magánszférát eredményez globális mértékben meghatározott teljes – elsősor-ban fiatal – generációk vonatkozásáelsősor-ban. »

baisse de l'intériorisation des normes de la pudeur, une perte de contrôle informationnel (voir : Klein, 2012) que les entreprises du « Web 2.0 », dont Facebook (boyd, 2010), favoriseraient pour des raisons d'intérêt commercial (Fuchs, 2012). Nous assistons parfois de la part de leurs dirigeants à des discours hostiles à la vie privée, présentée comme dépassée, désuète. Mark Zuckerberg a pu ainsi affirmer, prenant acte du comportement des utilisateurs inscrits sur Facebook, que la vie privée en tant que norme sociale avait disparu (Johnson, 2010). D'autres, comme Vint Cerf, Chief Internet Evangelist chez Google, ont exprimé l'opinion selon laquelle la vie privée serait une anomalie historique (Cerf, 2013).

La littérature académique fournit quelques facteurs d’explication au « paradoxe de la vie privée ». Il s’explique par exemple par les services et bénéfices souvent sans contrepartie financière attendus en échange du partage d’informations (Gerber, Gerber et Volkamer, 2018). D’autres pointent du doigt l’absence de choix réel dont bénéficient les individus qui « consentent » à utiliser des services en ligne les dépossédant de leur « vie privée », malgré l’importance qu’ils y accordent, et parlent de « consentement résigné » (Hémont et Gout, à paraître). Un part grandissante de la littérature s’intéresse aux phénomènes de manipulation qui visent à extorquer une forme de consentement des utilisateurs à partager des informations qui les concernent (Gray et al., 2018 ; Susser, Roessler et Nissenbaum, 2018). D’autres encore ont montré que l’augmentation progressive de la pression de la surveillance dans les démocraties libérales érodait la résilience de la vie privée comme valeur sociale bien mieux que l’instauration brutale d’une surveillance policière, comme il en survint en Europe centrale et orientale dans la deuxième moitié des années 1940 (voir : Jones, Raab et Székely, 2018 ; Raab, Jones et Székely, 2015).

Notre questionnement s’inscrit lui aussi dans une tentative de compréhension de ce paradoxe, et commence par l’interrogation suivante : de quelle « vie privée » parle-t-on lorsque

l’on parle de paradoxe de la « vie privée » ? Bien qu’il y ait des exceptions, nombre de travaux

académiques éludent la question de la définition de la vie privée. Ce concept échapperait d’ailleurs selon certains « par essence » à toute tentative sérieuse de définition, ou à tout le moins de consensus sur sa définition (Mulligan, Koopman et Doty, 2016).

La question est loin d’être triviale. Est-ce vraiment la « vie privée » qui disparaît, ou bien assistons-nous, de façon corrélée à la diffusion de l’informatique, à une transformation de cette « vie privée » et de notre rapport individuel comme collectif à cet objet, qu’à ce stade de l’introduction nous n’arrivons pas encore à définir ? Lorsque des chercheurs font une enquête sur le sentiment des individus sur leur « vie privée », et « l’importance » qu’ils leur accordent, tous évoquent-ils bien la même chose ? Ou bien projettent-ils sur eux leurs propres définitions ? Et si cela pouvait aussi contribuer à expliquer le paradoxe de la vie privée ?

À ce sujet, il convient dès à présent de préciser la terminologie qui nous accompagnera tout au long de ce mémoire de thèse.

Nous utilisons le terme « vie privée » comme synonyme du mot anglais « privacy », et ce malgré les nuances qui existent (discutées dans : Rey, 2012) entre les deux termes. En français, la « vie privée » peut désigner l’intimité, la sphère privée, mais aussi être synonyme de « vie personnelle » en opposition à la « vie publique » comme à la « vie professionnelle », par exemple5. En anglais, le mot « privacy » est d’abord lié à l’idée d’intimité, du lieu où se déroule la vie personnelle d’une personne en dehors du regard de l’autre, de confidentialité. Bénédicte Rey (2009) préfère ainsi directement parler de « privacy à l’heure du numérique » et non de « vie privée à l’heure du numérique » dans une thèse par ailleurs rédigée en français. D’autres préfèrent utiliser le néologisme « privacité » (Latzko-Toth et Pastinelli, 2014). Nous avons préféré garder le terme de « vie privée » et l’utiliser de façon interchangeable avec celui de « privacy » pour deux raisons. La première est que la difficulté à les définir l’un comme l’autre fait que, selon le point de vue adopté, ils peuvent avoir une aire d’intersection sémantique telle que nous pouvons dans de nombreux cas les considérer comme synonymes. La deuxième est que leurs sens contemporains se sont calqués l’un sur l’autre, car lors de la traduction de textes juridiques internationaux de référence, « privacy » traduit désormais le français « vie privée », et vice-versa (González Fuster, 2014a). Pour nos terrains, où le droit joue un rôle prépondérant, et pour nos corpus de discours d’acteurs, pour la plupart d’entre eux en anglais, la différence entre « privacy » et « vie privée » est marginale. Nous n’avons donc pas voulu compliquer la lecture inutilement en cherchant à différencier les deux termes.

Une autre précision importante est que nous utiliserons le terme de « vie privée » par opposition à « vie publique », et non par opposition à « vie professionnelle », que nous opposerons à « vie personnelle ». Cette « vie privée » « est de fait un comportement plutôt qu’un état » (Rey, 2012, paragr. 20). Elle est constituée par un ensemble de comportements en réaction à un sentiment d’intrusion (Rey, 2012, paragr. 20). Cette définition ne nous dit rien sur les circonstances dans lesquelles de telles réactions ont lieu, ni sur la façon dont elles parviennent à constituer cet « espace » (matériel ou symbolique) ôté à l’œil du public, et sur les limites d’un tel espace. Elle fournit toutefois une première base utile à la construction de notre objet de recherche.

Enfin, nous ferons toute au long de ce mémoire une distinction entre « vie privée », « droit à la vie privée » et « droit de la vie privée ». La « vie privée » est cette chose polysémique à la définition contestée que nous n’arrivons pas encore à cerner, mais qui semble pour l’instant s’opposer à la « vie publique », et dont nous admettons qu’elle traduise – à quelques nuances près – la notion en anglais de « privacy ». Le « droit à la vie privée » est le droit fondamental qui

5 Ainsi, lorsque Hannah Arendt oppose la « vie privée » (de l’espace domestique) à la « vie publique », elle n’oppose pas l’intime au non-intime, mais la part de la vie active consacrée à soi dans l’espace domestique à la part de la vie consacrée au travail dans la Cité. Dans The Human Condition (titre original de La condition de

l’Homme moderne), elle ne parle donc pas de « privacy » mais de « private life » (voir : Arendt, 1998 [1958],

octroie aux individus le droit à cette chose. De la même façon, il existe par exemple dans la Déclaration universelle des droits de l’Homme (DUDH) de 1948 un « droit à la liberté d’expression » (art. 18), ou un « droit à la liberté de pensée, de conscience et de religion » (art. 19). Mais le « droit à la vie privée » est une déclaration de principe, là où le « droit de la vie privée » correspond au corpus de règles juridiques et de procédures précises qui encadrent la façon dont les individus peuvent exercer le « droit à la vie privée ». Concrètement, il peut par exemple s’agir de textes dans des lois, des règlements, des décisions de justice faisant jurisprudence, ou encore, dans certaines juridictions, de règles coutumières.

Nous avons vu que la « vie privée » était perçue comme menacée par la diffusion de certaines pratiques en ligne, d’Internet, et plus largement, des technologies numériques de l’information et de la communication. Il convient maintenant de nous pencher sur le rapport entre « vie privée » et milieu technique.

Vie privée et milieu technique

Les objets techniques sont souvent présentés comme déontologiquement neutres, et les décisions techniques comme apolitiques. Ce genre de présentation est critiquable, et sert souvent à dissimuler des enjeux de pouvoir ou une responsabilité politique. Marie Goupy (2014) a par exemple montré dans son étude qu'après la destitution de Ben Ali en Tunisie, les dirigeants de l'Agence tunisienne de l'Internet (ATI) ont développé une stratégie de communication visant à souligner l'absence de responsabilité de ses ingénieurs dans la surveillance policière d'Internet, l'ATI ne faisant, selon les mots de son directeur M. Chakchouk, « pas de politique6 ». Cette présentation est démentie par le fait que cette agence ait mis en place, à la demande du pouvoir politique, les moyens techniques ayant facilité et permis le travail de services de renseignement tunisiens (Goupy, 2014). La neutralité sociale et politique de la technologie est bien un leurre.

L’on ne peut pas dire que les objets techniques soient pour autant des « acteurs » politiques, car leur reconnaître une intentionnalité serait tomber dans un excès inverse. Ils contribuent plutôt à façonner les relations de pouvoir entre individus. Agir sur eux, transformer leur configuration matérielle, est une façon de « faire de la politique » (Akrich, 1993 ; Lavelle, 2009 ; Winner, 1980). Il serait aussi faux de dire, comme l’ont fait Karl Marx et Friedrich Engels, que « l’infrastructure » matérielle détermine la « superstructure » idéologique et sociale (Engels, 1978 [1872] ; Marx, 2002 [1859]). À ce titre, nous souscrivons à la critique du marxisme classique d’auteurs comme Antonio Gramsci et Cornelius Castoriadis qui réhabilitent le rôle de l’idéologie, et des imaginaires sociaux en général, dans la compréhension des chaînes de causalité historiques (Castoriadis, 2006 [1975] ; Gramsci, 2018 [1948]). De nombreuses études en sociologie ont d’ailleurs montré que s’il existait une relation de dépendance à la technique, la

6 Entretien réalisé par Marie Goupy le 25 juin 2013 et cité dans son article « La bienveillante neutralité des technologies d'espionnage des communications : le cas tunisien » (Goupy, 2014).

technique n’en était pas moins une activité humaine, et donc l’infrastructure matérielle de la société est le produit de cette dernière (Bijker, 1995 ; Dupuy, 1982 ; Jauréguiberry et Proulx, 2011 ; Lenert, 2004).

Nous souscrivons largement à la thèse selon laquelle le milieu technique dans lequel évoluent les individus contribue à les « constituer » (Steiner, 2010). La technique est ambivalente en ce qu’elle permet d’agir tout en « arraisonnant » les conditions d’action futures (Bachimont, 2010). Elle ne détermine donc certes pas, mais elle joue un rôle dans la constitution tant des sociétés que des subjectivités. Cela, par exemple, Jack Goody l’a montré en expliquant le rôle qu’avait eu l’écriture dans l’avènement de la « raison graphique » (Goody, 1979). Nous ajouterons qu’elle joue aussi un rôle politique indirect à travers les réactions que ses représentations dans des imaginaires sociaux suscitent. Le récit de la genèse du droit à la protection des données à caractère personnel l’illustrera : ce droit n’est pas la conséquence directe, nécessaire, mécanique ou téléologique de transformations dans le milieu technique en général et les techniques de l’information et de la communication (TIC) en particulier.

Nous ne nous appesantirons ici pas d’avantage sur les théories cherchant à étudier la relation entre l’être humain et son milieu technique, et préférons renvoyer le lecteur vers les quelques références que nous venons de citer et sur lesquelles nous nous appuyons. Ce détour théorique général nous a toutefois paru nécessaire pour justifier de prendre au sérieux la proposition suivante : le milieu technique – et donc son évolution – joue un rôle dans la

constitution de la « vie privée ». D’ailleurs, de nombreux auteurs ont montré comment des

évolutions par exemple dans l’architecture des habitats et des villes avaient contribué à faire évoluer le rapport à la « vie privée » (Guerrand, 1987 ; Habermas, 1988 [1962] ; Mumford, 1938 ; Prost, 1987 ; Riehl, 1889). L’invention de la chambre à coucher individuelle n’est par exemple absolument pas anecdotique pour comprendre l’évolution historique du concept et des pratiques qu’il désigne. Elle est corrélative à la constitution, selon Jürgen Habermas, d’une séparation entre « espace public » et « espace privé » (Habermas, 1988, p. 55). L’évolution du téléphone offre un autre exemple pour aider à comprendre le rapport entre « vie privée » et milieu technique. Alors qu’au début, le téléphone, fixe, était partagé par un groupe – familial, souvent même villageois ou de quartier – et offrait une intimité d’autant plus limitée aux interlocuteurs que les salariées qui opéraient les connexions dans les centraux téléphoniques pouvaient écouter la conversation (Julliard, 2004), le téléphone portable individuel est devenu un objet intime que l’on protège par mot de passe, voire par des dispositifs biométriques.

Ces quelques exemples illustrent ainsi comment le milieu technique donne ou non des possibilités de réaction à des individus ou des groupes ressentant un sentiment d’intrusion.